提升Diffusion模型生成效果#FreeU

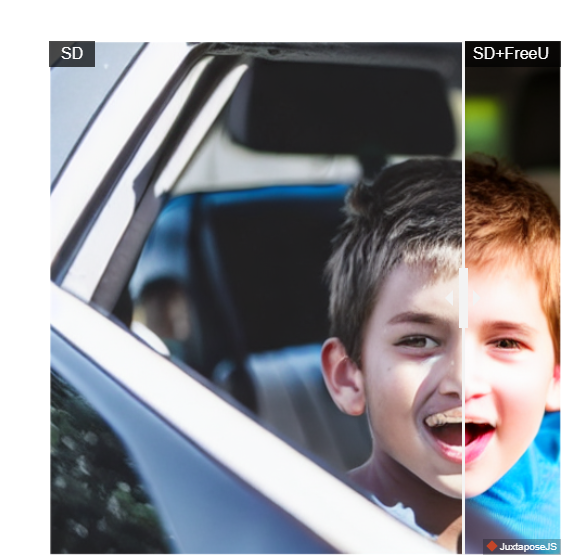

提出了FreeU,这是一种在没有额外成本的情况下,显著提高扩散模型样本质量的方法。

FreeU适用于Diffusion U-Net,可以生成高质量的样本。

实验结果表明,使用FreeU可以改善视频到视频的样本生成效果。

评论

下载APP

下载APP

提出了FreeU,这是一种在没有额外成本的情况下,显著提高扩散模型样本质量的方法。

FreeU适用于Diffusion U-Net,可以生成高质量的样本。

实验结果表明,使用FreeU可以改善视频到视频的样本生成效果。