PyTorch视频理解利器!数行代码训练视频模型

点击上方“机器学习与生成对抗网络”,关注星标

获取有趣、好玩的前沿干货!

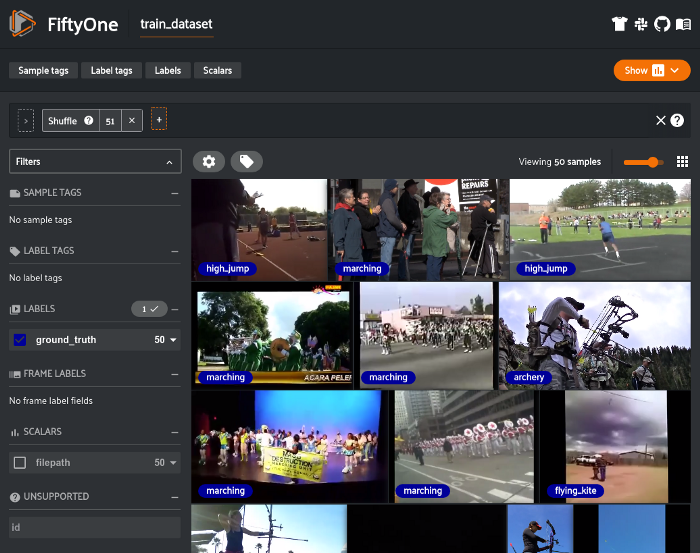

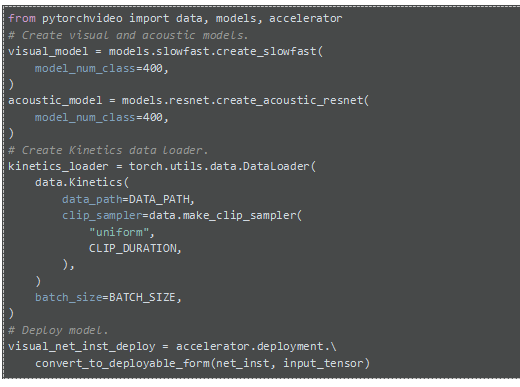

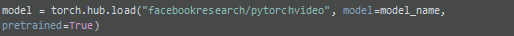

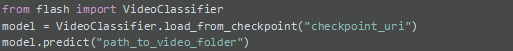

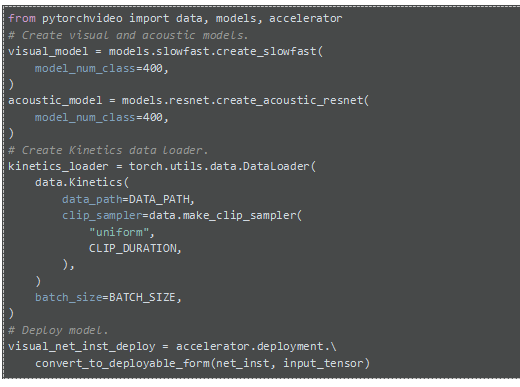

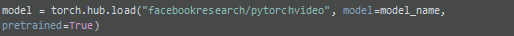

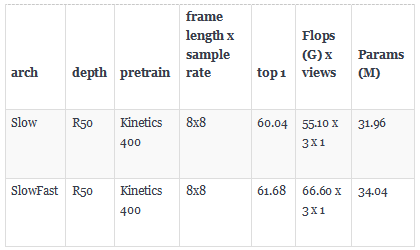

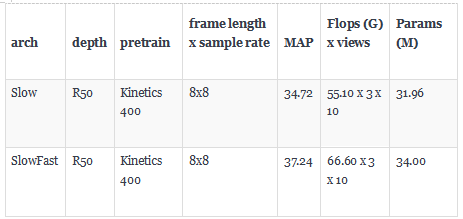

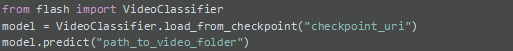

Facebook人工智能实验室在 PySlowFast 之后时隔两年,携 PyTorchVideo 重入战场。

Something-Something V2

Charades

AVA (V2.2)

猜您喜欢:

附下载 |《TensorFlow 2.0 深度学习算法实战》

评论

下载APP

下载APP点击上方“机器学习与生成对抗网络”,关注星标

获取有趣、好玩的前沿干货!

Facebook人工智能实验室在 PySlowFast 之后时隔两年,携 PyTorchVideo 重入战场。

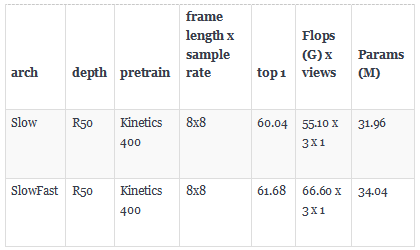

Something-Something V2

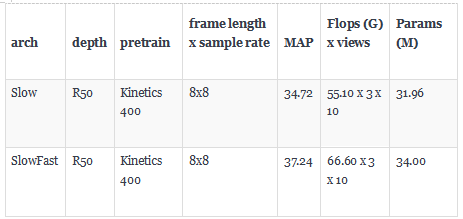

Charades

猜您喜欢:

附下载 |《TensorFlow 2.0 深度学习算法实战》