来源:nextgov

编辑:LRS

【新智元导读】NLP研究人员都知道语言模型只能学到语法上下文信息,对于常识性问题则束手无措。南加州大学的一名助理教授最近做客《对话》,阐述了他眼中的常识以及解决方法。他悲观地预测,也许5年、50年才能解决,到底需要多久,没人知道。

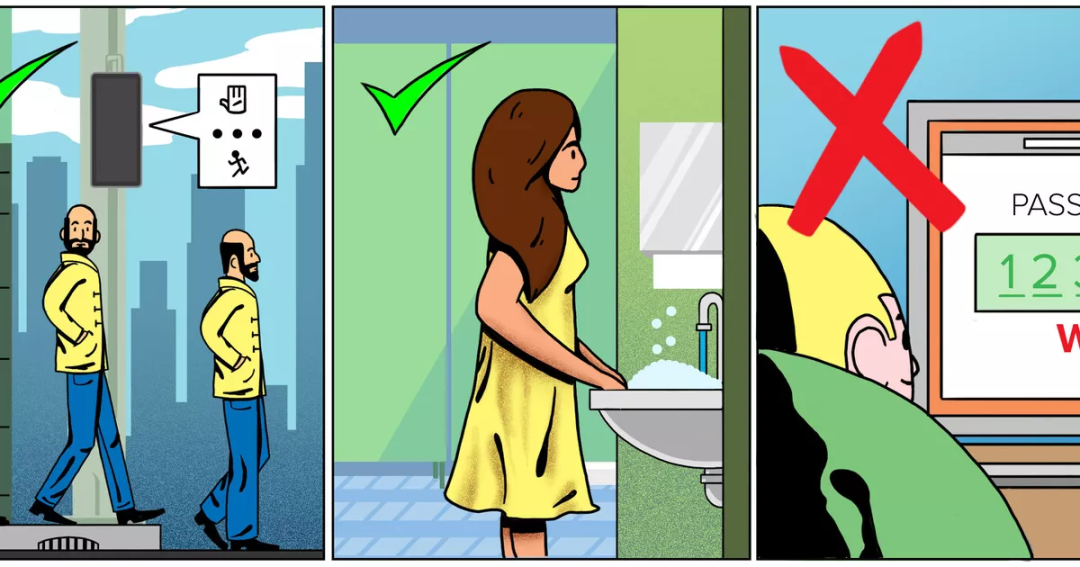

如果说人工智能和真正的人脑之间的差距,那最重要的就是机器缺乏生活中的常识。一切貌似合理、理所当然的事物在计算机眼中都是不可理解的。计算机不知道「柠檬是酸的」,「只有成熟的香蕉是黄色的」,这也是目前人工通用智能领域尚未解决的问题。并且人类可以根据过去的常识来调整自己的行为,例如你和朋友王二约好一起吃午饭,并且上周计划好一起吃“开封菜”,但是你又想起他这周开始在减肥,所以为了安全起见,还是再商量一下再点餐。但机器就无法做到这点,强大的记忆力和逻辑性并无法让它把“开封菜”和减肥之间联系在一起。我们理所当然地认为自己有能力来处理这类的情况,因为我们有一整套的常识,如果缺乏这些常识,可能就无法在人类社会中很好地生存,例如不能在做饭时把煤气和臭味联系在一起,那后果不堪设想。南加州大学的助理教授Mayank Kejriwal最近在《对话》(the Conversation)上接受采访,介绍了他眼中的计算机处理常识中的方法和困境。

尽管对于人类如何理解周围的世界和如何学习来说,常识既是普遍的,又是必不可少的,但是常识又是很模糊的,无法给出一个单一的精确定义。不过20世纪初,以为英国英国哲学家和神学家吉尔伯特·基思·切斯特顿(G.K. Chesterton)有一句名言:Common sense is a wild thing, savage, and beyond rules.现代定义认为,它是一种自然而非通过课堂授予的一种能力,它能够使人们能够驾驭日常生活。常识是非常广泛的,不仅包括社会能力,如管理预期和推理他人的情绪,而且还包括一种与生俱来的物理感,比如知道一块重的石头不能安全地放在一个轻薄的塑料桌子上。与生俱来或者说是这种简单的物理感受,因为人们虽然知道这些事情,但并不是通过研究物理方程得出的结论。除此之外常识还包括抽象概念的背景知识,如时间、空间和事件。这些知识使人们不必太精确,就可以进行计划、评估和组织世界上的事物。自从20世纪50年代人工智能领域的早期发展以来,常识一直是人工智能前沿的一个重要挑战。尽管人工智能取得了巨大的进步,尤其是在游戏和计算机视觉方面,但机器常识距离达到人类常识的丰富度仍然有很大的距离。这就是为什么为什么人工智能能够解决复杂的、现实世界中的问题,比如诊断和推荐给2019冠状病毒疾病患者的治疗方法,但其他需要常识的问题经常会失败。现代人工智能被设计用来解决高度具体的问题,与常识相反,常识是模糊的,不能被一套规则定义。即使是最新的模型有时也会出现荒谬的错误,这表明人工智能的世界模型缺少了某些基本的东西。「你给自己倒了一杯蔓越莓,然后心不在焉地倒了一茶匙葡萄汁进去。看起来还不错。你试着闻它,但是你得了重感冒,所以你闻不到任何东西。你很渴。所以你」「喝了它,你现在死了。」(drink it. You are now dead)人工智能界对于常识系统的研究逐渐重视。美国国防部高级研究计划局于2019年启动了为期四年的机器常识项目(Machine Common Sense),该项目旨在加快常识领域的研究,并且发布了一篇论文,概述了该领域的问题和研究状况。机器常识项目资助了许多当前机器常识的研究工作,包括多模态开放世界接地学习和推理(Multi-modal Open World Grounded Learning and Inference, MOWGLI),这个项目能够构建一个回答常识性问题的计算机系统。Transformer在NLP界已然是yyds,但他真能拯救常识系统吗?Transformer建立的自然语言模型,经过一些调整后,能够回答简单的常识性问题。常识性的问题回答是构建可以像人类一样交谈的聊天机器人必不可少的第一步。这种快速的进步迫使该领域的研究人员在科学和哲学的边缘面对两个相关的问题: 什么是常识?我们如何确定人工智能是否有常识呢?对于第一个问题,研究者将常识分为不同的类别,包括常识社会学、常识心理学和常识背景知识。并且有研究人员可以更进一步,将这些类别划分为48个细粒度的领域,如计划、威胁检测和情绪。然而这些类别之间的区别并不是很清晰。即使是专业的人类标注员,即分析文本并对其组成部分进行分类的工作人员,他们也不同意常识的哪些方面适用于特定的句子。标注员赞同相对具体的类别,如时间和空间,但不同意更抽象的概念。即使你承认常识理论中的某些重叠和模糊是不可避免的,研究人员真的能确定人工智能有常识吗?研究人员经常问机器问题来评估它们的常识,但是人类在日常生活中的行为方式要有趣得多。人们运用一系列的技能,这些技能都是通过进化磨练出来的,包括辨别基本因果关系的能力,创造性解决问题的能力,估计能力,计划能力,以及基本的社交技能,比如谈话和谈判。尽管这个清单可能很长,也不完整,但是一个人工智能应该在它的创造者宣布在机器常识研究方面取得胜利之前就取得同样的成就。甚至Transformer对于NLP系统的推进效果也在下降,这一点已经变得越来越明显。Transformer变得越来越大,耗电量也越来越大,有效地训练需要大量的数据。然而,迄今为止,事实证明,它无法理解人类常识的细微差别。即使是深度学习的先驱们似乎也认为,在今天的神经网络能够实现这样的飞跃之前,可能还需要新的基础研究。根据这一新研究领域的成功程度,我们无法判断机器常识是五年后的事,还是50年后的事。

参考资料:

https://www.nextgov.com/ideas/2021/08/ai-expert-explains-why-its-hard-give-computers-something-you-take-granted-common-sense/184583/