干货 | 循环神经网络LSTM的数学过程

击上方“小白学视觉”,选择加"星标"或“置顶”

重磅干货,第一时间送达

本文转自 | OpenCV学堂

引言

长短时记忆(long short term memory,LSTM)是一种有效的链式循环神经网络(recurrent neural network,R2 NN1),被广泛用于语言模型、机器翻译、语音识别等领域。[1]本文具体就LSTM的具体实现做出推导。

LSTM模型描述

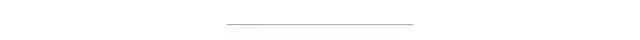

因为传统的RNN在间隔不断增大的同时,会丧失学习到连接如此远的信息的能力。这个问题简称长期依赖问题,为了解决这个问题,LSTM通过刻意的设计来避免长期依赖问题。以下就是LSTM的结构图:

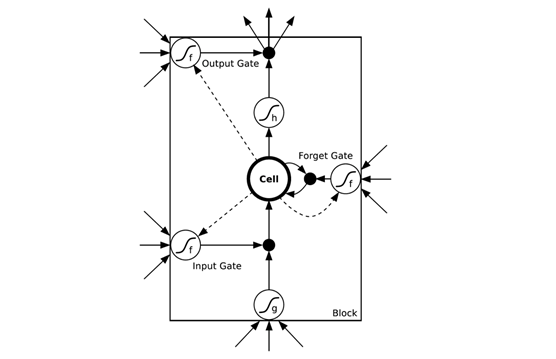

展开以后变成:

它与RNN的简单模型不一样的地方在于:

它是由记忆细胞、遗忘门、输入门、输出门组成。记忆细胞负责存储历史信息, 通过一个状态参数来记录和更新历史信息;三个门结构则通过Sigmoid函数决定信息的取舍, 从而作用于记忆细胞。[2]

遗忘门用来选择性忘记多余或次要的记忆

输入门决定我们需要更新什么值

输出门决定细胞状态的哪个部分输出出去

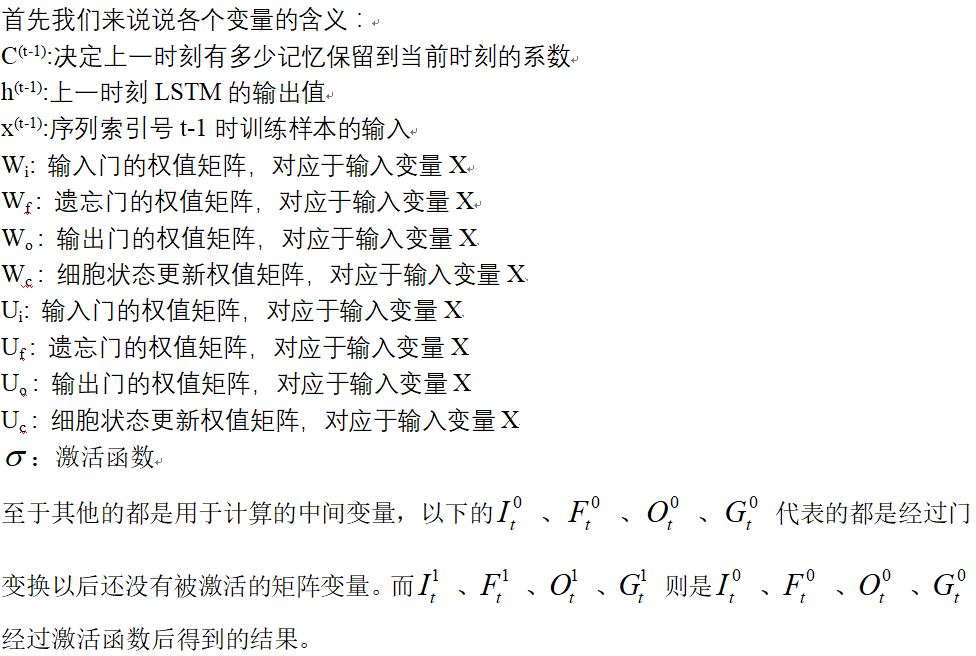

模型抽象和数学符号的说明

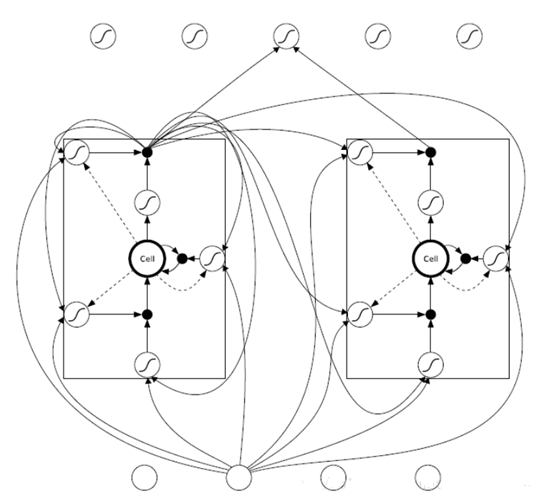

为了方便数学原理的推导,这里我们用下面的简略图代替:

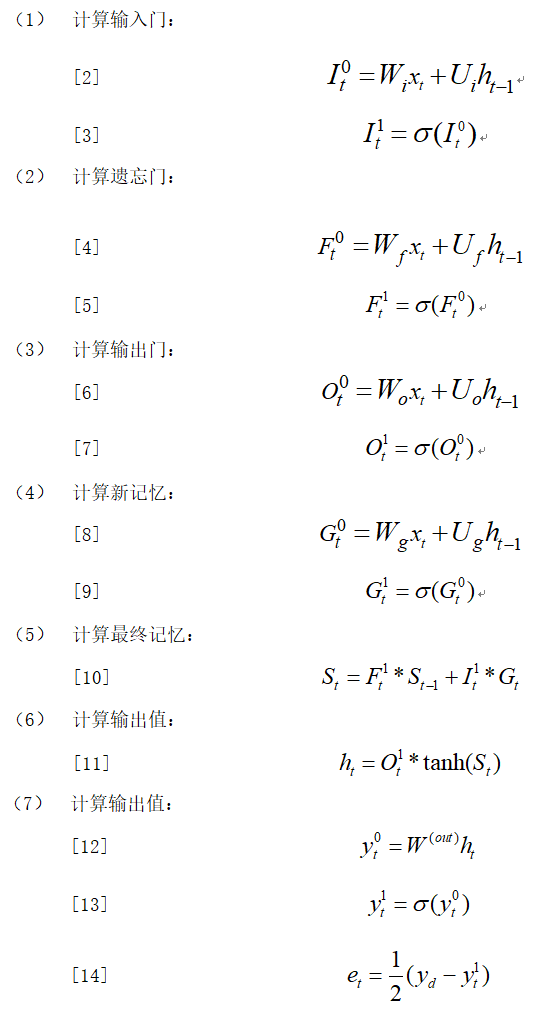

前向传播算法

前向传播总体上就是对三个门进行计算,然后通过这三个门决定当前细胞的隐藏状态,更新当前记忆和过去的记忆,最终再计算出输出值传入下一次前向网络中:因为三个门的情况不仅取决于输入向量Xt,还取决于ht-1

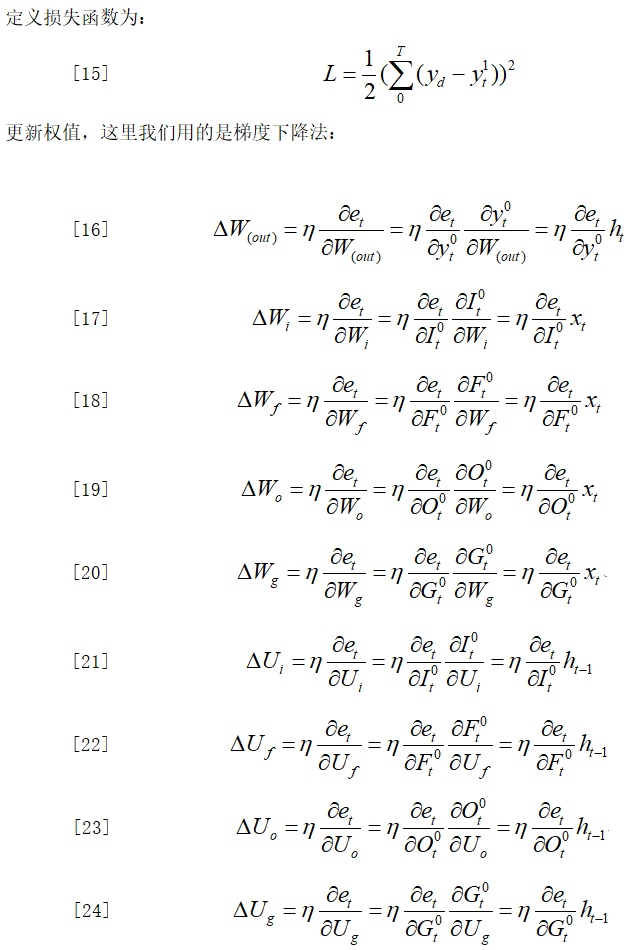

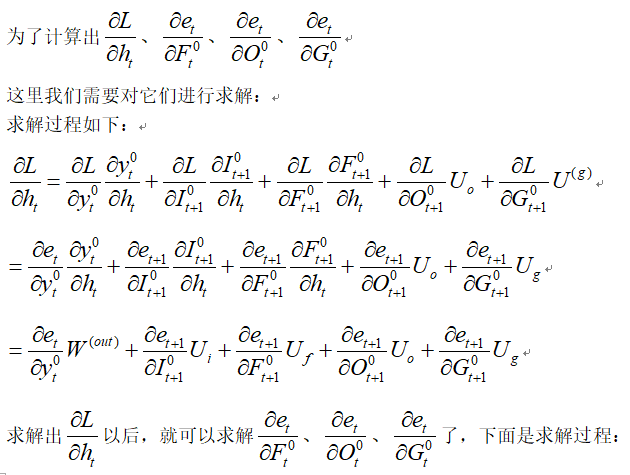

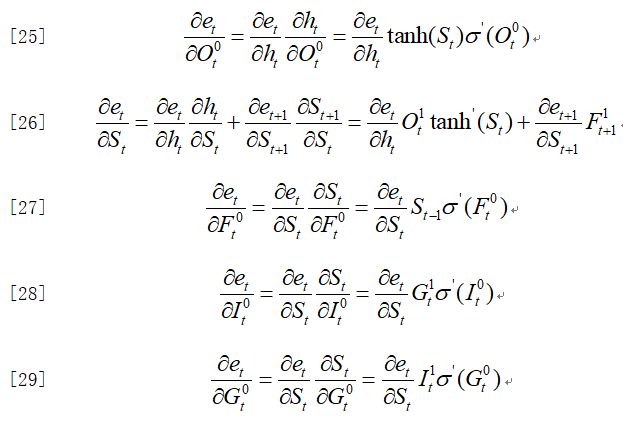

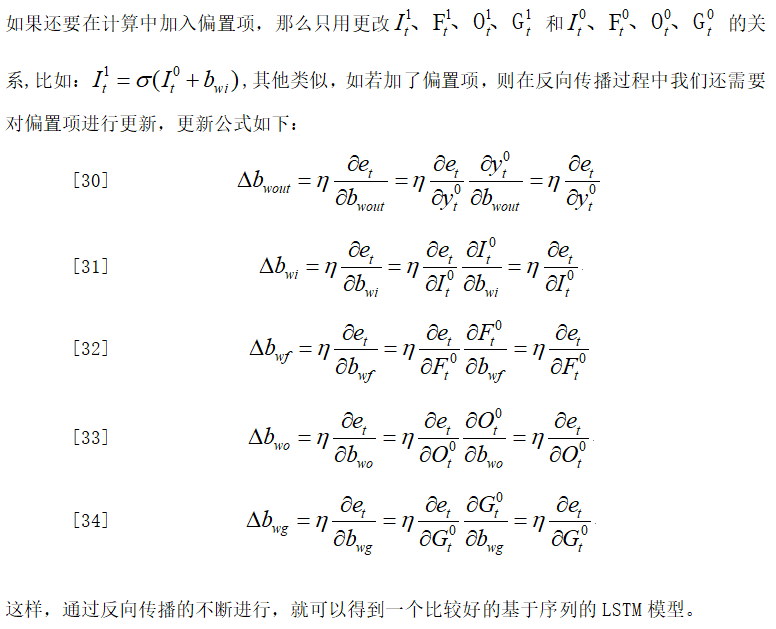

反向传播算法

交流群

欢迎加入公众号读者群一起和同行交流,目前有SLAM、三维视觉、传感器、自动驾驶、计算摄影、检测、分割、识别、医学影像、GAN、算法竞赛等微信群(以后会逐渐细分),请扫描下面微信号加群,备注:”昵称+学校/公司+研究方向“,例如:”张三 + 上海交大 + 视觉SLAM“。请按照格式备注,否则不予通过。添加成功后会根据研究方向邀请进入相关微信群。请勿在群内发送广告,否则会请出群,谢谢理解~