7秒钟的记忆?Facebook提出DL新算法,东南大学90后博士新作

新智元报道

新智元报道

来源:FAIR

编辑:yaxin

【导读】让AI学习东西很容易,但是如何让它学会忘记或许是一个难题。近日,Facebook的研究人员就提出了一种深度学习算法:Expire-Span,教会AI忘记「琐事」。

忘记,是最好的释负。

你还记得去年今天吃的什么吗?

只有那天是特别的日子,我们或许才会想起。

忘记日常琐事,就可以为长期记忆留出空间。

与人类记忆不同,AI神经网络会不加选择地处理所获取的信息,并记住每一个信息。

当前的AI机制过去常常选择性地专注于其输入的某些部分,因此会减慢其处理新信息和执行其设计任务的能力,会导致更高的计算成本。

近日,Facebook的研究人员就解决了人工智能面临的这一难题,让它和人类一样,学会去忘记「琐事」。

Expire-Span:让AI拥有「7秒钟记忆」

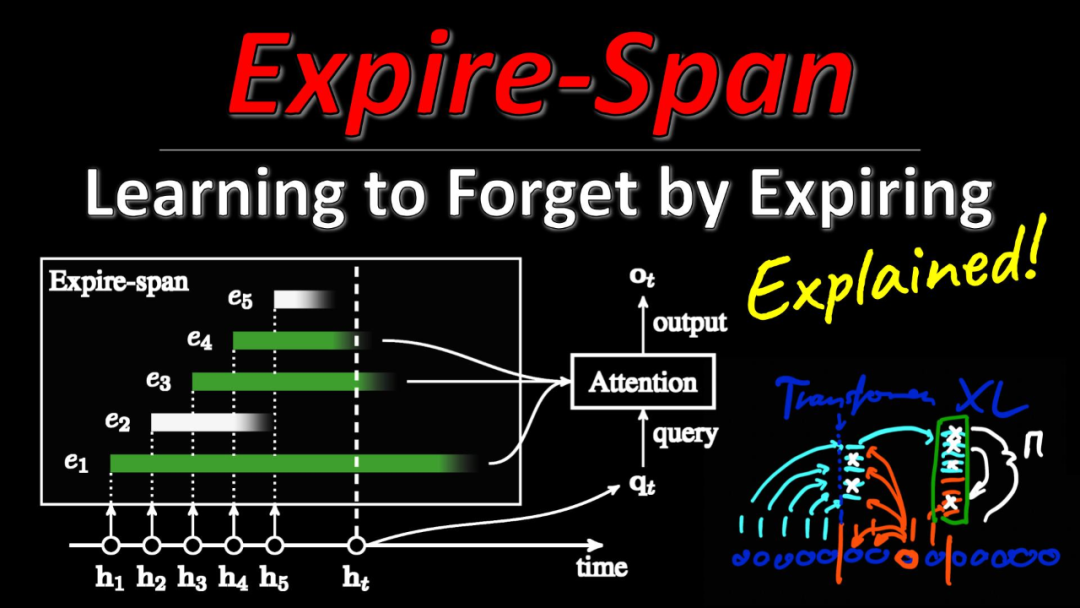

Facebook研究人员为此提出一种深度学习算法:Expire-Span。

该方法可以教深度学习模型如何以及何时大规模地忘记某些细节。

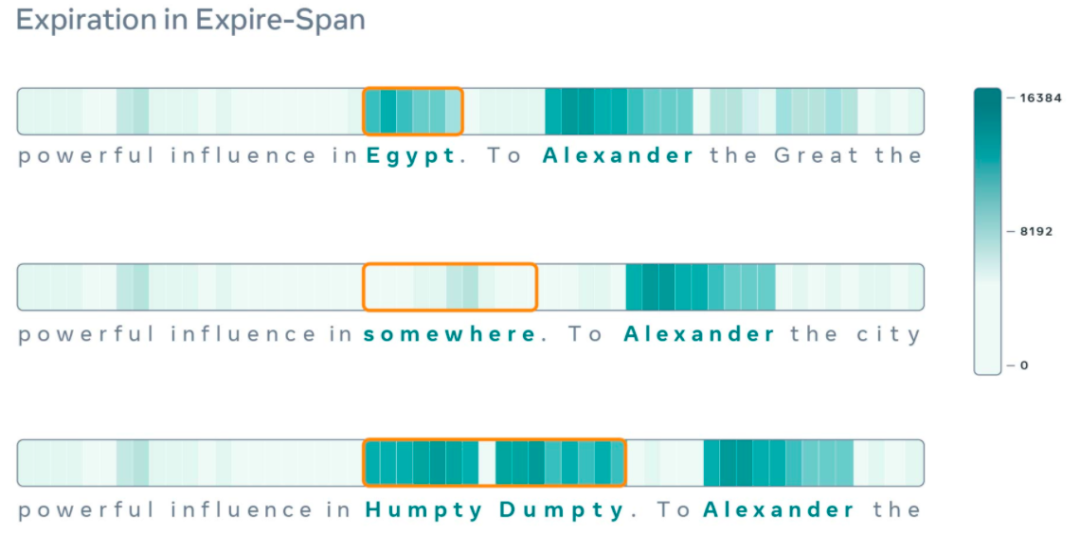

Expire-Span的工作原理是预测所学的信息与编程要完成的任务最相关。

然后,根据上下文,Expire-San为每条信息分配一个到期日期——商品的保质期。

到了截止日期,相关资料便会从人工智能系统中「失效」。

Facebook的研究人员表示,「日期过后,信息将从AI系统中逐渐消失」。

直观地讲,更相关的信息将保留更长的时间,而不相关的信息将更快地过期。有了更多的存储空间,人工智能系统就可以以更大的规模处理信息。

比如,Facebook让AI代理在几个不同颜色的门的图片中找到一个黄色的门。

先前的AI模型会记住搜索正确门所涉及的每个时间步骤,而使用Expire-Span的模型只会记住包含任务描述的第一帧。

具体工作原理

研究人员为神经网络提供时间序列,例如单词、图像或视频帧。

每次显示新信息时,Expire-Span会针对每种隐藏状态计算信息的过期值,并确定该信息作为内存保存的时间。

某些信息的逐渐衰减是保持重要信息而不模糊信息的关键,可学习的机制允许模型根据需要调整跨度大小。

Expire-Span根据从数据中获悉并受其周围存储器影响的上下文来计算预测。

例如,如果模型正在训练以执行单词预测任务,则可以教AI记住诸如名称之类的稀有单词,而忘记诸如and的非常常见的填充词。

通过查看先前的上下文内容,它可以预测是否可以忘记某些内容。通过从错误中吸取教训,随着时间的推移,Expire-Span可以找出重要的信息。

Expire-Span以人脑如何保留记忆为模型。

通过确保信息易于收集,而不是为所学的每一个细节所淹没,它为重要的知识提供了空间。

Expire-Span以相同的方式工作,保留有用的数据,而忽略没有用的东西。

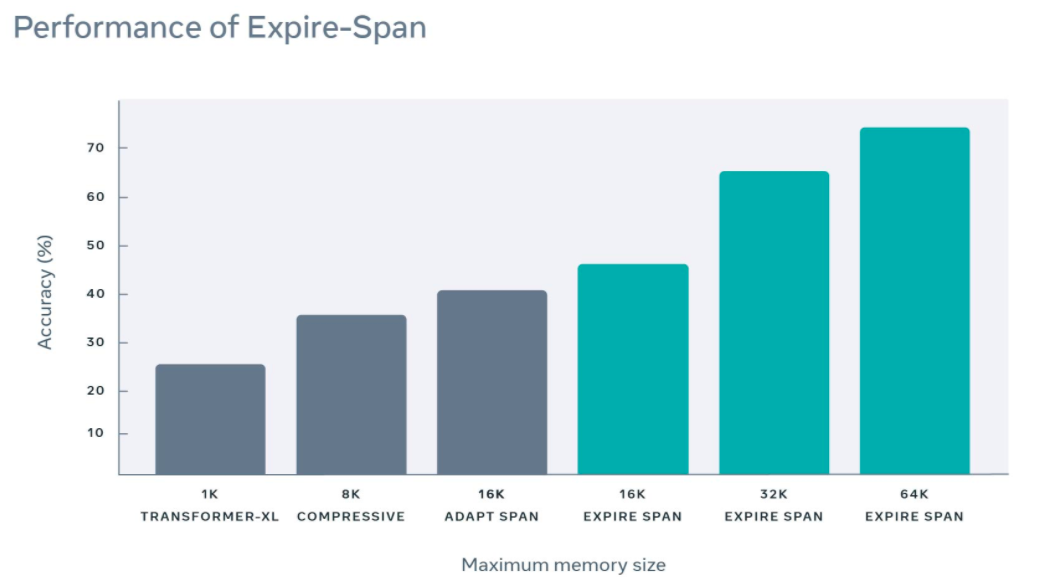

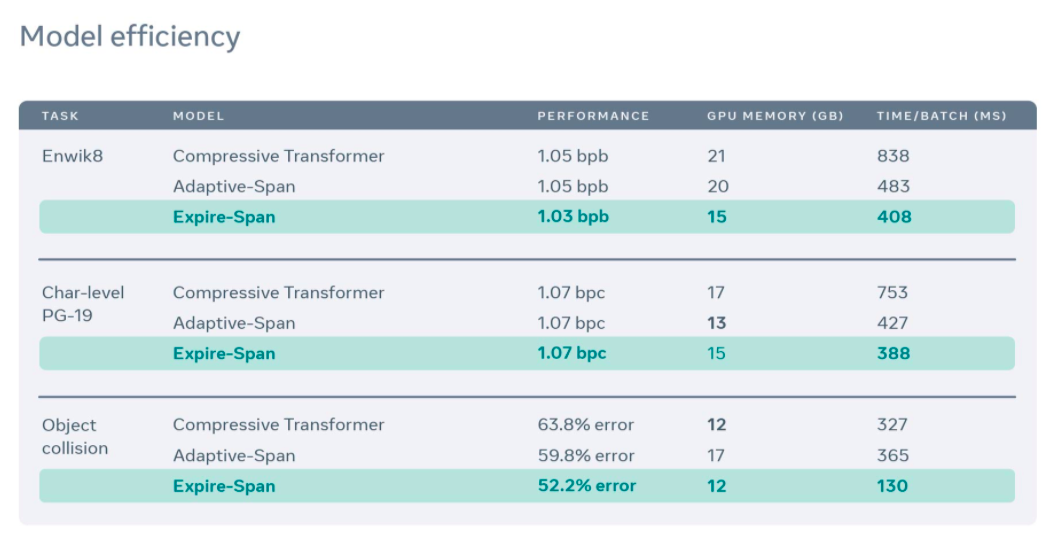

Facebook表示,Expire-Span在跨语言建模,强化学习,对象碰撞和算法任务的多个不同的长上下文任务中提高了AI的效率。

此外,与不使用Expire-Span的旧AI模型相比,它可以扩展到成千上万的信息位,并保留不到一千的信息位,但仍能以更高的效率实现更强大的性能。

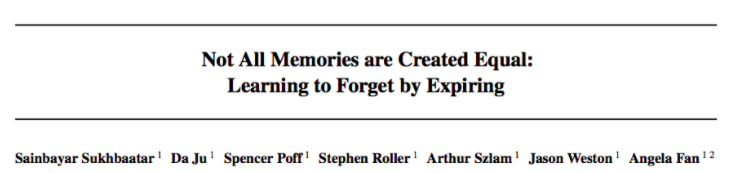

论文一作、二作介绍

Sainbayar Sukhbaatar

个人主页:https://ai.facebook.com/people/sainbayar-sukhbaatar/

在加入FAIR担任研究科学家之前,Sainbayar获得了纽约大学的博士学位。

在此之前,他在东京大学获得了工程学士和硕士学位。他的主要研究兴趣是具有推理和记忆功能的深度学习算法。

Dexter (Da) Ju

个人主页:http://dexterju.me/

Da Ju是 Facebook 人工智能研究中心的研究工程师,是对话研究的软件框架ParlAI团队的一员。

他在2018年加入了这个团队。在此之前,Da Ju在巴黎高等电信学院和巴黎第六大学获得了机器学习专业的硕士学位。他个人对工程学和人工智能研究都很感兴趣。

2015年,Da Ju获得了东南大学信息科学与工程专业的本科学位。

论文地址:

https://ai.facebook.com/research/publications/not-all-memories-are-created-equal

项目地址:

https://github.com/facebookresearch/transformer-sequential

论文视频详解:

https://www.youtube.com/watch?v=2PYLNHqxd5A

参考资料:

https://ai.facebook.com/blog/teaching-ai-how-to-forget-at-scale/

推荐阅读

PyTorch、TensorFlow最新版本对比,2021年了你选谁?

Transformer有可能替代CNN吗?未来有哪些研究方向?听听大家都怎么说

重磅!全球Top 1000计算机科学家h指数公布:中国53位学者上榜!张宏江居大陆科学家之首