全面了解摄像头

点击上方“小白学视觉”,选择加"星标"或“置顶”

重磅干货,第一时间送达

本文转自|AI算法与图像处理

一、摄像头结构和工作原理.

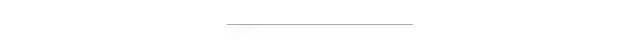

拍摄景物通过镜头,将生成的光学图像投射到传感器上,然后光学图像被转换成电信号,电信号再经过模数转换变为数字信号,数字信号经过DSP加工处理,再被送到电脑中进行处理,最终转换成手机屏幕上能够看到的图像。

数字信号处理芯片DSP(DIGITAL SIGNAL PROCESSING)功能:主要是通过一系列复杂的数学算法运算,对数字图像信号参数进行优化处理,并把处理后的信号通过USB等接口传到PC等设备。DSP结构框架:

1. ISP(image signal processor)(镜像信号处理器)

2. JPEG encoder(JPEG图像解码器)

3. USB device controller(USB设备控制器)

常见的摄像头传感器类型主要有两种,

一种是CCD传感器(Chagre Couled Device),即电荷耦合器。

一种是CMOS传感器(Complementary Metal-Oxide Semiconductor)即互补性金属氧化物半导体。

CCD的优势在于成像质量好,但是制造工艺复杂,成本高昂,且耗电高。在相同分辨率下,CMOS价格比CCD便宜,但图像质量相比CCD来说要低一些。CMOS影像传感器相对CCD具有耗电低的优势,加上随着工艺技术的进步,CMOS的画质水平也不断地在提高,所以目前市面上的手机摄像头都采用CMOS传感器。

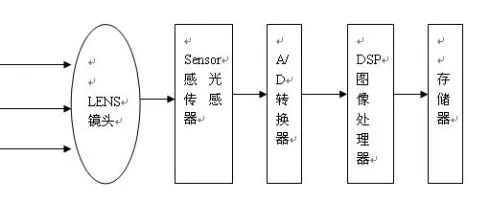

手机摄像头的简单结构

滤光片有两大功用:

1.滤除红外线。滤除对可见光有干扰的红外光,使成像效果更清晰。

2.修整进来的光线。感光芯片由感光体(CELL)构成,最好的光线是直射进来,但为了怕干扰到邻近感光体,就需要对光线加以修整,因此那片滤光片不是玻璃,而是石英片,利用石英的物理偏光特性,把进来的光线,保留直射部份,反射掉斜射部份,避免去影响旁边的感光点.

二、相关参数和名词

1、常见图像格式

1.1 RGB格式:

传统的红绿蓝格式,比如RGB565,RGB888,其16-bit数据格式为5-bit R + 6-bit G + 5-bit B。G多一位,原因是人眼对绿色比较敏感。

1.2 YUV格式:

luma (Y) + chroma (UV) 格式。YUV是指亮度参量和色度参量分开表示的像素格式,而这样分开的好处就是不但可以避免相互干扰,还可以降低色度的采样率而不会对图像质量影响太大。YUV是一个比较笼统地说法,针对它的具体排列方式,可以分为很多种具体的格式。

色度(UV)定义了颜色的两个方面─色调与饱和度,分别用CB和CR表示。其中,Cr反映了RGB输入信号红色部分与RGB信号亮度值之间的差异。而Cb反映的是RGB输入信号蓝色部分与RGB信号亮度值之间的差异。

主要的采样格式有YCbCr 4:2:0、YCbCr 4:2:2、YCbCr 4:1:1和 YCbCr 4:4:4。

1.3 RAW data格式:

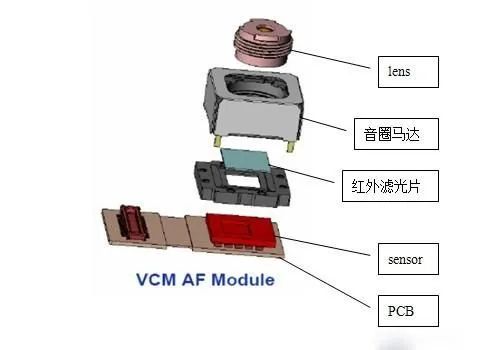

RAW图像就是CMOS或者CCD图像感应器将捕捉到的光源信号转化为数字信号的原始数据。RAW文件是一种记录了数码相机传感器的原始信息,同时记录了由相机拍摄所产生的一些元数据(Metadata,如ISO的设置、快门速度、光圈值、白平衡等)的文件。RAW是未经处理、也未经压缩的格式,可以把RAW概念化为“原始图像编码数据”或更形象的称为“数字底片”。sensor的每一像素对应一个彩色滤光片,滤光片按Bayer pattern分布。将每一个像素的数据直接输出,即RAW RGB data

Raw data(Raw RGB)经过彩色插值就变成RGB.

RAW格式图像示例

2. 相关技术指标

2.1 图像解析度/分辨率(Resolution):

SXGA(1280 x1024)又称130万像素

XGA(1024 x768)又称80万像素

SVGA(800 x600)又称50万像素

VGA(640x480)又称30万像素(35万是指648X488)

CIF(352x288) 又称10万像素

SIF/QVGA(320x240)

QCIF(176x144)

QSIF/QQVGA(160x120)

2.2 彩色深度(色彩位数):

256色灰阶,有256种灰色(包括黑白)。

15或16位彩色(高彩色):65,536种颜色。

24位彩色(真彩色):每种原色都有256个层次,它们的组合便有256*256*256种颜色。

32位彩色:除了24位彩色的颜色外,额外的8位是储存重叠图层的图形资料(alpha频道)。

2.3 光学变焦和数码变焦:

光学变焦: 通过镜头的调整,拉近拉远所要拍摄的对象,保持像素不变和画质基本不变,却可以拍到自己 理想的物像。

数码变焦:其实没有什么变焦,只是从原图片中截取出来放大,你从液晶屏幕上看到变大了,实际上画质并没有本质提高,而像素比你相机能拍摄的最大像素降低了。画质上说基本是鸡肋把,但是可以提供一些方便。

2.4 图像压缩方式:

JPEG/M-JPEG

H.261/H.263

MPEG

H.264

2.5 图像噪音:

指的是图像中的杂点干挠。表现为图像中有固定的彩色杂点。

2.6 自动白平衡处理技术(auto White Balance):

简单来说就是:摄像机对白色物体的还原。相关概念:色温。

2.7 视角:

与人的眼睛成像是相成原理,简单说就是成像范围。

2.8 自动对焦:

自动对焦可以分成两大类:一类是基于镜头与被拍摄目标之间距离测量的测距自动对焦,另一类是基于对焦屏上成像清晰的聚焦检测自动对焦(清晰度算法)。

注:变焦就是把远处的物体拉近。对焦是让图像清晰。

2.9 自动曝光和Gamma:

就是光圈和快门的组合。光圈,快门速度,ISO。Gamma即人眼对亮度的响应曲线。

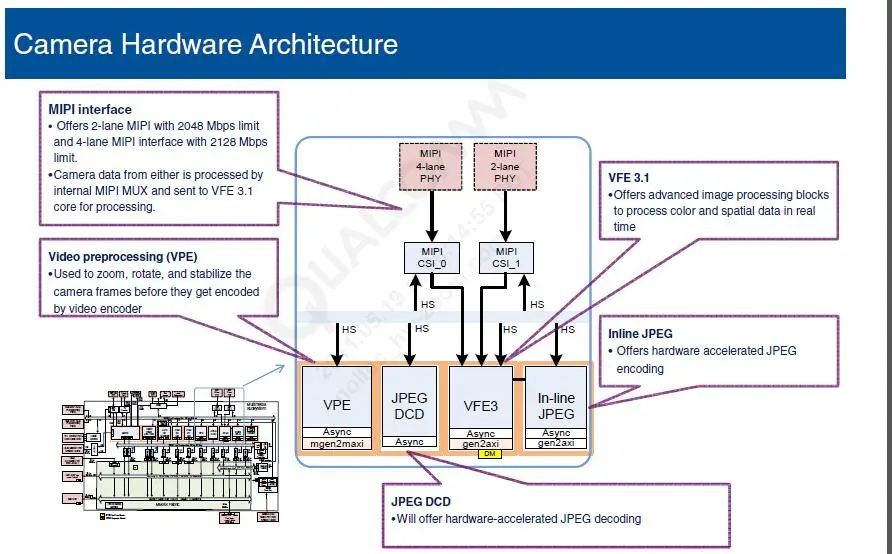

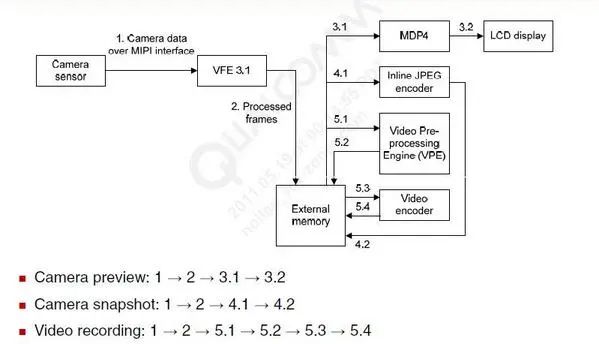

三、高通的CAMERA部分硬件架构

CAMERA部分硬件架构

VFE:VIDEO front-end 视频前端

VPE:Video preprocessing 视频预处理

摄像头模组中自带了ISP(图像信号处理器),所以,VFE和VPE有关图像效果处理的功能都是关闭的。

1.VFE的功能:

1.1 通过算法提高图像的质量。

1.2 提供高分辨率的图像的AWB(自动白平衡)/AE(自动曝光)/AF(自动对焦)算法处理。

1.3 图像衰减校正。

1.4 低光下的噪声滤波。

1.5 图像色彩效果优化。

1.6 皮肤颜色效果优化。

1.7 图像抖动计算。

1.8 亮度适应算法。

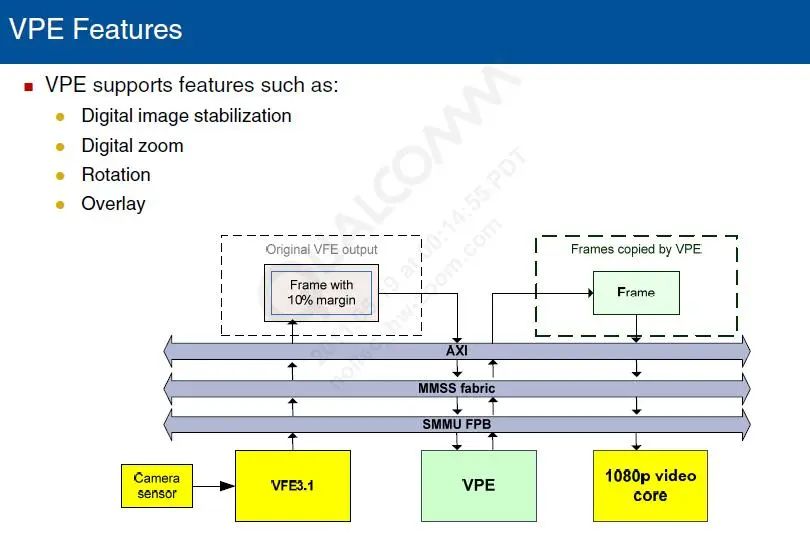

2.VPE的功能:

2.1 图像稳定性。

2.2 数字对焦。

2.3 图像旋转。

2.4 Overlay。

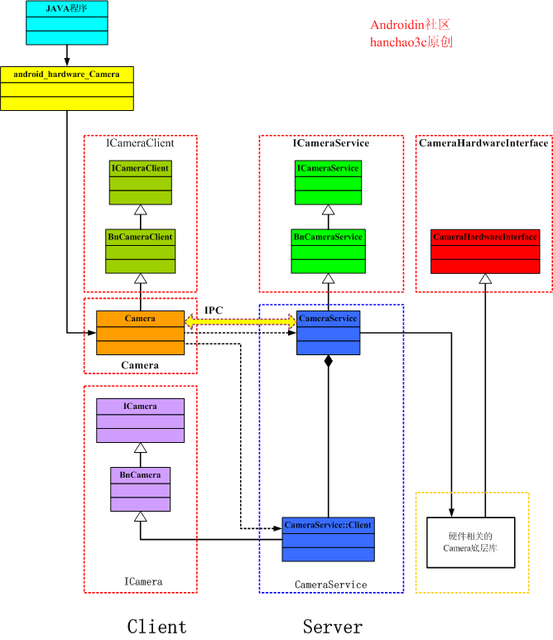

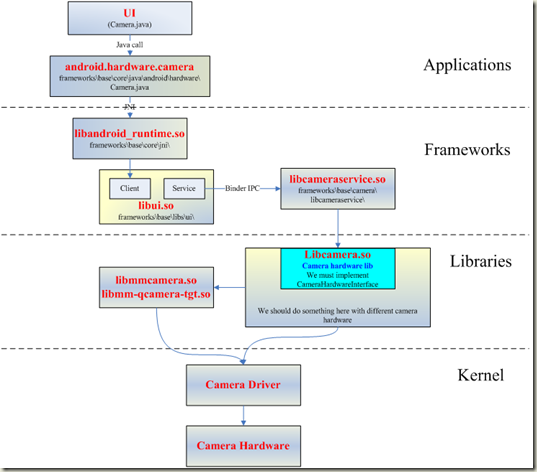

三、android系统camera基本架构

1.应用层

Camera 的应用层在Android 上表现为直接调用SDK API 开发的一个Camera 应用APK 包。代码在/android/packages/apps/Camera 下。主要对 android.hardware.Camera(在Framework中) 类的调用,并且实现Camera 应用的业务逻辑和UI 显示。一个Android 应用中若要使用这个android.hardware.Camera类,需要在Manifest 文件声明Camera 的权限,另外还 需要添加一些<uses-feature> 元素来声明应用中的Camera 特性,如自动对焦等。 具体做法可如下:

<uses-permission android:name = "android.permission.CAMERA" />

<uses-feature android:name = "android.hardware.camera" />

<uses-feature android:name = "android.hardware.camera.autofocus" />

2.Framework层

2.1 android.hardware.Camera:代码位置/android/frameworks/base/core/java/android/hardware/Camera.java

这部分目标是framework.jar。这是是Android 提供给app层调用的java接口。这个类用来连接或断开一个Camera 服务,设置拍摄参数,开始、停止预览,拍照等。

2.2 android.hardware.Camera这个类是和JNI中定义的类是一个,有些方法通过JNI的方式调用本地代码得到,有些方法自己实现。

Camera的JAVA native调用部分(JNI):/android/frameworks/base/core/jni/android_hardware_Camera.cpp。Camera.java 承接JAVA 代码到C++ 代码的桥梁。编译生成libandroid_runtime.so 。libandroid_runtime.so库是公用的, 其中除了Camera 还有其他方面的功能。

2.3 Camera框架的client部分:

代码位置:/android/frameworks/base/libs/camera/下5个文件。

Camera.cpp

CameraParameters.cpp

ICamera.cpp

ICameraClient.cpp

ICameraService.cpp

它们的头文件在/android/frameworks/base/include/camera目录下。

这部分的内容编译生成libcamera_client.so 。在Camera 模块的各个库中,libcamera_client.so 位于核心的位置,作为Camera 框架的 Client 客户端部分,与另外一部分内容服务端 libcameraservice.so 通过进程间通讯(即Binder 机制)的方式进行通讯。

2.4 Camera框架的service部分:

代码位置:/android/frameworks/base/services/camera/libcameraservice。

这部分内容被编译成库libcameraservice.so 。CameraService 是Camera 服务,Camera 框架的中间层,用于链接CameraHardwareInterface 和Client部分 ,它通过调用实际的Camera 硬件接口来实现功能,即下层HAL层。

四. 摄像头预览、拍照、录像基本数据流向和处理流程以及驱动调试

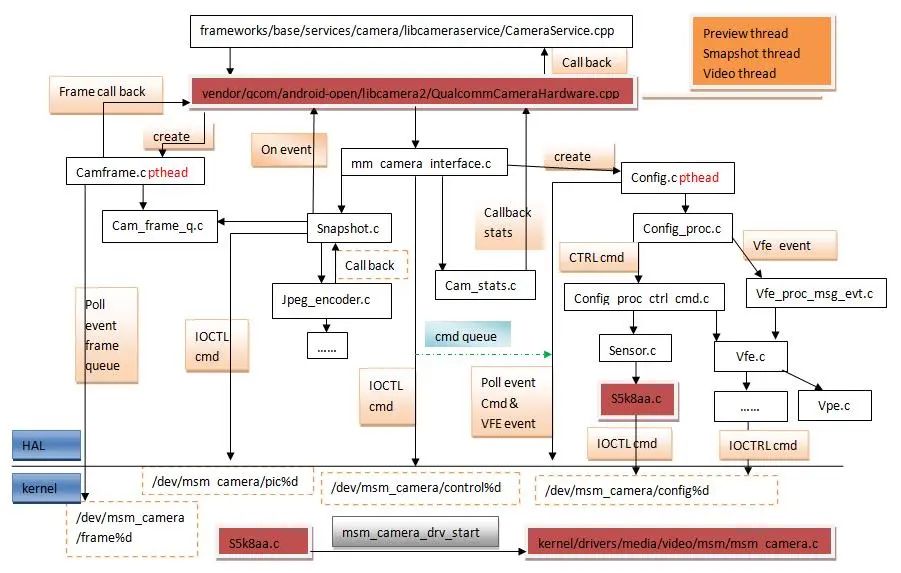

HAl层相关代码:(frameworks/base/services/camera/libcameraservice/CameraService.cpp)vendor/qcom/android-open/libcamera2/QualcommCameraHardware.cppvendor/qcom/proprietary/mm-camera/apps/appslib/mm_camera_interface.cvendor/qcom/proprietary/mm-camera/apps/appslib/camframe.cvendor/qcom/proprietary/mm-camera/apps/appslib/snapshot.cvendor/qcom/proprietary/mm-camera/apps/appslib/jpeg_encoder.cvendor/qcom/proprietary/mm-camera/apps/appslib/cam_frame_q.cvendor/qcom/proprietary/mm-camera/apps/appslib/cam_display.cvendor/qcom/proprietary/mm-camera/targets/vfe31/8x60/vendor/qcom/proprietary/mm-camera/targets/vfe31/common/vpe1/QualcommCameraHardware.cpp主要分为三个部分,preview,snapshot,video。它们分别用一个pthread进行处理。另外还有auto focus功能也是用pthread的方式处理。预览或拍照、视频线程处理得到的数据帧都以datacallback的方式回调到上层CameraService.cpp中,进行存储或预览等操作。以下是HAL层部分的代码大概的调用结构流程。

整个模块主要巡行三个主线程:control、config及frame。

control用来执行总的控制,是上层控制接口。

config主要进行一些配置,这个线程里面主要进行3A的工作,另外还有一些跟效果有关的设置;

frame线程主要用来做帧queue的循环获取处理。所有事件或状态的反馈,用回调函数的方式传回QualcommCameraHardware.cpp。

2. 驱动部分从设备驱动s5k8aa.c开始。新建平台设备后,执行入口函数probe时,调用创建摄像头设备功能函数

int msm_camera_drv_start(struct platform_device *dev,

int (*sensor_probe)(const struct msm_camera_sensor_info *,

struct msm_sensor_ctrl *))

并将设备信息结构体和摄像头设备调用入口sensor_probe传入。msm_camera_drv_start(xxx)函数在msm_camera.c中实现。他创建了提供上层调用的四个终于设备结点:

/dev/msm_camera/frame%d

/dev/msm_camera/control%d

/dev/msm_camera/config%d

/dev/msm_camera/pic%d

实现了上层库对VFE模块,VPE模块,jpeg_encoder模块和摄像头sensor模块驱动的控制调用接口。在file_operations中的相应函数中分别实现的是这些设备的新建初始化和IOCTL功能调用接口。

然后这个函数还创建了四个工作队列:

struct msm_device_queue event_q;

struct msm_device_queue frame_q;

struct msm_device_queue pict_q;

struct msm_device_queue vpe_q;

event_q包括/dev/msm_camera/control%d传入的控制信号队列,用于将上层传下来的控制命令(command)传到config thread中去。

frame_q用于对图像帧的操作管理,预览或录像时帧将传递给DSP进行处理。

pict_q包含拍照帧,用于给jpeg_encoder进行图像编码处理。

vpe_q是VPE控制命令队列。

s5k8aa.c是相应摄像头设备的驱动部分。它的功能很简单,主要实现sensor模块的创建、初始化和控制。主要实现以下三个函数:

s->s_init = ov2685_sensor_init;

s->s_release = ov2685_sensor_release;

s->s_config = ov2685_sensor_config;

ov2685_sensor_init函数:

主要实现摄像头的上电、时钟控制(MCLK)、设备初始化功能。 上电分为DOVDD、DVDD、AVDD、reset、PWDN几个部分。需要按照设备要求顺序操作,一般时钟控制顺序也包含在内。 设备初始化过程是将sensor设备的所有寄存器全部初始化一遍,采用IIC方式将初始化寄存器地址和值全部发送到sensor端。完成后此时摄像头模组才能正常工作,并将图像通过MIPI线路传送到CPU端。

ov2685_sensor_config函数:

主要实现对sensor的各种配置接口,相应的有帧率配置,白平衡效果设置,曝光度设置,特效设置等等。相应接口将配置好的寄存器列表通过IIC发送到sensor中。

3. 摄像头调试中的几个问题点:

1.1 是否正确上电,是否有时钟波形输出。 检测输出电压的电压值是否和上电时序以及MCLK是否符合sensor的要求。这部分可以用示波器和万用表测量。测量电压值和上电时序以及MCLK的时钟频率是否正确。

1.2 IIC读写是否正常。调试CPU与ISP间的I2C通信。 检测包括IIC地址是否正确,协议是否匹配。这部分也可以用示波器测量IIC的SDA、CLK的峰值、波形逻辑是否正确。

1.3 正确上电并初始化以后sensor模块是否正常工作。 这部分主要通过用示波器测量MIPI线路的数据和时钟PIN是否正确,它的波形是否含有数据,是否标准波形,峰值有没有达到要求等。

1.4 如果以上都正确了以后,MIPI控制器将接收到中断,并开始处理图像信号。此时如果出错,可以通过中断信号的出错值查看错误状态。除CPU端是否正常初始化工作的问题外,需要关注模组端设置的图像格式和CPU接收的默认图像格式和图像大小(SIZE)是否一致。模组中图片格式和图像大小通过寄存器值查看。CPU端接收图片格式和图像大小在HAL部分的s5k8aa中设置, 拍照源图像大小和预览源图像大小需要分别设置。

以上部分完成后,摄像头可以正确预览。

End

End

交流群

欢迎加入公众号读者群一起和同行交流,目前有SLAM、三维视觉、传感器、自动驾驶、计算摄影、检测、分割、识别、医学影像、GAN、算法竞赛等微信群(以后会逐渐细分),请扫描下面微信号加群,备注:”昵称+学校/公司+研究方向“,例如:”张三 + 上海交大 + 视觉SLAM“。请按照格式备注,否则不予通过。添加成功后会根据研究方向邀请进入相关微信群。请勿在群内发送广告,否则会请出群,谢谢理解~