将Python网络爬虫的数据追加到csv文件

回复“资源”即可获赠Python学习资料

大家好,我是皮皮。

一、前言

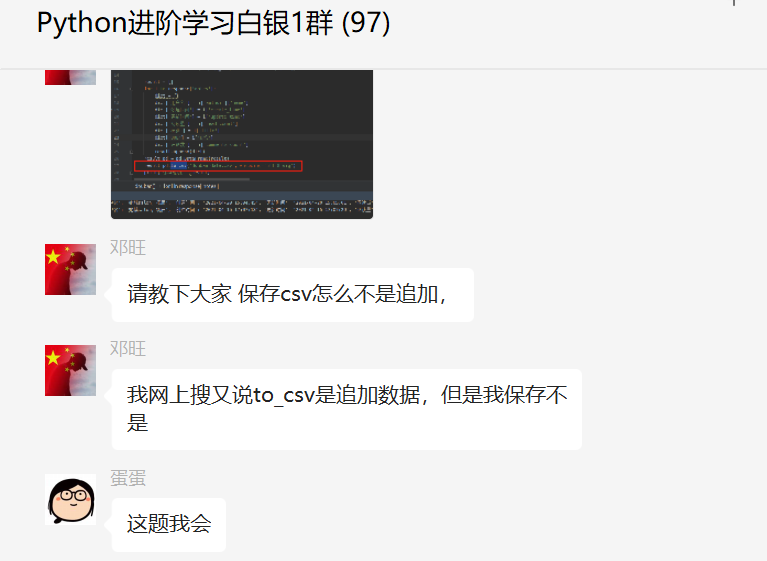

前几天在Python白银交流群有个叫【邓旺】的粉丝问了一个将Python网络爬虫的数据追加到csv文件的问题,这里拿出来给大家分享下,一起学习下。

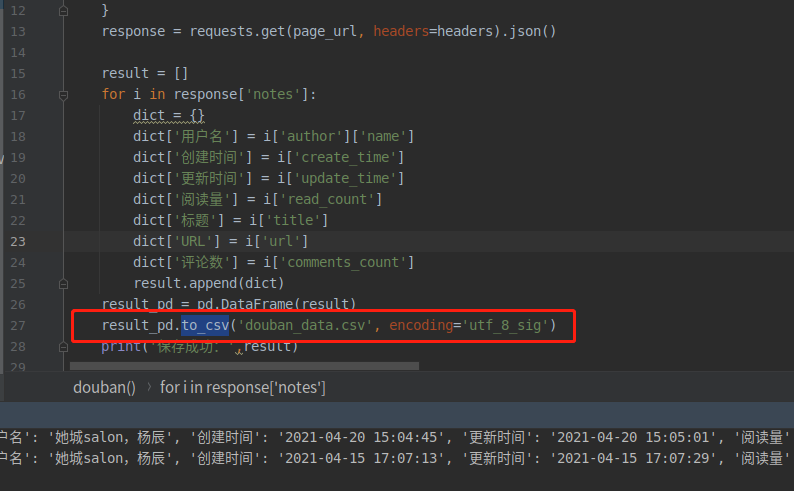

问题如下:

二、解决过程

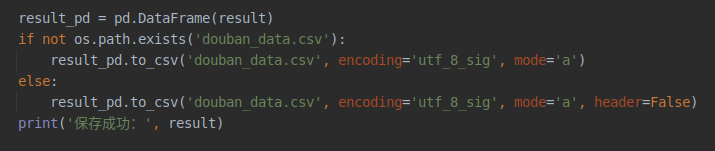

这里【蛋蛋】给出了一个代码,如下所示:

df.to_csv('FILE_NAME.txt',index=False,encoding='GBK')

不过看上去没解决打到痛点,【月神】补充了一下,to_csv里面的参数默认为mode='w',即覆盖写入,改成mode='a'就行了。这个mode含义和open()函数中的mode含义一样,这样理解起来就简单很多了。

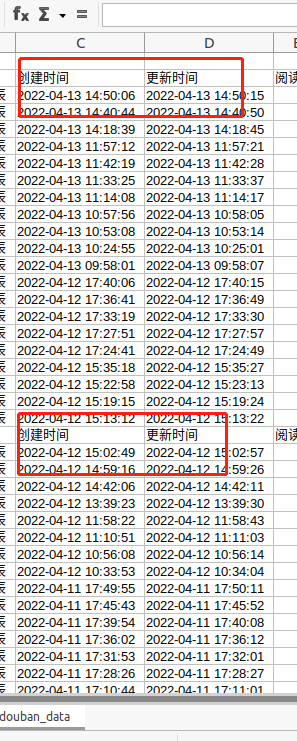

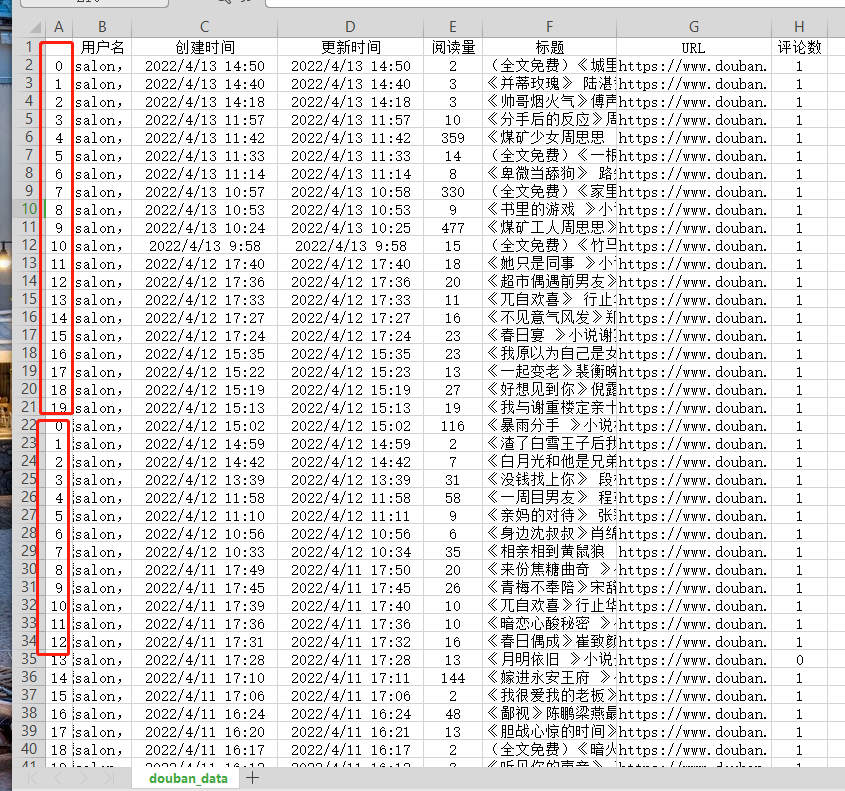

更改好之后,刚那个问题解决了,不过新问题又来了,如下图所示,重复保存标题栏了。

更改好之后,刚那个问题解决了,不过新问题又来了,如下图所示,重复保存标题栏了。

这里【瑜亮老师】给了一个思路,设置参数header=False,这样就没有表头了。

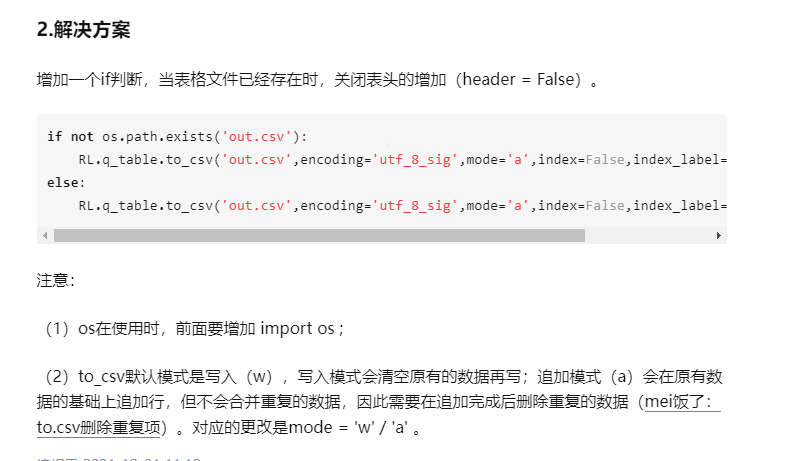

后来粉丝自己在网上找到了一个教程,代码如下:

后来粉丝自己在网上找到了一个教程,代码如下:

if not os.path.exists('out.csv'):

RL.q_table.to_csv('out.csv',encoding='utf_8_sig',mode='a',index=False,index_label=False)

else:

RL.q_table.to_csv('out.csv',encoding='utf_8_sig',mode='a',index=False,index_label=False,header=False)

完美地解决了他的问题。

完美地解决了他的问题。

而且写入到文件中,也没用冗余,关键的在于设置

而且写入到文件中,也没用冗余,关键的在于设置index=False。

事实证明,在实战中学东西更快!

事实证明,在实战中学东西更快!

三、总结

大家好,我是皮皮。这篇文章主要分享了将Python网络爬虫的数据追加到csv文件的问题,文中针对该问题给出了具体的解析和代码演示,帮助粉丝顺利解决了问题。

最后感谢粉丝【邓旺】提问,感谢【月神】、【蛋蛋】、【瑜亮老师】给出的具体解析和代码演示,感谢【dcpeng】、【艾希·觉罗】等人参与学习交流。

小伙伴们,快快用实践一下吧!如果在学习过程中,有遇到任何问题,欢迎加我好友,我拉你进Python学习交流群共同探讨学习。

------------------- End -------------------

往期精彩文章推荐:

欢迎大家点赞,留言,转发,转载,感谢大家的相伴与支持

想加入Python学习群请在后台回复【入群】

万水千山总是情,点个【在看】行不行

评论