南开提出轻量级LSKNet网络 | 突破遥感图像分类挑战再创佳绩!

共 25590字,需浏览 52分钟

· 2024-04-11

点击下方卡片,关注「AI视界引擎」公众号

遥感图像因其固有的复杂性对下游任务提出了独特的挑战。

虽然已有大量研究致力于遥感图像的分类、目标检测和语义分割,但其中大多数研究忽视了遥感场景中嵌入的宝贵先验知识。这种先验知识可能很有用,因为如果不参考足够长的范围上下文,遥感目标可能会被错误地识别,而这个范围上下文对于不同的目标可能会有所不同。

本文考虑了这些先验知识,并提出了一种轻量级的大选择性核网络(LSKNet) Backbone 网络。LSKNet可以动态调整其大的空间感受野,以更好地模拟遥感场景中各种目标的范围上下文。

据作者所知,在遥感图像中尚未探索过大型选择性核机制。作者的轻量级LSKNet没有花哨的装饰,就在标准的遥感图像分类、目标检测和语义分割基准测试中设立了新的最先进的成绩。作者的综合分析进一步验证了所识别先验的重要性及LSKNet的有效性。

代码:https://github.com/zcablii/LSKNet

1 Introduction

遥感图像由于其复杂性质,包括高分辨率、随机方向、类内大变异、多尺度场景和密集的小目标,为下游任务带来了独特的挑战。为了应对这些挑战,已经进行了大量研究,研究重点包括诸如特征集成技术[1, 2, 3, 4]和大规模预训练[5, 6]等分类方法。此外,还提出了针对目标检测任务的旋转方差[7, 8, 9]解决方法,或采用新的定向框编码[10, 11]。此外,还探索了多尺度特征融合[12, 13, 14, 15, 16, 17]技术的整合,以增强检测和分割任务的性能。

尽管取得了这些进展,相对而言,很少有研究考虑了遥感图像的强烈先验知识。航空图像通常以高分辨率从鸟瞰视角捕捉。特别是,航空图像中的大多数物体可能比较小,仅凭外观很难识别。相反,识别这些物体依赖于它们的环境上下文,因为周围环境可以提供关于它们形状、方向等特征的宝贵线索。根据对遥感数据的分析,作者确定了两个重要的先验知识:

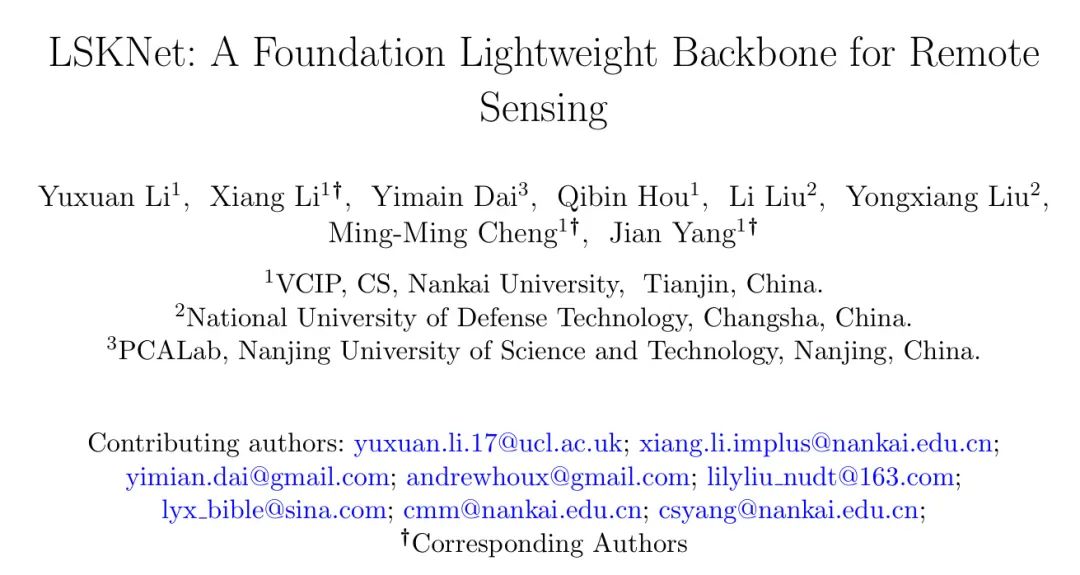

准确的识别通常需要广泛的环境信息。 如图1所示,在遥感图像中,目标检测器使用的有限上下文常常会导致分类错误。不是它们的外观,而是上下文将船与车辆区分开来。

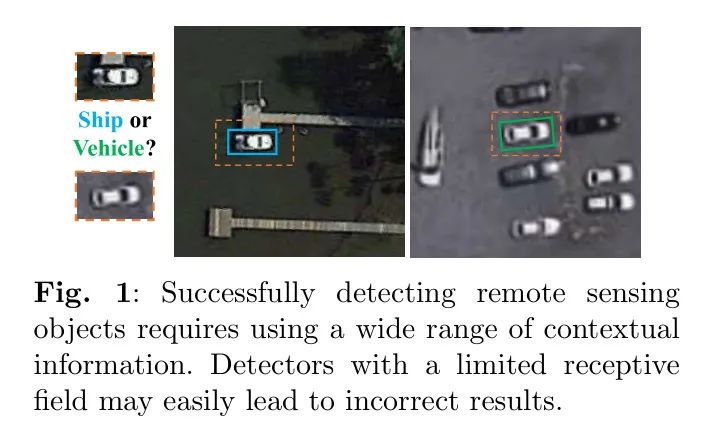

不同物体所需的环境信息非常不同。 如图2所示,由于独特的可辨别边界线,足球场需要相对较少的环境信息。相比之下,环形交叉路口可能需要更多上下文信息来区分花园和环状建筑物。而交叉口,特别是那些部分被树木覆盖的交叉口,由于相交道路之间的长距离依赖性,需要一个非常大的感受野。

为了解决在遥感图像中准确识别物体这一挑战,这通常需要广泛且动态的上下文信息,作者提出了一种新颖的轻量级主干网络,称为大型选择性核网络(LSKNet)。作者的方法在特征提取主干内部采用了一个动态调节的接受域,这使得能够更有效地容纳和处理所需的不同范围的广泛上下文。这是通过一个空间选择机制实现的,该机制有效地对一系列大型深度方向核处理过的特征进行加权,然后在空间上合并它们。这些核的权重是根据输入动态确定的,使得模型能够自适应地使用不同的大的核,并根据需要调整每个物体在空间中的接受域。

本文展示了作者之前工作LSKNet[18]和SKNet[19]的扩展版本。具体来说,作者进行了进一步的实验,以评估作者提出的LSKNet Backbone 网络在广泛的遥感应用中的泛化能力,包括在UCM [20],AID [21],和NWPU [22]数据集上的遥感场景分类,在合成孔径雷达模态数据集SAR-Aircraft [23]上的目标检测,以及在Potsdam [24],Vaihingen [25],LoveDA [26],和UAVid [27]数据集上的语义分割任务。此外,作者还对LSKNet和SKNet进行了彻底而全面的比较,以突出LSKNet的差异和优势。

总之,作者的贡献可以归纳为以下四个主要方面:

作者确定了在遥感数据中存在的两个重要先验信息。

据作者所知,所提出的LSKNet Backbone 网络是首次探索在遥感下游任务中利用大型选择性核来精确利用上述先验知识。

尽管作者的模型简单且轻便,但在包括遥感场景分类(UCM [20],AID [21],NWPU [22])、目标检测(DOTA [28],HRSC2016 [29],FAIR1M [30],SAR-Aircraft [23])以及语义分割(Potsdam [24],Vaihingen [25],LoveDA [26],UAVid [27])在内的三个著名遥感任务上,在11个广泛使用的公共数据集上取得了最先进的表现。

作者提供了对作者方法的全面分析,进一步验证了所识别先验的重要性以及LSKNet模型在解决遥感挑战中的有效性。

2 Related Work

Remote Sensing

遥感图像场景分类。 遥感图像中的场景分类是一项具有挑战性的任务,这是由于复杂背景的存在以及类内差异显著。为了应对这一挑战,已经提出了几种模型,如MGML [2],ESD [3] 和 KFBNet [4]。这些模型旨在利用集成技术融合多 Level 特征以提高分类性能。随着Vision Transformer(ViT)[31]的出现,基于大型ViT的模型[32, 33]的数量也在增加。此外,最近的高性能ViT-based模型,如RSP-ViTAE [5, 34] 和 RVSA [6],已经在大型遥感数据集millionAID[35]上进行预训练,进一步推进了这一领域的能力。

然而,特征集成通常会在 Backbone 网络中引入多个分支,这会导致结构复杂且计算效率低下。同样,使用基于ViT的 Backbone 网络可能导致模型变得庞大且资源消耗大,这可能不适合某些实际应用场景。

遥感目标检测。 遥感目标检测[36, 37, 38]专注于在航拍图像中识别和定位感兴趣的目标。近期的一个主流趋势是生成能准确适应被检测目标方向的边界框。因此,大量研究集中在改进面向遥感目标检测的定向边界框表示。为缓解卷积神经网络中固有的旋转变化,已经引入了几个著名的检测框架,包括RoI Transformer [39]、Oriented RCNN[10]、S A网络[40]、DRN[41]和R3Det[8]。Oriented RCNN[10]和Gliding Vertex[11]通过引入新的边界框编码系统,对因旋转角度周期性引起的训练损失不稳定问题做出了重要贡献。此外,像GWD[9]、KLD[42]和LD[43]这样的技术已经被开发出来,以解决回归损失的间断性或增强边界框的定位质量。

尽管这些方法在解决旋转变化问题上取得了有希望的结果,但它们并没有考虑到航空图像中呈现出的强大且有价值的先验信息。相比之下,作者的方法使用了大核空间选择机制来更好地模拟这些先验信息,而无需修改当前的检测框架。

遥感语义分割。 遥感语义分割模型最新的进展主要集中在采用注意力机制和多尺度特征融合技术[12, 13, 14, 15, 16, 47]。这些方法有效地聚合了细粒度细节和粗粒度语义,从而在分割性能上取得了显著的提升。因此,很明显,在多尺度特征融合中融入大接收域语义在分割任务中起着关键作用。

尽管现有方法取得了一定的成功,但常常可以发现它们忽视了前面提到的有价值的前置知识_。相比之下,作者提出的主干网络模型考虑了遥感图像中的有价值先验,这提供了更灵活的多范围感受野特征以克服这一局限。

Large Kernel Networks

基于Transformer的模型,如Vision Transformer (ViT) [31, 6],Swin transformer [49, 50, 51, 52],以及pyramid transformer [53, 54],在计算机视觉中越来越受欢迎。研究[55, 56, 57, 58]表明,大感受野是它们成功的关键因素。最近的工作显示,具有大感受野的精心设计的卷积网络也能与基于Transformer的模型高度竞争。例如,ConvNeXt [60]在其主干网络中使用7 7深度卷积,从而在下游任务中实现了显著的性能提升。此外,RepLKNet [61]通过重参化甚至使用一个31 31的卷积核,取得了令人信服的性能。后续工作SLaK [62]进一步通过核分解和稀疏组技术将核尺寸扩大到51 51。RF-Next [63]为各种任务自动搜索固定的大核。VAN [64]提出了一种将大核高效分解为卷积注意力的方法。同样,SegNeXt [65]和Conv2Former [66]证明,大核卷积在用更丰富的上下文调节卷积特征方面起着重要作用。

尽管大核卷积在一般物体识别中受到了关注,但在遥感检测中对它们重要性的研究一直不足。如前文1所述,航拍图像具有独特的特性,使大核特别适合于遥感应用。据作者所知,作者的工作首次尝试将大核卷积引入遥感领域,并研究它们在这一领域的重要性。

Attention/Selective Mechanism

注意力机制[67]是一种简单但有效的方法,用于增强各种任务中的神经表征。通道注意力SE块[68]使用全局平均信息来重新加权特征通道,而像GENet[69]、GCNet[70]和SGE[71]这样的空间注意力模块通过空间 Mask 增强了网络对上下文信息的建模能力。CBAM[72]和BAM[73]结合了通道注意力和空间注意力。

除了通道/空间注意力机制外,核选择是一种自我适应且有效的技术,用于动态上下文建模。CondConv [74] 和 Dynamic convolution [75] 使用并行核以自适应地从多个卷积核中聚合特征。SKNet [19] 引入了带有不同卷积核的多分支,并沿着通道维度选择性地将它们结合起来。ResNeSt [44] 通过将输入特征图划分为几组来扩展SKNet的想法。与SKNet类似,SCNet [45] 使用分支注意力来捕捉更丰富的信息,以及空间注意力来提高定位能力。Deformable Convnets [76, 77] 为卷积单元引入了一种灵活的核形状。

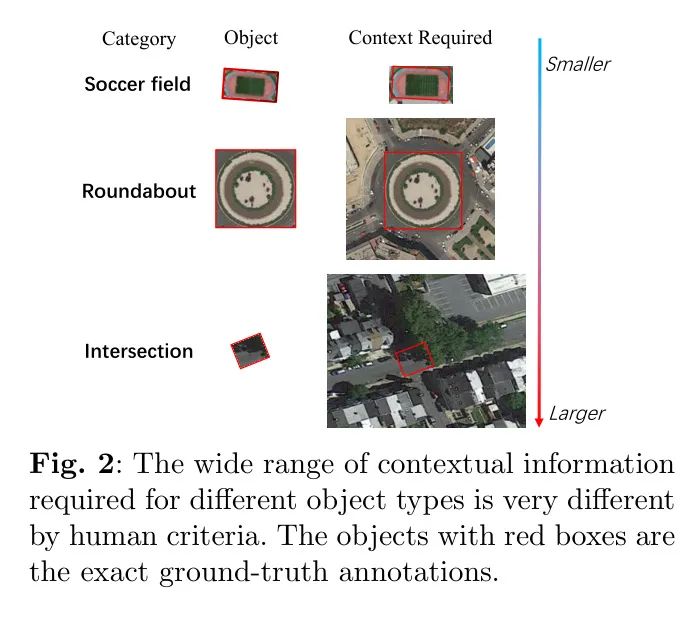

作者的方法与SKNet [19] 最相似。然而,这两种方法之间存在两个关键区别。首先,作者提出的选择机制明确依赖于通过分解的一系列大核,这与大多数现有的基于注意力的方法不同。其次,作者的方法在空间维度上自适应地聚合大核的信息,而不是像SKNet那样在通道维度上。这种设计对于遥感任务来说更加直观有效,因为通道选择无法对图像空间中不同目标的空间变化进行建模。详细的结构对比列于图3中。

3 Methods

LSKNet Architecture

LSKNet主干的总体架构简单基于重复的LSK块(具体细节见补充材料)。LSK块受到了ConvNeXt [78]、MetaFormer [79]、PVT-v2 [80]、Conv2Former [66]和VAN [64]的启发。每个LSK块由两个残差子块组成:大核选择(LK选择)子块和前馈网络(FFN)子块。

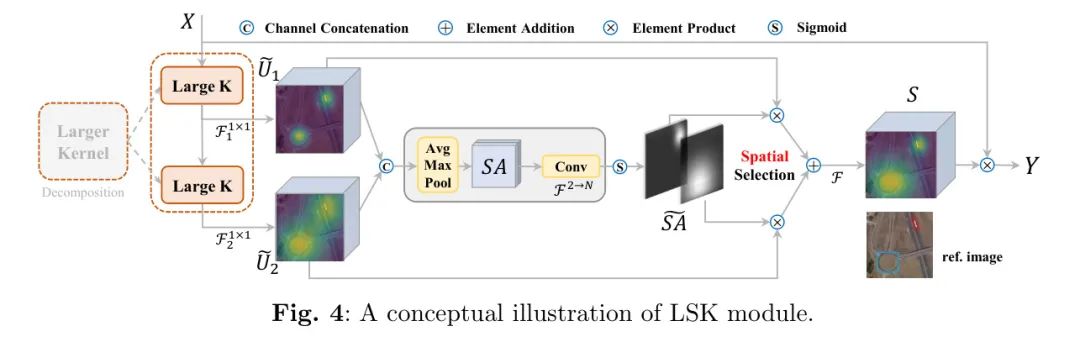

LK选择子块根据需要动态调整网络的感受野。核心LSK模块(图4)嵌入在LK选择子块中。它由一系列大核卷积和一个空间核选择机制组成,后文将详细阐述。FFN子块用于通道混合和特征细化,它包括一系列的全连接层、深度卷积、GELU [81]激活函数和第二个全连接层。

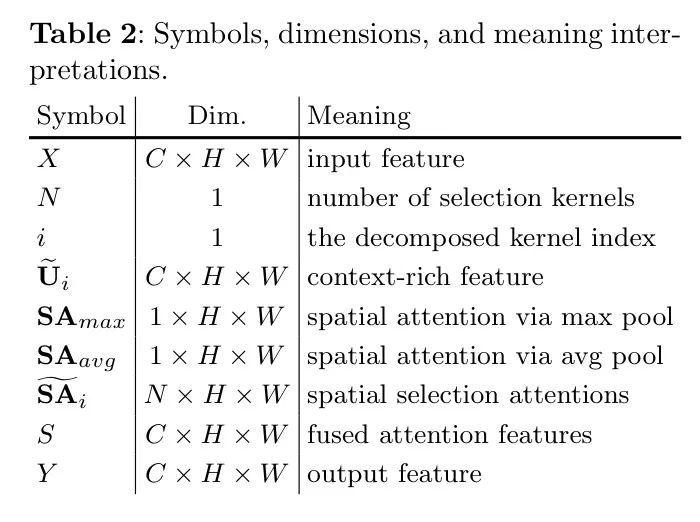

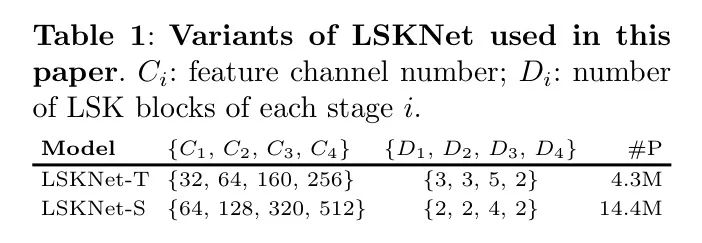

本文中使用的不同变体的LSKNet的详细配置列于表1中。此外,表2提供了重要符号的全面列表,它们的对应维度以及各自的含义。这些符号在图4以及后续章节中的方程式中被广泛引用。

Large Kernel Convolutions

根据第1节中的先前研究(2)建议,为了自适应选择,应该建模一系列的多重长距离上下文。因此,作者 Proposal 通过将大核卷积明确分解为一连串的深度卷积,这些深度卷积具有增大的核大小和逐渐增大的扩张率,来构建一个更大的核卷积。具体来说,对于第 个深度卷积,核大小 、扩张率 以及感受野 的定义如下:

$k_{i-1}\leq k_{i};\ d_{1}=1,\ d_{i-1}<d_{i}\leq rf_{i-1},="" \tag{1}$<="" p="">

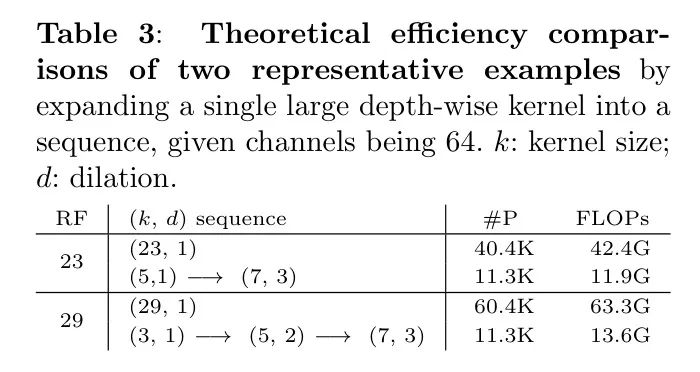

不断增大的核大小和膨胀率确保感受野能够快速扩大。作者设置了膨胀率的上限,以保证膨胀卷积不会在特征图之间引入间隙。例如,作者可以将一个大核分解为2或3个深度卷积,如表3所示,它们各自具有23和29的理论感受野。

提出的 设计有两个优势。首先,它明确地生成了具有多种大感受野的多个特征,这使得后续的核选择更为容易。其次,顺序分解比简单应用单个更大的 Kernel 更为高效。正如表3所示,在相同的结果理论感受野下,作者的分解与标准大卷积核相比大大减少了参数数量。为了从不同范围的输入 获得富含上下文信息的特征,应用了一系列具有不同感受野的分解的深度卷积。

其中 是带有核 和膨胀系数 的深度可分离卷积。假设有 个分解的核,每一个都会进一步通过一个 1 1 卷积层 进行处理:

允许每个空间特征向量进行通道混合。然后,提出了一种选择机制,根据获得的多尺度特征动态地为各种目标选择 Kernel ,下一部分将进行介绍。

Spatial Kernel Selection

为了增强网络关注最相关空间上下文区域以检测目标的能力,作者使用了一种空间选择机制,以在不同尺度上从大卷积核中空间地选择特征图。首先,作者将来自不同感受野范围的不同卷积核获取的特征进行拼接:

然后通过应用基于通道的平均池化和最大池化(分别表示为 和 )到 来高效提取空间关系:

其中 和 分别是平均池化和最大池化的空间特征描述符。为了允许不同空间描述符之间的信息交互,作者连接了空间池化特征,并使用卷积层 将(具有2个通道的)池化特征变换为 个空间注意力图:

对于每一个空间注意力图 ,应用一个sigmoid激活函数来获得每个分解的大核的个体空间选择 Mask 。

其中 表示sigmoid函数。来自一系列分解的大核的特征图通过它们对应的空间选择 Mask 加权后,再由一个卷积层 进行融合,以获得注意力特征 :

LSK模块的最终输出是输入特征 与 的逐元素乘积,类似于[64, 65, 66]中的描述:

图4展示了LSK模块的详细概念图,其中作者直观地演示了大型选择核如何通过自适应地收集不同物体对应的大接收场来工作。

4 Experiments

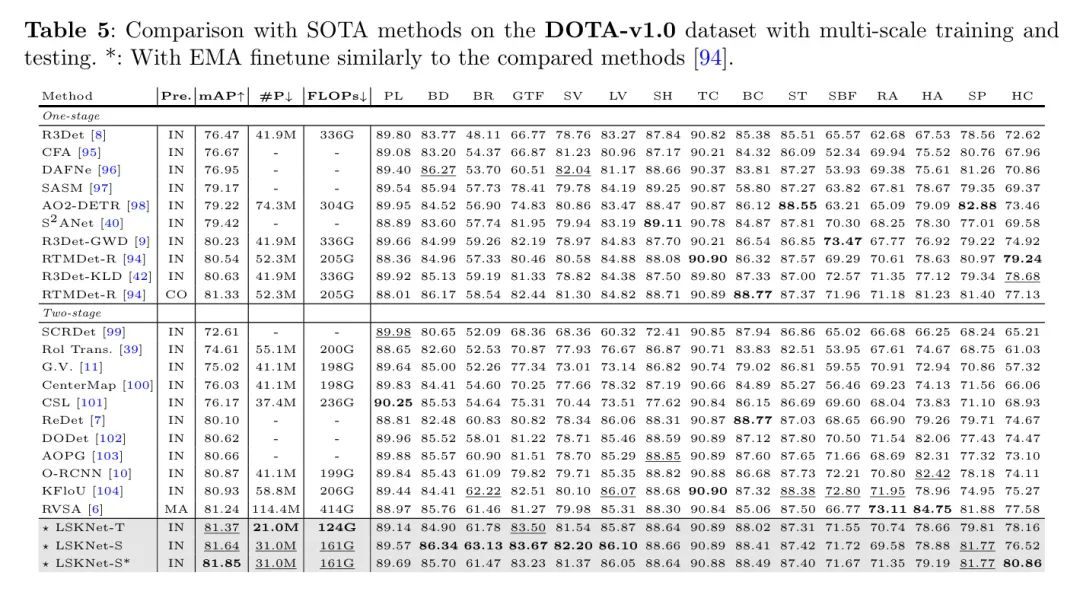

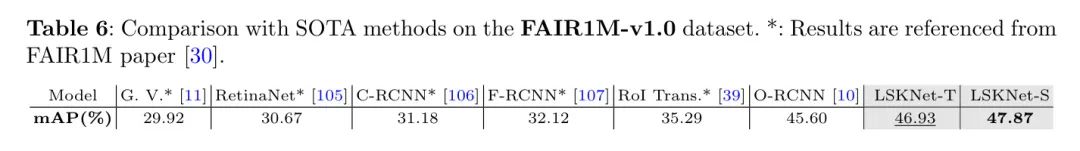

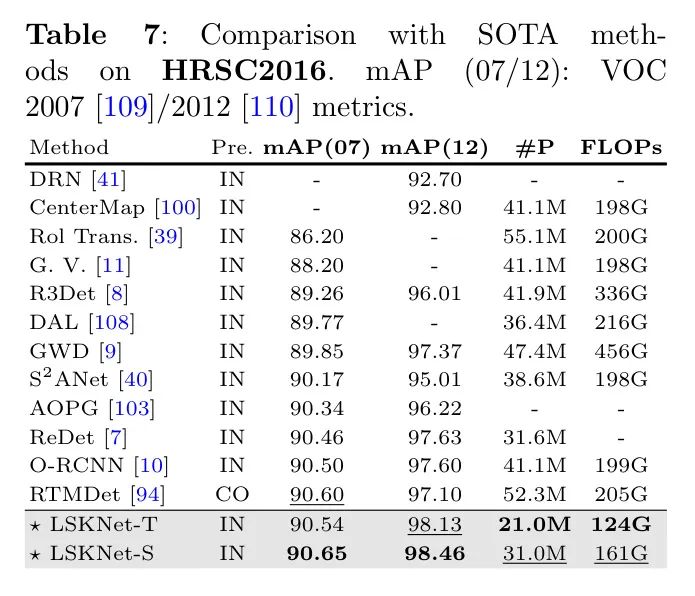

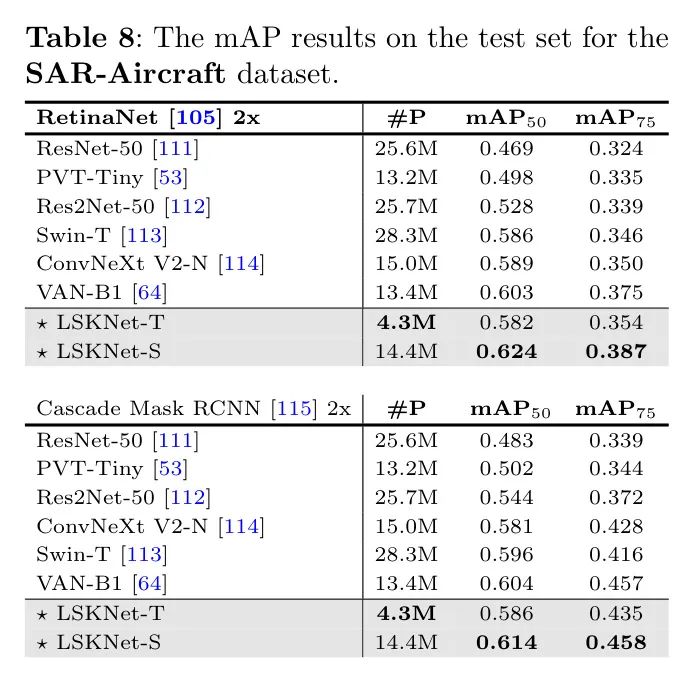

在本节中,作者报告了所提出模型在遥感场景分类、目标检测和语义分割上共计11个数据集的实验性能。在主要结果中,为了追求更高准确度,作者在Imagenet-1K [93] 上采用了300周期的 Backbone 网络预训练策略,类似于 [8, 10, 40] 的做法,除了场景分类,作者在millionAID [35] 数据集上对模型进行300周期的预训练。在消融研究中,为了实验效率,作者改为在Imagenet-1K 上采用100周期的 Backbone 网络预训练策略。最佳得分用粗体表示,次佳得分则用下划线标出。关于实验实施细节(例如训练计划和数据预处理)以及结果可视化的更多内容,可在补充材料中找到。

Remote Sensing Classification

4.1.1 Classification Datasets

遥感分类研究的主流[1, 5, 90, 92]在三个标准场景识别数据集上进行实验,包括加州大学默塞德土地使用(UCM)[20]数据集,航空图像数据集(AID)[21],以及由西北工业大学收集的图像场景分类(NWPU)[22]。

UCM是一个相对较小的数据集,它仅包含2,100张图像和21个类别,每个类别有100张图像。所有图像的尺寸均为256 × 256。

AID包含10,000张属于30个类别的图像,所有图像的尺寸均为600 600。

NWPU是一个相对较大的数据集,包含31,500张图像和45个类别,每个类别有700张图像。所有图像的尺寸为256 × 256。

遵循遥感分类工作主流[1, 5, 90, 92],作者在五个标准基准上进行实验,即UCM-82、AID-28、AID-55、NWPU-19和NWPU-28。

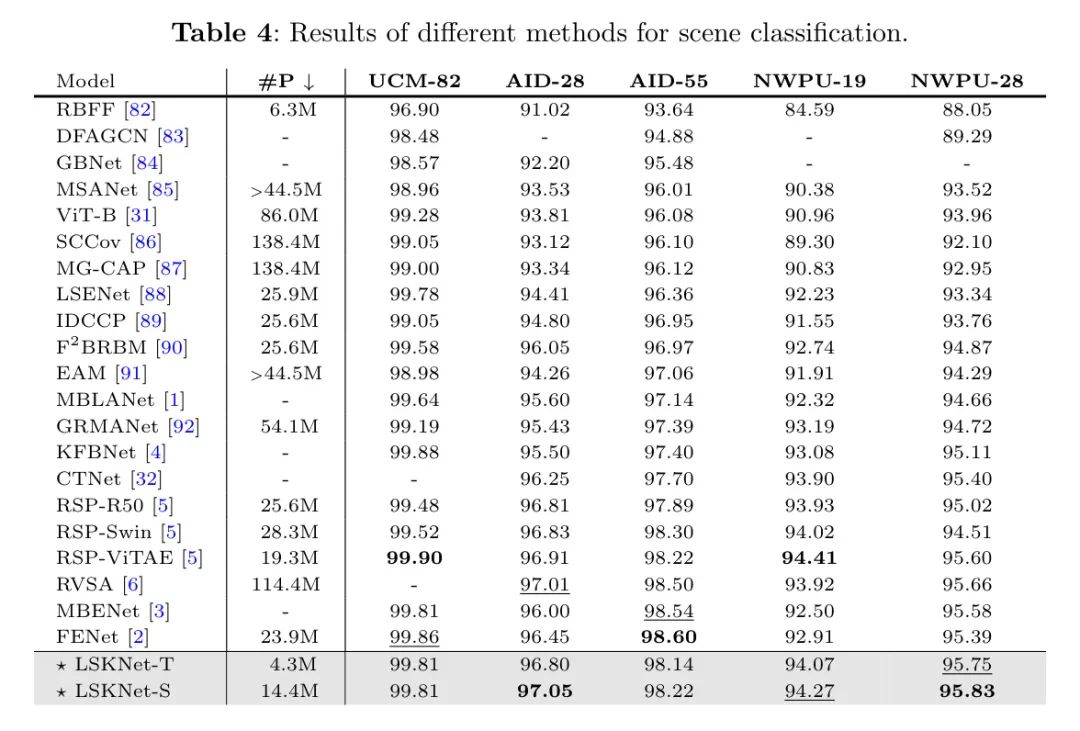

Classification Results

比较方法的分类结果在表4中给出。作者将作者提出的LSKNet与另外21种最先进的遥感场景分类方法进行了比较。在没有像MBENet [3]和FENet [2]中的特征集成等任何技巧的情况下,作者的简单轻量级模型LSKNet-T和LSKNet-S在多个数据集上提供了具有竞争力的性能。这些结果显示出了有希望的性能,展示了它们在多种不同场景下进行准确场景分类的有效性,以及作为特征提取 Backbone 的潜力。

Oriented Object Detection and SAR Object Detection

Object Detection Datasets

为了评估作者提出的模型在遥感检测任务中的适用性,作者在4个要求高的数据集上进行了实验。这些数据集包括3个已确立的面向目标的检测数据集:HRSC2016 [29],DOTA-v1.0 [28],以及FAIR1M-v1.0 [30],以及一个高度复杂且具有挑战性的合成孔径雷达(SAR)数据集,SAR-Aircraft [23]。

DOTA-v1.0 [28] 由2,806幅遥感图像组成。它包含了15个类别的188,282个实例:飞机(PL),棒球场(BD),桥梁(BR),跑道(GTF),小型车辆(SV),大型车辆(LV),船(SH),网球场(TC),篮球场(BC),储罐(ST),足球场(SBF),环形交叉路口(RA),港口(HA),游泳池(SP)和直升机(HC)。

HRSC2016 [29] 是一个高分辨率的遥感数据集,它被收集用于船舶检测。该数据集包括1,061张含有2,976个船舶实例的图像。

FAIR1M-v1.0 [30] 是最近发布的遥感数据集,包含 15,266 张高分辨率图像以及超过 100 万个实例。它包含 5 个类别和 37 个子类别目标。

SAR-Aircraft数据集[23]是一个最近发布的专为SAR模态目标检测收集的遥感数据集。与上述3个RGB模态的数据集不同,SAR数据集为灰度图像。它包括7个不同的类别,分别为A220、A320/321、A330、ARJ21、Boeing737、Boeing787和其他。该数据集由一个训练集组成。

3,489张图像以及一个含有879张图像的测试集,总计16,463个飞机实例。

Remoete Sensing Semantic Segmentaion

4.3.1 Segmentaion Dataset

遵循主流的分割研究[12, 46],作者通过在四个标准数据集上进行评估来测试作者提出的模型在遥感分割中的有效性:Potsdam [24],Vaihingen [25],LoveDA [26] 和 UAVid [27] 数据集。

波茨坦[24]是一个高分辨率语义分割数据集,包含38张高分辨率图像。它由6种类别的语义组成:不透水表面、建筑物、低矮植被、树木、汽车,以及一个背景类别,即杂物。

Vaihingen [25] 也是一个具有精细空间分辨率的语义分割数据集,它由33幅高分辨率图像组成。它与Potsdam有相同的语义类别。

LoveDA [26] 是一个多尺度、复杂的遥感语义分割数据集,包含5,987张1024×1024像素的图像。在这些图像中,2522张用于训练,1669张用于验证,1796张用于在线测试。该数据集包括7种类别的语义:建筑物、道路、水体、荒地、森林、农业和背景(Back.G.).

UAVid [27] 是一个高分辨率且复杂的无人飞行器(UAV)语义分割数据集。它包含200张训练图像,70张验证图像以及150张在线测试图像。该数据集由8个不同类别组成:杂乱物体、建筑物、道路、树木、植被、移动车辆(Mo.Car)、静止车辆(St.Car)和人。

4.3.2 Segmentation Results

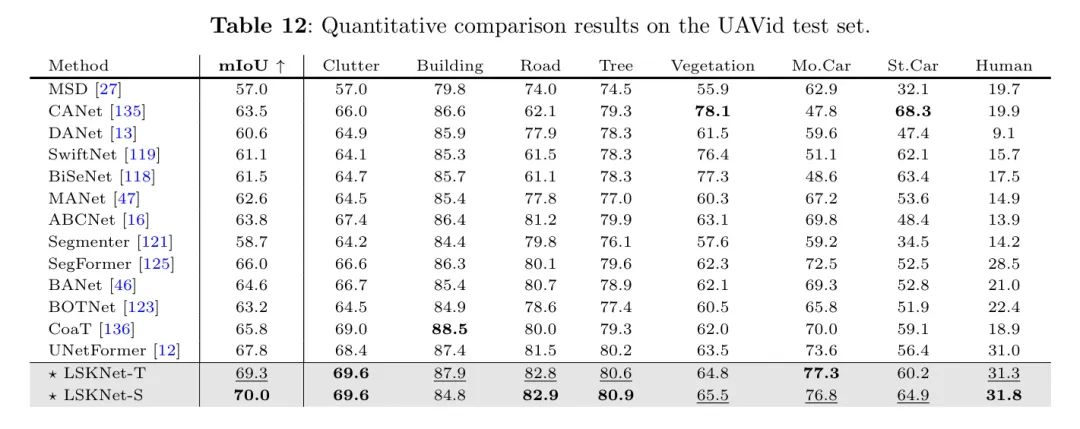

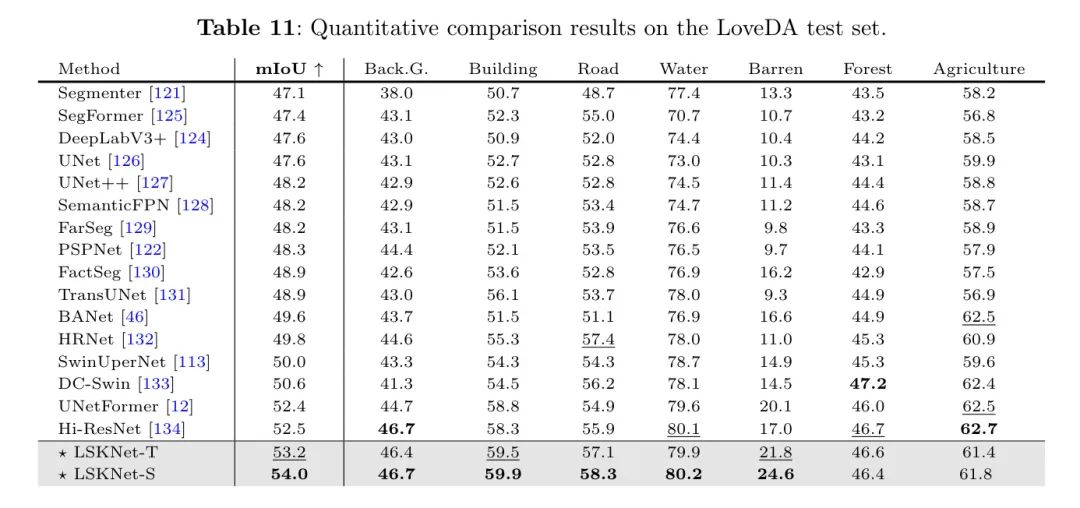

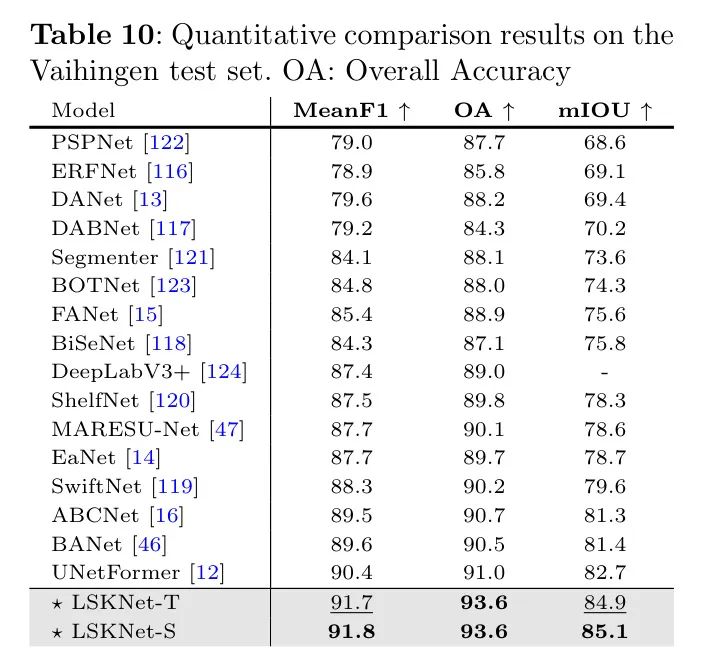

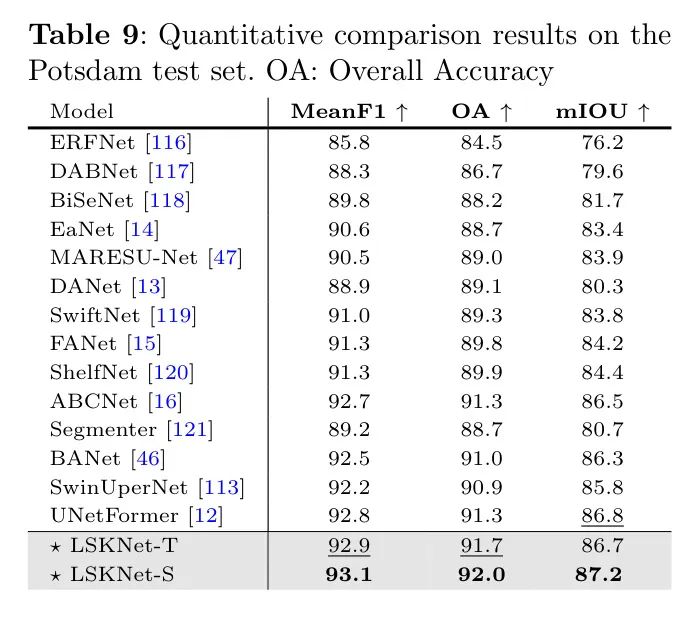

在分割实验中,由于LSKNet在性能上的优势和开源可用性,默认在UnetFormer [12]框架内构建。作者对所提出的模型LSKNet-T和LSKNet-S与在上述四个数据集上最近提出的多项高性能模型进行了全面的比较。具体来说,在Potsdam数据集上(表9),作者将模型与14种模型进行了比较;在Vaihingen数据集上(表10),与16种模型进行了比较;在LoveDA数据集上(表11),与13种模型进行了比较;以及在UAVid数据集上(表12),与16种模型进行了比较。值得注意的是,作者的LSKNet-T和LSKNet-S模型表现出色,在所有数据集上都超过了其他所有最先进的方法。

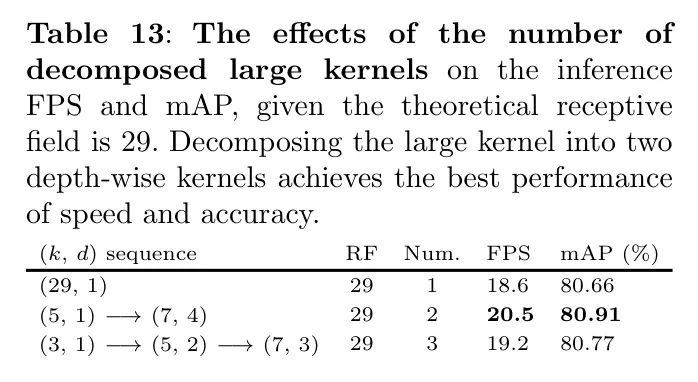

被认为是一项实际且具有挑战性的任务,DOTA-v1.0数据集提供了多样化和复杂的目标和场景以供评估。其次,众多模型的可用性使得可以进行全面比较,从而能够彻底评估作者提出方法的有效性。在消融研究中,作者采用了100轮迭代的主干网络预训练计划以提高实验效率(表13,14,15,16,17)。

大型核分解。 确定要分解的核数量对于LSK模块是一个关键的选择。作者遵循方程式(1)来配置分解后的核。当理论感受野固定在29时,关于大型核分解数量消融研究的结果显示在表13中。这表明将大型核分解为两个深度方向大型核可以在速度和准确性之间达到良好的平衡,同时在FPS(每秒帧数)和mAP(平均精度)方面都实现了最佳性能。

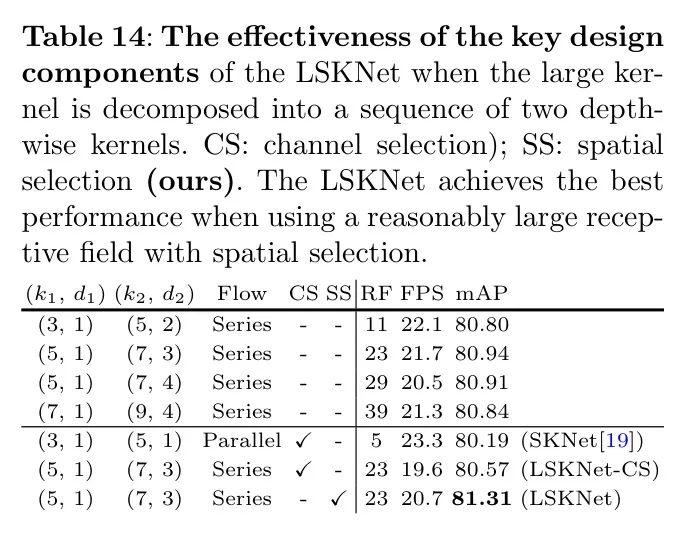

核感受野大小。 根据作者在表13中展示的评估,作者发现将大核分解为两个串行深度方向核是最佳选择。此外,表14显示,过小或过大的感受野可能会阻碍LSKNet的性能,并确定大约23的感受野尺寸最为有效。

与SKNet及不同注意力选择类型的比较。 SKNet与LSKNet之间存在两个主要区别。首先,所提出的选择机制依赖于通过分解的一系列大核的显式特征流,这与大多数现有基于注意力的方法所采用的方法有所不同。相比之下,SKNet采用并行分解。其次,LSKNet在空间维度上自适应地聚合大核的信息,而不是SKNet或LSKNet-CS中使用的通道维度。这种设计对于遥感任务来说更为直观和有效,因为通道选择无法捕捉到图像空间中不同目标的空间变异性。作者在表14的实验也表明,在检测任务中,空间信息扮演着更关键的角色。在补充材料中,作者全面比较了SKNet、LSKNet和LSKNet-CS(通道选择版本)的模块架构概念。

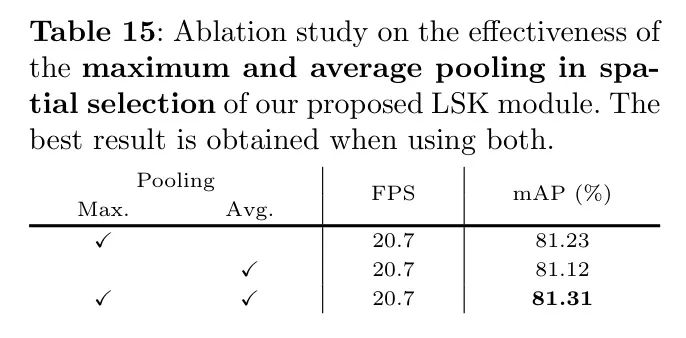

空间选择中的池化层。 作者进行了实验以确定空间选择的最优池化层,结果如表15所示。结果显示,在作者的LSK模块的空间选择组件中使用最大池化和平均池化可以提供最佳性能,同时不牺牲推理速度。

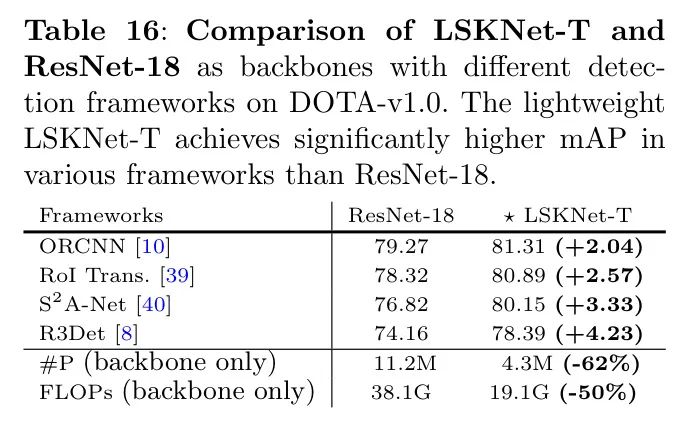

不同检测框架下LSKNet Backbone 网络的性能。 为了验证作者提出的LSKNet Backbone 网络的通用性和有效性,作者在各种遥感检测框架下评估了其性能,包括两阶段框架O-RCNN [10] 和 RoI Transformer [39],以及一阶段框架S A-Net [40] 和 R3Det [8]。表16的结果显示,作者提出的LSKNet-T Backbone 网络相比于ResNet-18显著提升了检测性能,同时只使用了38%的参数和减少了50%的FLOPs。这些发现强调了所提出LSKNet Backbone 网络轻量级但强大的通用性特点。

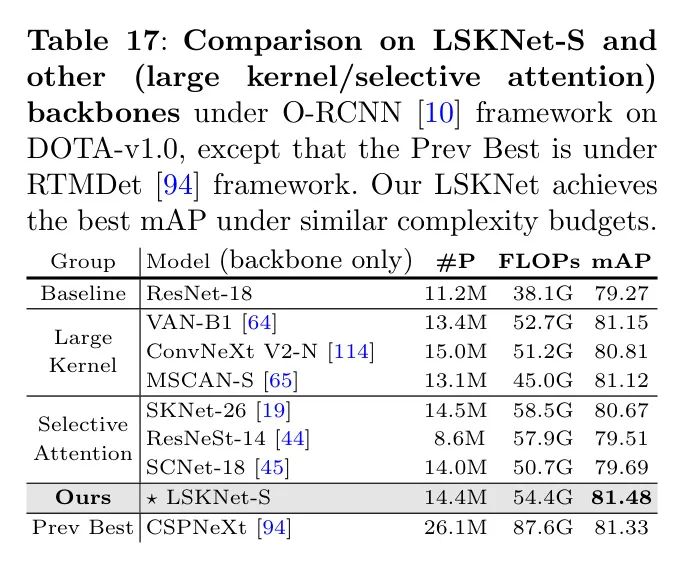

与其他大核/选择注意力 Backbone 网的比较。 作者还将LSKNet与6种流行的高性能 Backbone 模型进行了比较,这些模型具有大核或选择注意力。如表17所示,在相似的模型尺寸和复杂度预算下,作者的LSKNet在DOTA-v1.0数据集上超越了所有其他模型。

5 Analysis

作者针对目标检测任务进行专门分析,因为实例级信息在理解模型整体行为中的重要性。

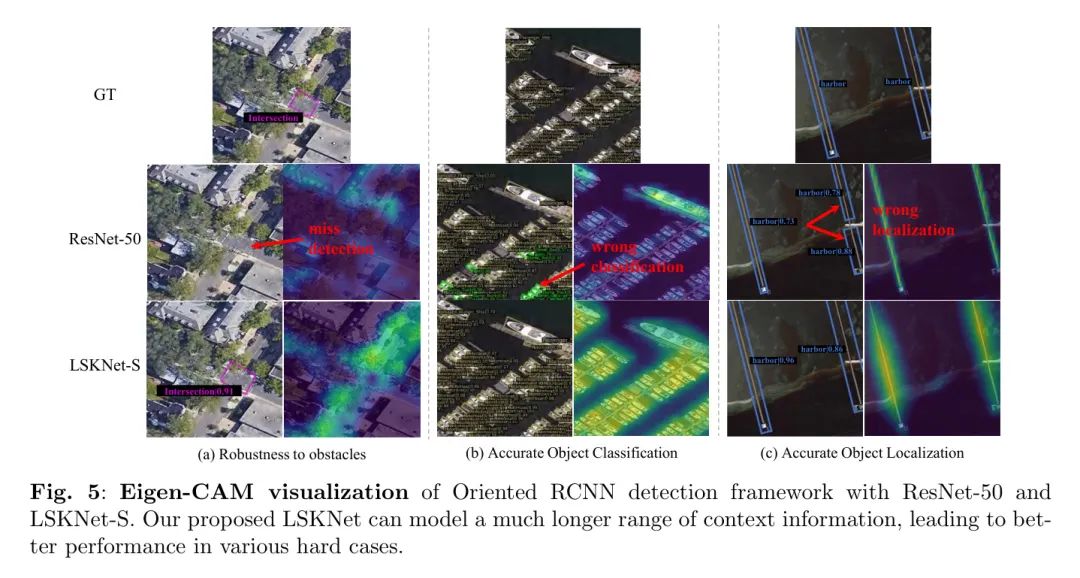

检测结果可视化。 检测结果的可视化示例以及EigenCAM [137] 展示在图5中。LSKNet可以捕获到与检测目标相关的更多上下文信息,这导致了在多种困难情况下性能更好,这证明了作者之前的假设 1).

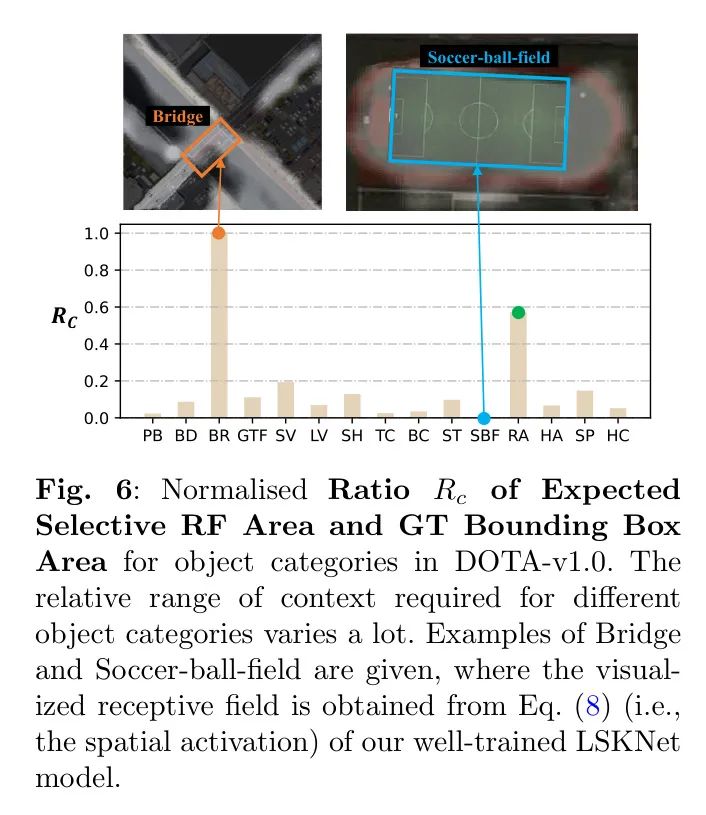

不同物体的相对上下文范围。 为了研究每个物体类别的感受野的相对范围,作者定义了 为类别 的_期望选择性感受野面积与真实边界框面积的比例_:

其中 是仅包含目标类别 的图像数量。 是输入图像 在所有 LSK 块中的空间选择激活的总和,其中 是 LSKNet 中的块数量, 是 LSK 模块中分解的大核的数量。 是所有 标注的有向目标边界框(GT)的总像素面积。作者在图6 中绘制了归一化的 ,它表示不同目标类别所需上下文的相对范围,以便更清晰地查看。

结果表明,桥梁类别相较于其他类别需要更多的附加上下文信息,这主要是由于其与道路在特征上的相似性以及确定其是否被水域包围时对上下文线索的必要性。相反,诸如足球场这样的法庭类别,由于其独特的纹理属性,特别是法庭边界线,所需上下文信息较少。这与作者的知识相符合,并进一步支持了_先前的2)_观点,即不同目标类别所需的上下文信息相对范围存在很大差异。

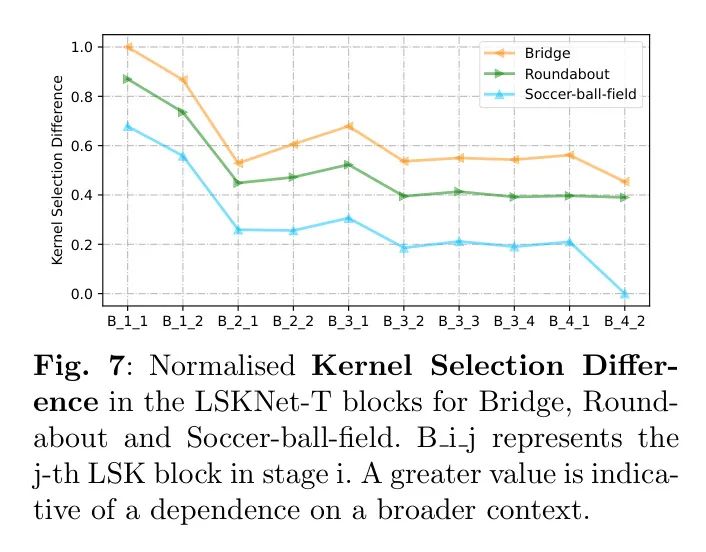

核选择行为。 作者进一步研究了LSKNet中的核选择行为。对于目标类别 ,LSKNet-T块的_Kernel Selection Difference_ (即,较大核选择 - 较小核选择)定义为:

作者展示了在所有图像中,三个典型类别:桥梁、环岛和足球场的标准化 ,以及每个LSKNet-T模块在图7中的情况。如预期的那样,所有模块中较大核在桥梁类中的参与度高于环岛类,而环岛类又高于足球场类。这与常识相符,因为足球场实际上并不需要大量的上下文信息,因为它自身的纹理特征已经足够独特且具有区分性。

作者还惊讶地发现LSKNet在网络深度上另一种选择模式:LSKNet通常在其浅层使用较大的核,而在更高 Level 使用较小的核。这表明网络倾向于在低级层快速聚焦,从大的感受野中捕获信息,从而使高级语义能够包含足够多的感受野以进行更好的区分。

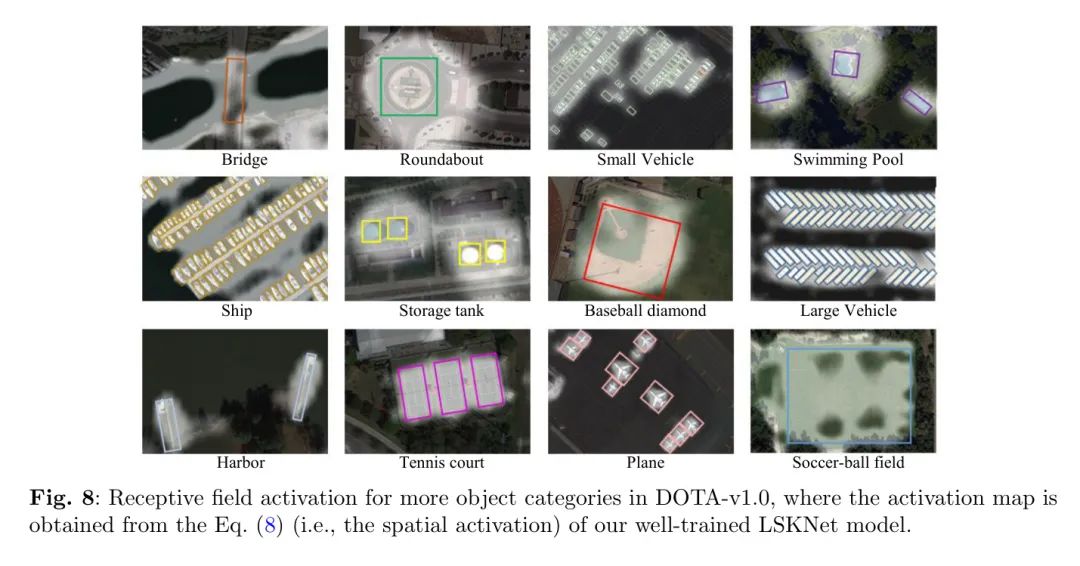

空间激活可视化。 在DOTA-v1.0中更多目标类别的空间激活图示例展示在图8中,其中激活图来自作者训练有素的LSKNet模型的方程(8)(即,空间激活)。目标类别根据图6所示的_预期选择性感受野面积与GT边界框面积的比例_,从左上角到右下角依次递减排列。空间激活可视化结果也表明,模型的行为与作者所提出的两个先验和上述分析相一致,进而验证了所提出机制的有效性。

6 Conclusion

在本文中,作者提出了一种轻量级的大选择性核网络(LSKNet)作为处理遥感图像下游任务的新方法,如场景分类、目标检测和语义分割。LSKNet特别设计用来利用遥感图像的固有特性:需要更宽且可适应的上下文理解。通过适应大的空间感受野,LSKNet能有效捕捉并建模由遥感图像中不同目标类型展现出的多样上下文细微差别。广泛的实验证明了作者提出的轻量级模型在具有竞争力的遥感基准测试中取得了最先进的表现。本文进行的全面分析验证了作者提出的轻量级模型的有效性和重要性。

Acknowledgement

这项研究得到了中国国家自然科学青年科学基金(资助编号:62206134, 62176130, 62225604, 62301261)的支持,中央高校基本科研业务费(南开大学,编号:070-63233084, 070-63233089),以及天津市视觉计算与图像处理重点实验室的支持。计算资源由南开大学超级计算中心提供,并且得到了中国博士后科学基金(编号:2021M701727)的支持。

Data Availability Statement

Data publicly available in a repository:

ImageNet 数据集可以在 https://www.image-net.org/ 上获取。

UCM数据集可在以下链接获取:http://weegee.vision.ucmerced.edu/datasets/landuse.html。

AID数据集可在以下链接获取:https://captain-whu.github.io/AID/。

NWPU数据集可以在以下链接获取:https://www.tensorflow.org/datasets/catalog/resisc45。

百万AID数据集可在 https://captain-whu.github.io/DiRS/获取。

DOTA数据集可以在 https://captain-whu.github.io/DOTA/dataset.html获取。

FAIR1M-v1.0 数据集可以在以下链接获取:https://www.gaofen-challenge.com/benchmark。

SAR-Aircraft 数据集可以在以下链接获取:https://radars.ac.cn/web/data/getData?dataType=SARDataset_en。

波茨坦和瓦伊钦数据集可在以下链接获取:https://www.isprs.org/education/benchmarks/UrbanSemLab/default.aspx。

LoveDA数据集可以在以下链接获取:https://codalab.lism.upsaclay.fr/competitions/421。

UAVid数据集可以在https://uavid.nl/获取。

参考

[1].LSKNet: A Foundation Lightweight Backbone for Remote Sensing.

点击上方卡片,关注「AI视界引擎」公众号