谷歌最新AI视频曝光:720p高清+长镜头,网友:对短视频行业冲击太大

梦晨 Pine 发自 凹非寺

量子位 | 公众号 QbitAI

零基础python入门教程:python666.cn

大家好,欢迎来到 Crossin的编程教室 !

内容生成AI进入视频时代!

Meta发布「用嘴做视频」的 Make-A-Video 仅一周,谷歌CEO劈柴哥接连派出两名选手上场竞争。

第一位Imagen Video与Meta的Make-A-Video相比突出一个高清,能生成1280*768分辨率、每秒24帧的视频片段。

另一位选手Phenaki,则能根据200个词左右的提示语生成2分钟以上的长镜头,讲述一个完整的故事。

网友看过后表示,这一切进展实在太快了。

也有网友认为,这种技术一旦成熟,会冲击短视频行业。

那么,两个AI具体有什么能力和特点,我们分别来看。

Imagen Video:理解艺术风格与3D结构

Imagen Video同样基于最近大火的扩散模型,直接继承自5月份的图像生成SOTA模型Imagen。

除了分辨率高以外,还展示出三种特别能力。

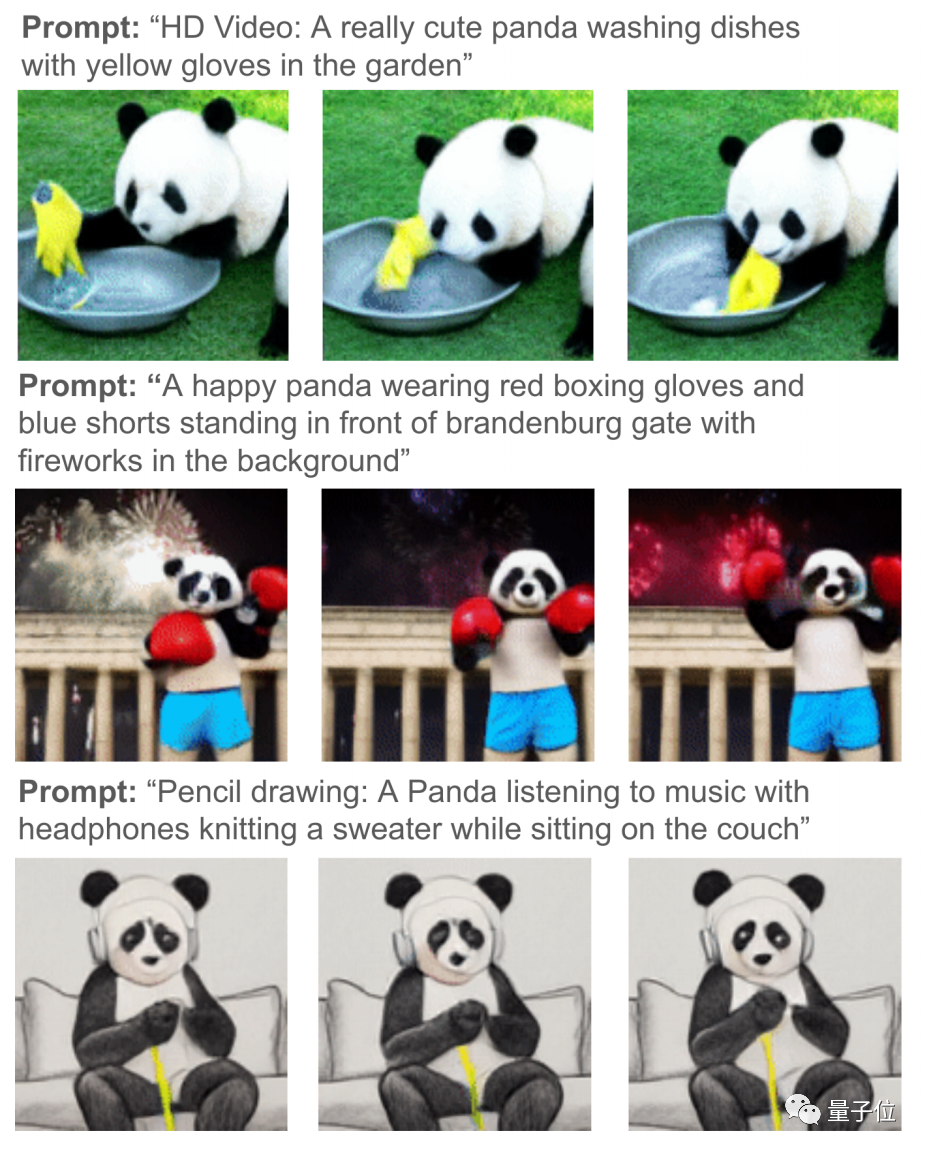

首先它能理解并生成不同艺术风格的作品,如“水彩画”或者“像素画”,或者直接“梵高风格”。

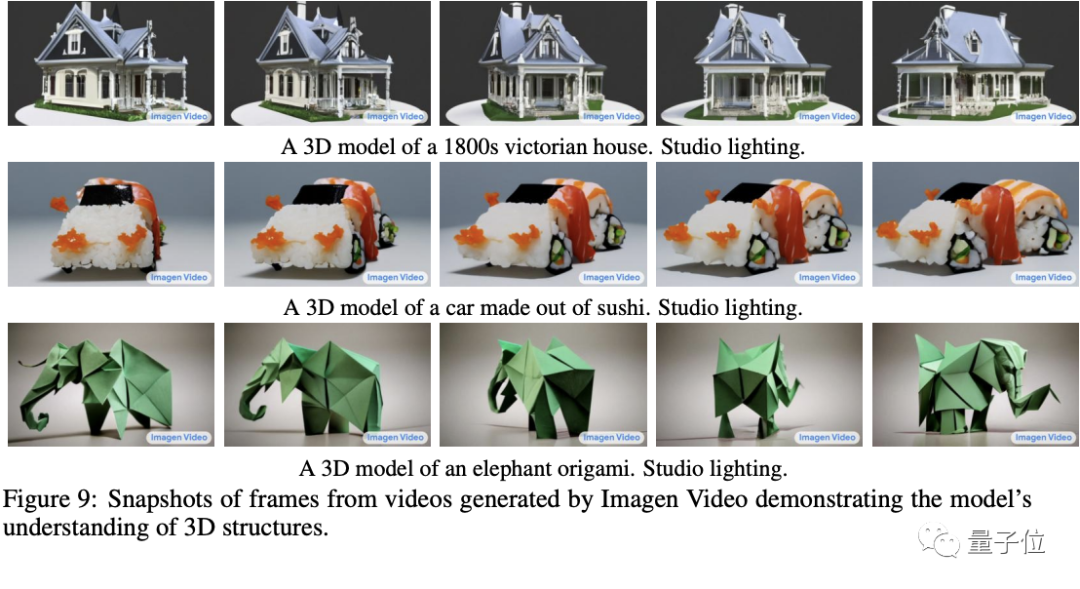

它还能理解物体的3D结构,在旋转展示中不会变形。

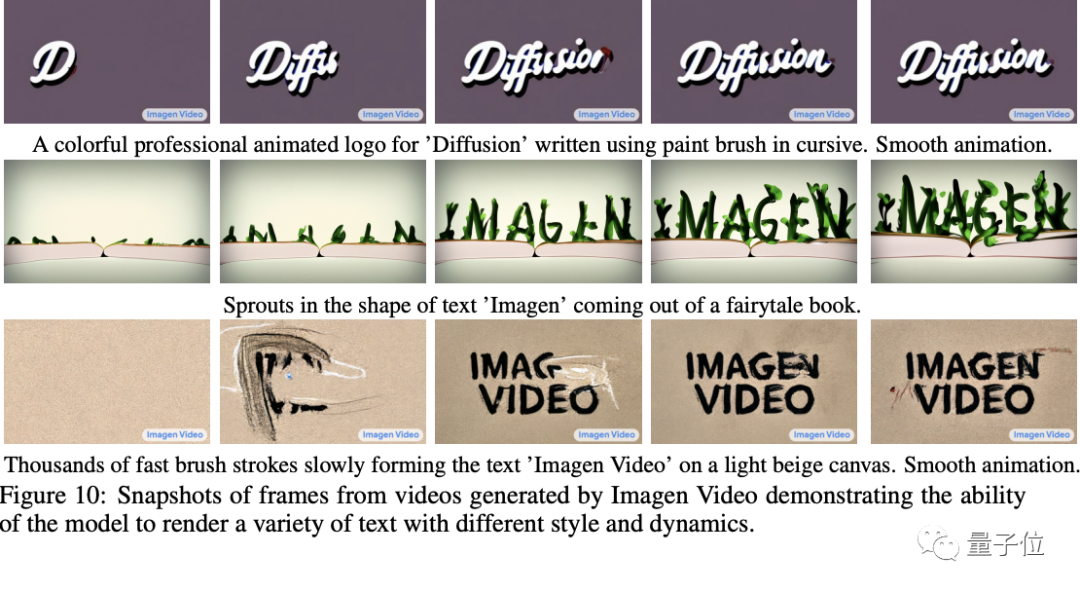

最后它还继承了Imagen准确描绘文字的能力,在此基础上仅靠简单描述产生各种创意动画,

这效果,直接当成一个视频的片头不过分吧?

除了应用效果出色以外,研究人员表示其中用到的一些优化技巧不光对视频生成有效,可以泛化至一般扩散模型。

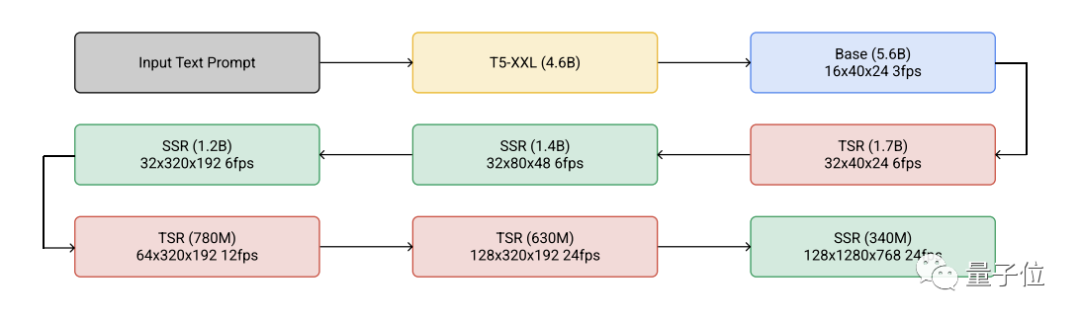

具体来说,Imagen Video是一系列模型的集合。

语言模型部分是谷歌自家的T5-XXL,训练好后冻结住文本编码器部分。

与负责从文本特征映射到图像特征的CLIP相比,有一个关键不同:

语言模型只负责编码文本特征,把文本到图像转换的工作丢给了后面的视频扩散模型。

基础模型,在生成图像的基础上以自回归方式不断预测下一帧,首先生成一个48*24、每秒3帧的视频。

接下来,一系列空间超分辨率(Spatial Super-Resolution)与时间超分辨率(Temporal Super-Resolution)模型接连对视频做扩展处理。

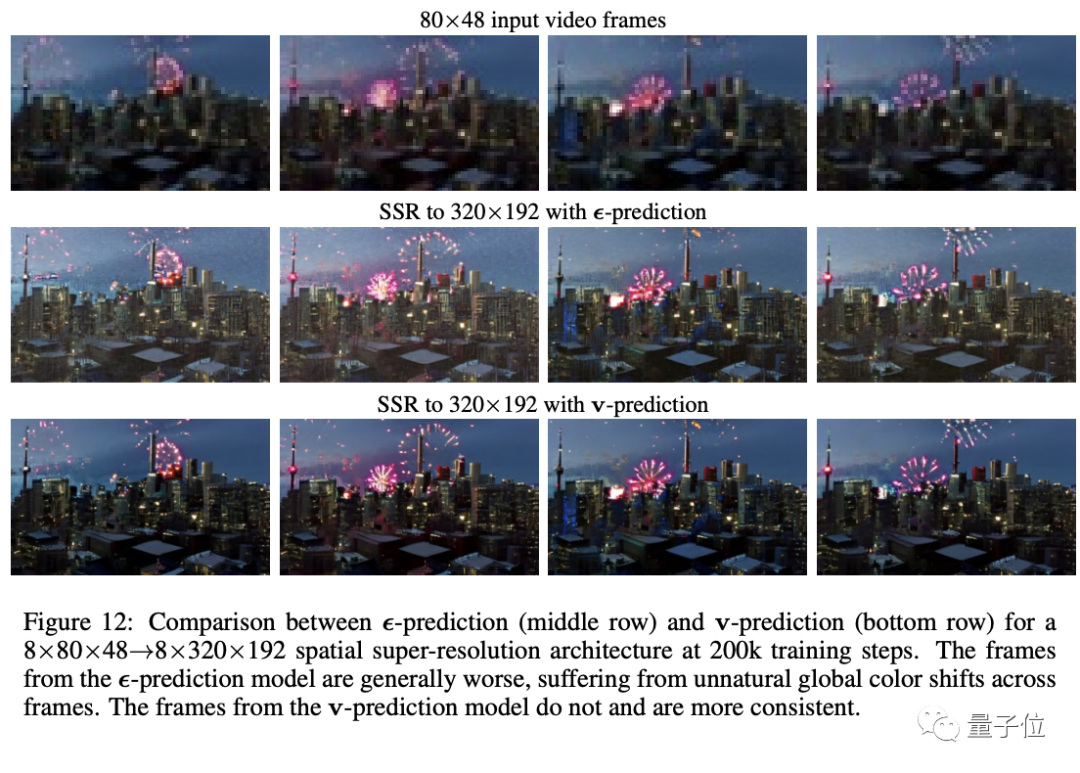

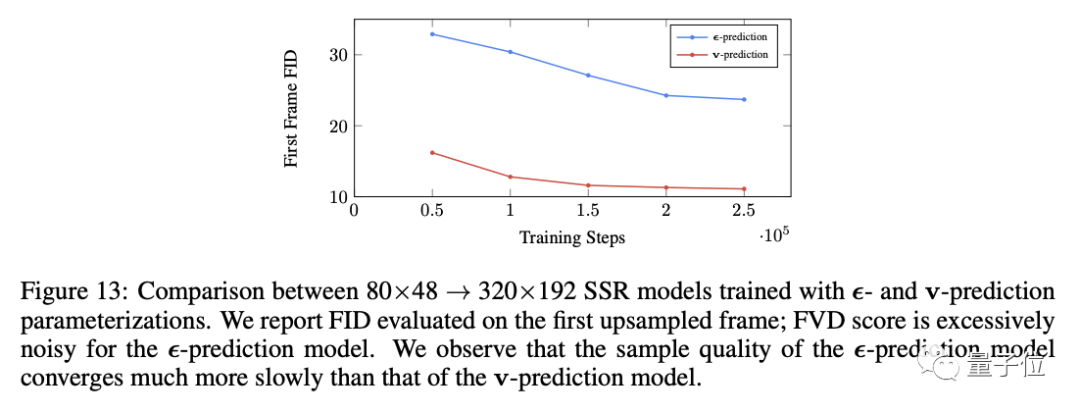

所有7种扩散模型都使用了v-prediction parameterization方法,与传统方法相比在视频场景中可以避免颜色偏移。

这种方法扩展到一般扩散模型,还使样本质量指标的收敛速度更快。

此外还有渐进式蒸馏(Progressive Distillation),将每次迭代所需的采样步骤减半,大大节省显存消耗。

这些优化技巧加起来,终于使生成高清视频成为可能。

Phenaki:人人都能是“导演”

Phenaki的论文投了ICLR 2023会议,在一周前Meta发布Make-a-video的时候还是匿名双盲评审状态。

如今信息公开,原来研究团队同样来自谷歌。

在公开的信息中,Phenaki展示了它交互生成视频的能力,可以任意切换视频的整体风格:高清视频/卡通,还能够切换任意场景。

还可以向Phenaki输入一个初始帧以及一个提示,便能生成一段视频。

这都还是开胃小菜,Phenaki真正的大招是:讲故事,它能够生成2分钟以上的长视频,通过输入长达200多个字符的系列提示来得到。

(那有了这个模型,岂不是人人都能当导演了?手动狗头)

从文本提示到视频,计算成本高、高质量文本视频数据数量有限以及视频长度可变一直以来都是此类模型发展的难题。

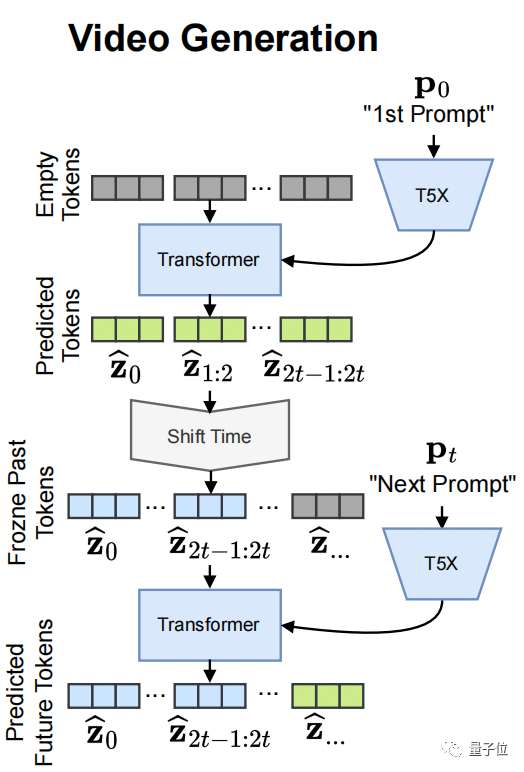

以往的大多数AI模型都是通过单一的提示来生成视频,但若要生成一个长时间并且连贯的视频这远远不够。

而Phenaki则能生成2分钟以上的视频,并且还具备故事情节,这主要归功于它能够根据一系列的提示来生成视频的能力。

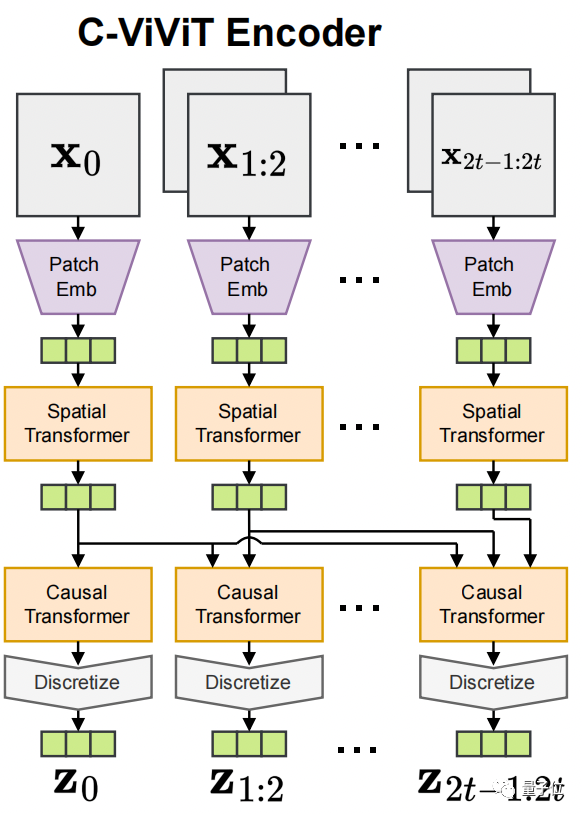

具体来说,研究人员引入了一个新的因果模型来学习表示视频:将视频视作图像的一个时间序列。

这个模型基于transformer,可以将视频分解成离散的小表示,而分解视频则是按照时间的因果顺序来进行的。

再讲通俗一点,就是通过空间transformer将单个提示进行编码,随后再用因果transformer将多个编码好的提示串联起来。

一个提示生成一段视频,这样一来,视频序列便可以沿着提示中描述的时间序列将整个“故事”串在一起。

因为将视频压缩为离散的图像序列,这样也大大减少了AI处理标记视频的数量,在一定程度上降低了模型的训练成本。

提到模型训练,和大型图像系统一样,Phenaki也主要使用文本-图像数据进行训练,此外,研究人员还用1.4秒,帧率8FPS的短视频文本对Phenaki进行训练。

仅仅通过对大量图像文本对以及少量视频文本例子进行联合训练,便能达到突破视频数据集的效果。

Imagen Video和Phenaki,谷歌接连放出大招,从文本到视频的AI发展势头迅猛。

值得一提的是,Imagen Video一作表示,两个团队将合作进行下一步研究。

嗯,有的网友已经等不及了。

One More Thing

出于安全和伦理的考虑,谷歌暂时不会发布两个视频生成模型的代码或Demo。

不过既然发了论文,出现开源复刻版本也只是时间问题。

毕竟当初Imagen论文出来没几个月,GitHub上就出现了Pytorch版本。

另外Stable Diffusion背后的StabilityAI创始人兼CEO也说过,将发布比Meta的Make-A-Video更好的模型,而且是大家都能用上的那种。

当然,每次AI有了新进展后都会不可避免地碰到那个话题——AI会不会取代人类。

目前来说,一位影视行业的工作者表示还不到时候:

老实说,作为一个在电影行业工作了十年的人,这个话题令人沮丧。

在他看来,当前的视频生成AI在外行看起来已经足够惊艳,不过业内人士会认为AI还缺乏对每一个镜头的精细控制。

对于这个话题,StabilityAI新任首席信息官Daniel Jeffries此前撰文表示,AI最终会带来更多的工作岗位。

如相机的发明虽然取代了大部分肖像画家,但也创造了摄影师,还开辟了电影和电视这样的全新产业。

5年后再回看的话,反对AI就像现在反对Photoshop一样奇怪,AI只不过是另一个工具。

Jeffries称未来是环境人工智能(Ambient AI)的时代,各个行业、各个领域都会在人工智能的加持下进行发展。

不过现在我们需要的是一个更开放的人工智能环境,也就是说:开源!

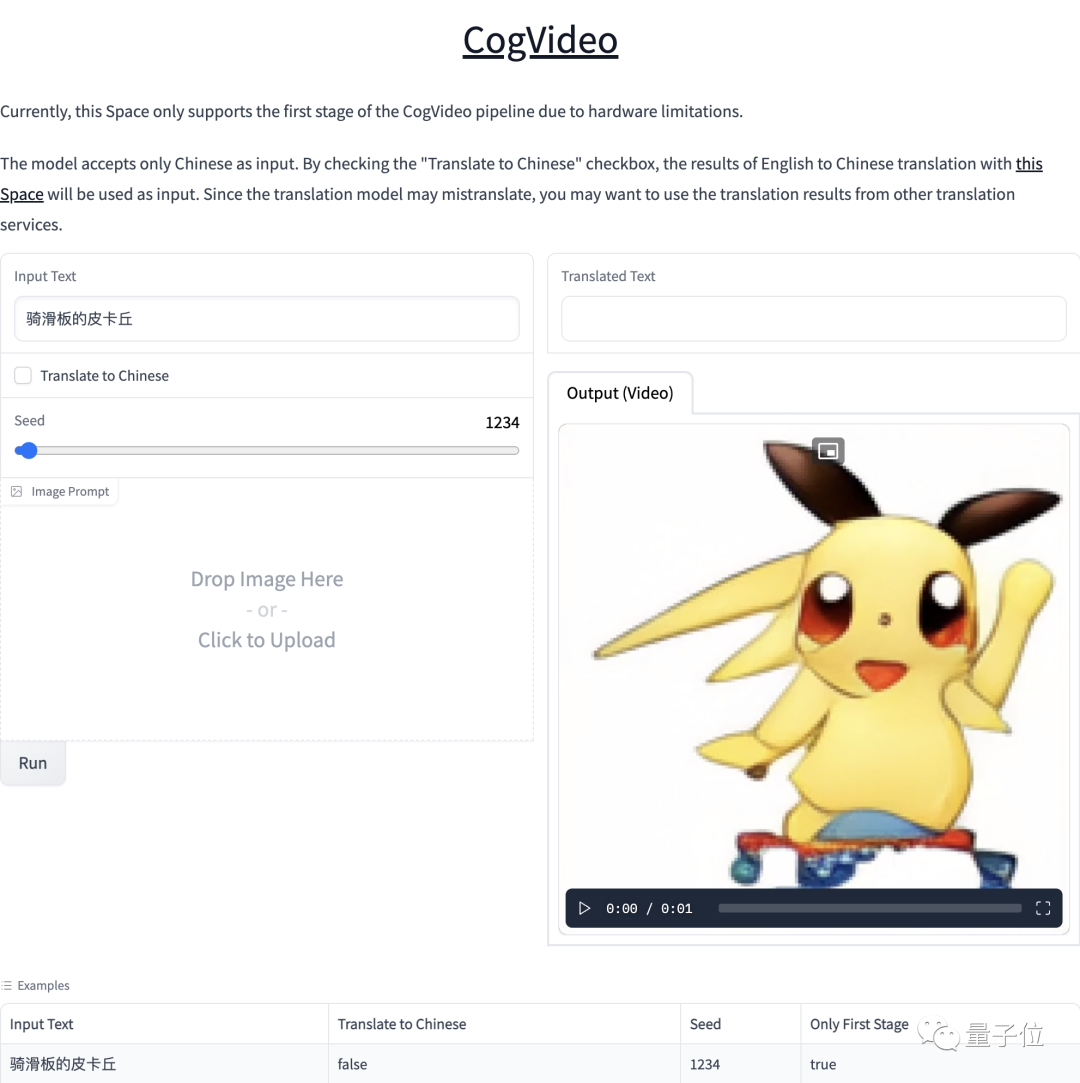

最后,如果你现在就想玩一下AI生成视频的话,可以先到HuggingFace上试试清华与智源实验室的Cogvideo。

Imagen:

https://imagen.research.google/video/

Phenaki:

https://phenaki.github.io

Cogvideo试玩:

https://huggingface.co/spaces/THUDM/CogVideo

参考链接:

[1]https://twitter.com/sundarpichai/status/1578162216335179778

[2]https://twitter.com/hojonathanho/status/1577713864812236817

[3]https://news.ycombinator.com/item?id=33098704

[4]https://danieljeffries.substack.com/p/the-turning-point-for-truly-open

作者:梦晨 Pine

_往期文章推荐_