pkuseg中文分词工具包

pkuseg-python:一个高准确度的中文分词工具包

pkuseg-python 简单易用,支持多领域分词,在不同领域的数据上都大幅提高了分词的准确率。

主要亮点

pkuseg 是由北京大学语言计算与机器学习研究组研制推出的一套全新的中文分词工具包。pkuseg 具有如下几个特点:

高分词准确率。相比于其他的分词工具包,我们的工具包在不同领域的数据上都大幅提高了分词的准确度。根据我们的测试结果,pkuseg 分别在示例数据集( MSRA 和 CTB8 )上降低了 79.33% 和 63.67% 的分词错误率。

多领域分词。我们训练了多种不同领域的分词模型。根据待分词的领域特点,用户可以自由地选择不同的模型。

支持用户自训练模型。支持用户使用全新的标注数据进行训练。

编译和安装

-

通过 pip 下载(自带模型文件)

pip install pkuseg

之后通过import pkuseg来引用 -

从 github 下载(需要下载模型文件,见预训练模型)

将pkuseg文件放到目录下,通过import pkuseg使用

模型需要下载或自己训练。

各类分词工具包的性能对比

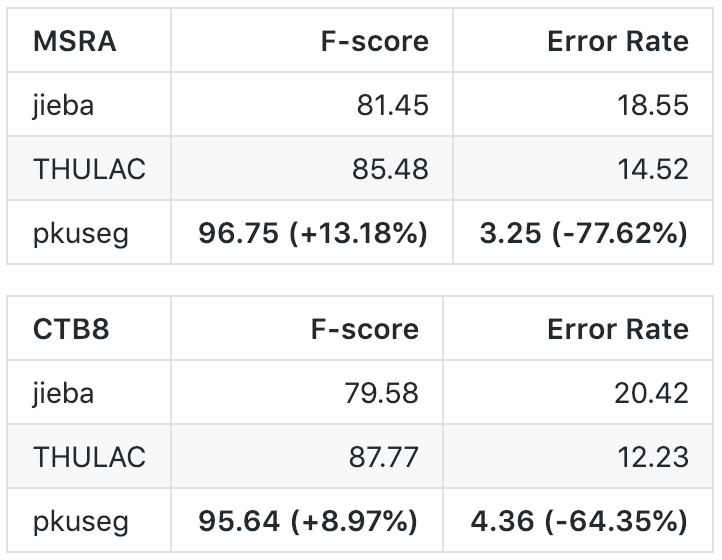

我们选择 THULAC、结巴分词等国内代表分词工具包与 pkuseg 做性能比较。我们选择 Linux 作为测试环境,在新闻数据 (MSRA) 和混合型文本 (CTB8) 数据上对不同工具包进行了准确率测试。我们使用了第二届国际汉语分词评测比赛提供的分词评价脚本。评测结果如下:

代码示例

示例1

代码示例1 使用默认模型及默认词典分词

import pkuseg

seg = pkuseg.pkuseg() #以默认配置加载模型

text = seg.cut('我爱北京天安门') #进行分词

print(text)

示例2

代码示例2 设置用户自定义词典

import pkuseg

lexicon = ['北京大学', '北京天安门'] #希望分词时用户词典中的词固定不分开

seg = pkuseg.pkuseg(user_dict=lexicon) #加载模型,给定用户词典

text = seg.cut('我爱北京天安门') #进行分词

print(text)

示例3

代码示例3

import pkuseg

seg = pkuseg.pkuseg(model_name='./ctb8') #假设用户已经下载好了ctb8的模型并放在了'./ctb8'目录下,通过设置model_name加载该模型

text = seg.cut('我爱北京天安门') #进行分词

print(text)

示例4

代码示例4

import pkuseg

pkuseg.test('input.txt', 'output.txt', nthread=20) #对input.txt的文件分词输出到output.txt中,使用默认模型和词典,开20个进程

示例5

代码示例5

import pkuseg

pkuseg.train('msr_training.utf8', 'msr_test_gold.utf8', './models', nthread=20) #训练文件为'msr_training.utf8',测试文件为'msr_test_gold.utf8',模型存到'./models'目录下,开20个进程训练模型

评论