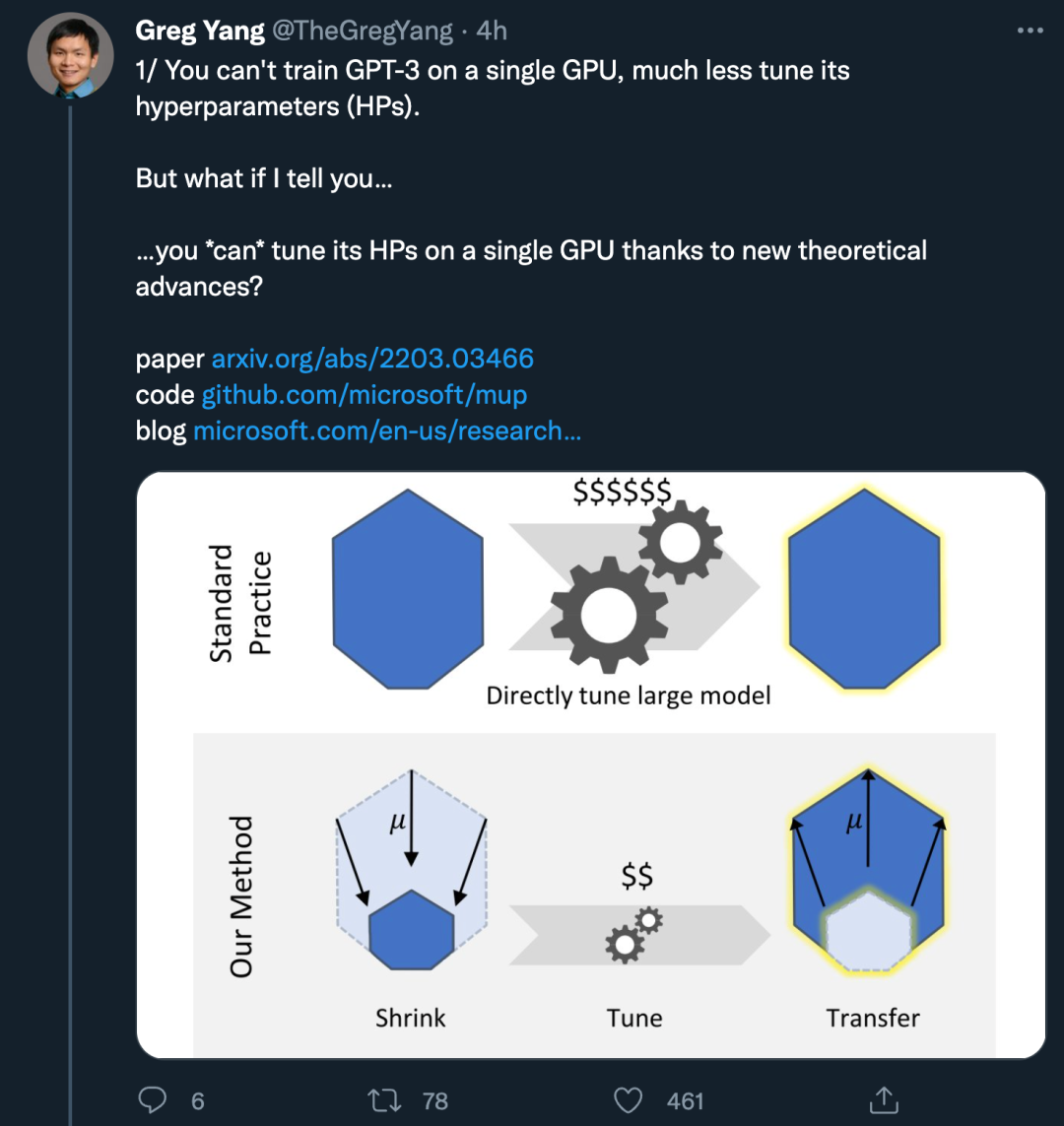

你还在纠结单个GPU怎么训练GPT-3吗?快来看看HP调优新范式吧!

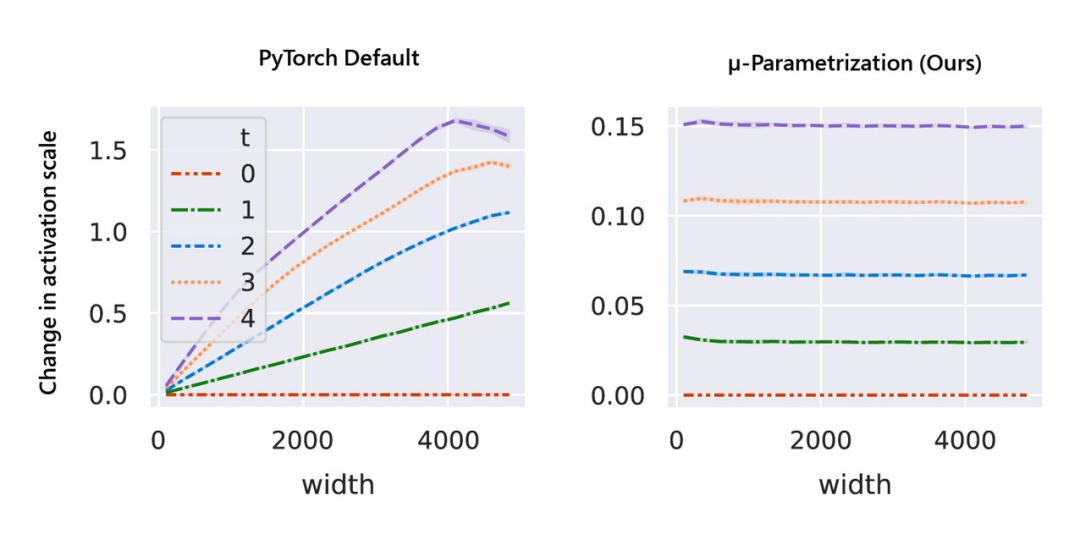

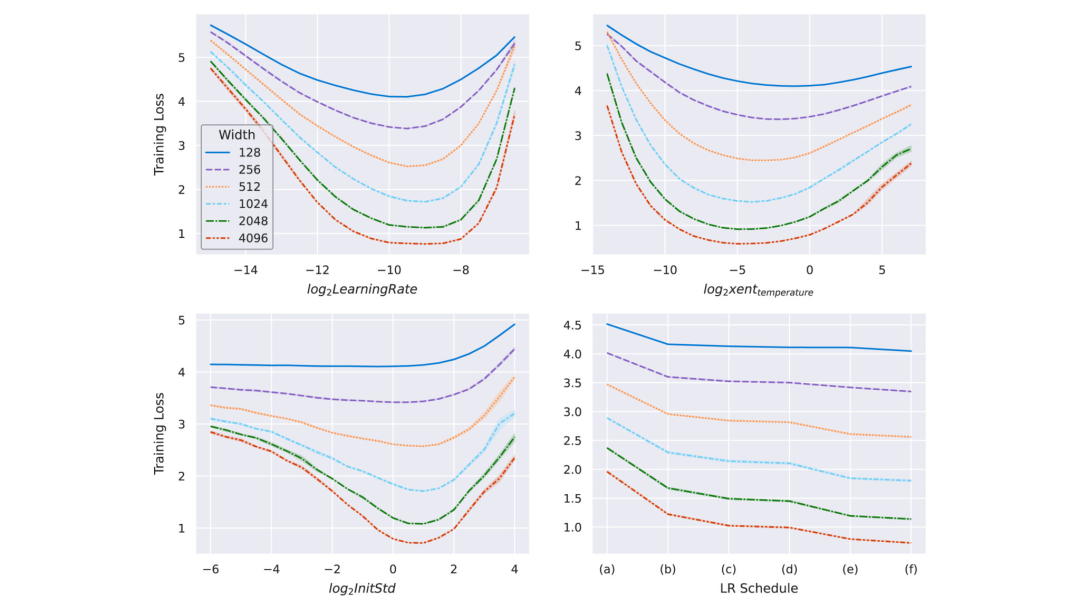

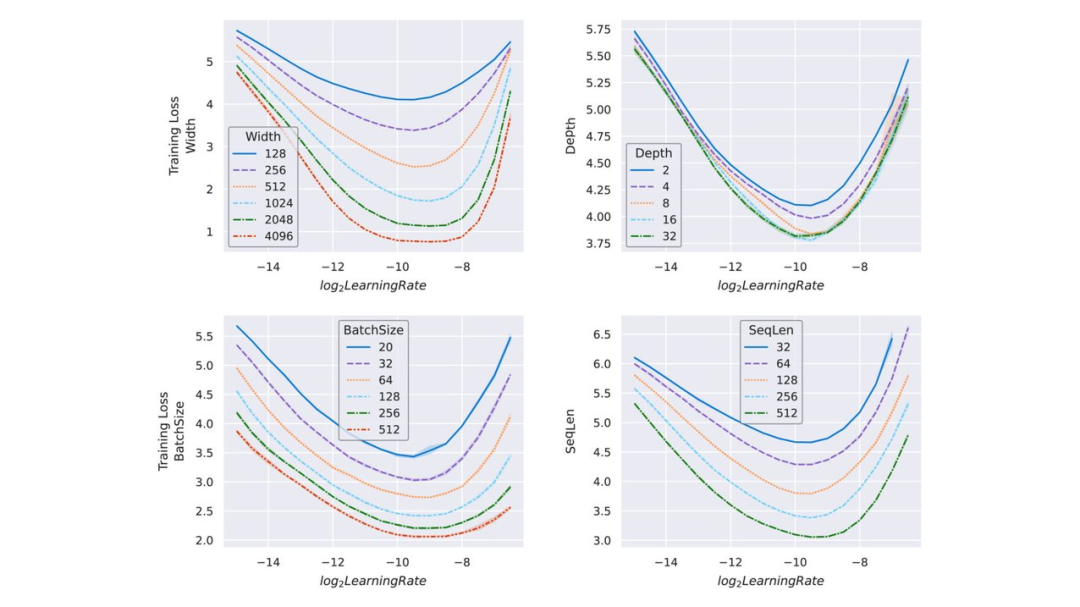

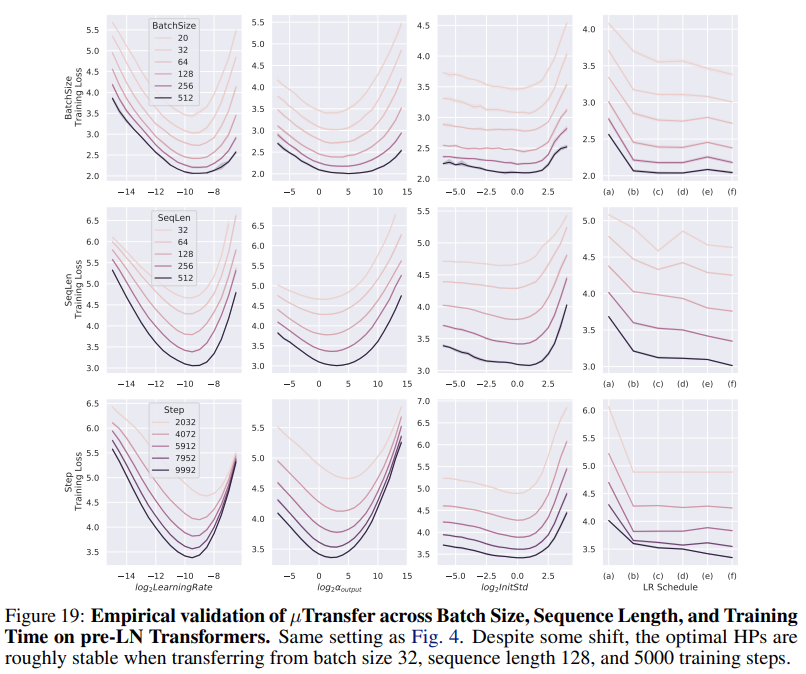

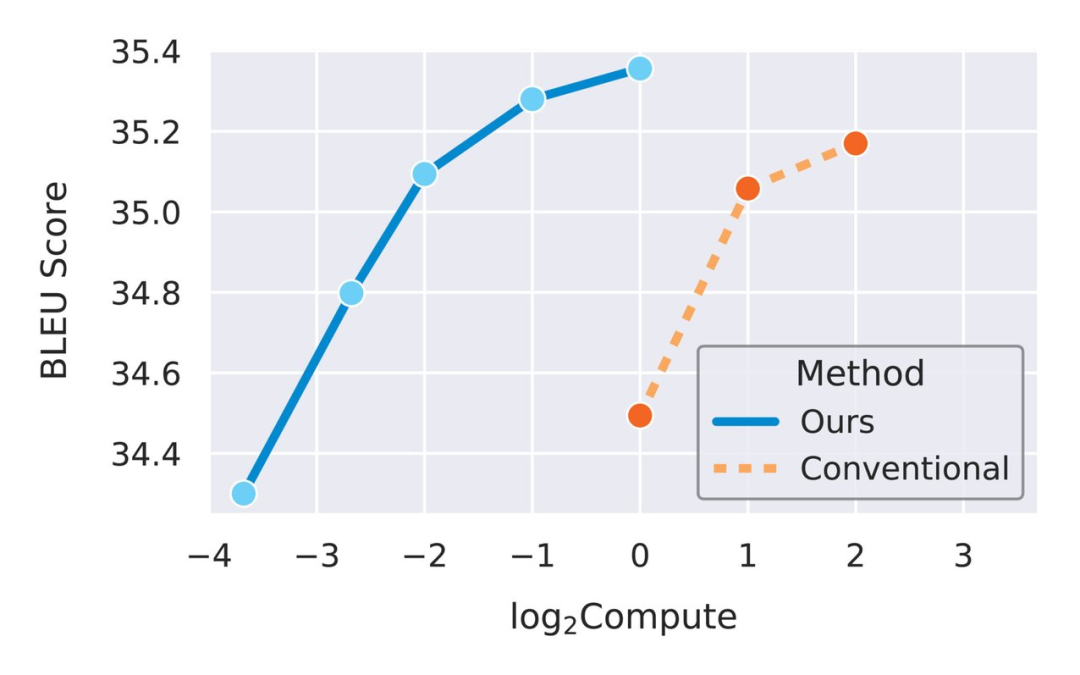

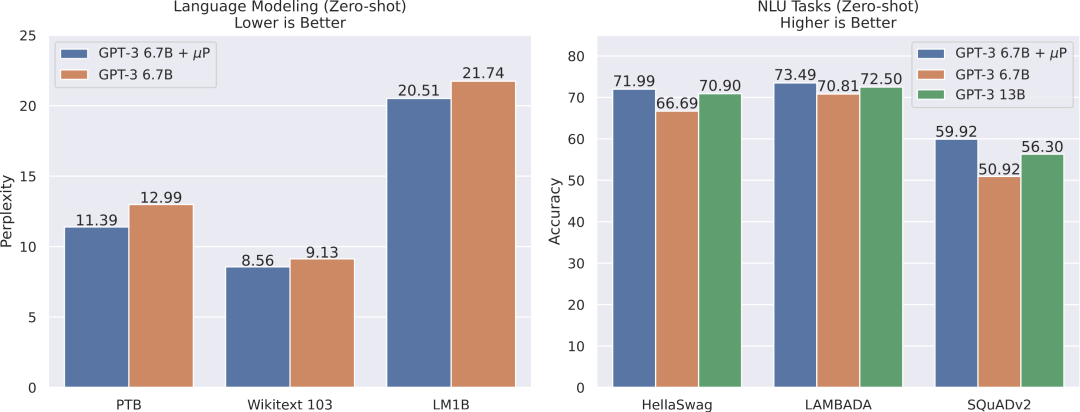

编者按:伟大的科学成就不能仅靠反复试验取得。在构建大规模人工智能系统时,基础研究所形成的理论见解能够帮助研究员大大减少试错次数并提高成本效益。在今天的文章中,微软研究院的研究员们将介绍基础研究如何首次能够调整庞大的神经网络。由于庞大的神经网络训练十分昂贵,所以研究员们通过展示特定参数化在不同模型大小上保留最佳超参数来解决这一问题。通过与 OpenAI 合作,微软研究院的研究员们在一系列现实场景中也验证了该技术的实际优势。

论文地址:https://arxiv.org/pdf/2203.03466.pdf 项目地址:https://github.com/microsoft/mup

评论