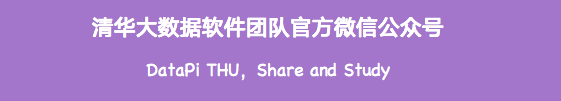

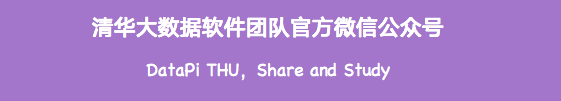

Table-GPT:让大语言模型理解表格数据

来源:Deephub Imb

本文约2000字,建议阅读5分钟

本文将解释一篇论文,以了解如何创建Table-GPT,以及与其他大型语言模型相比它的性能如何。

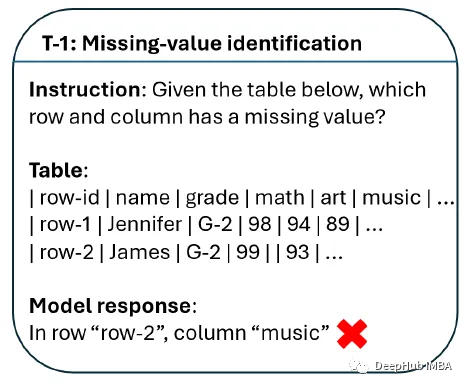

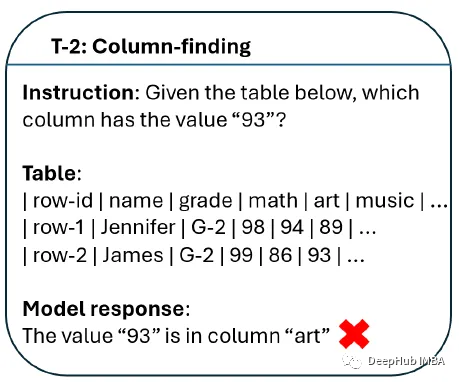

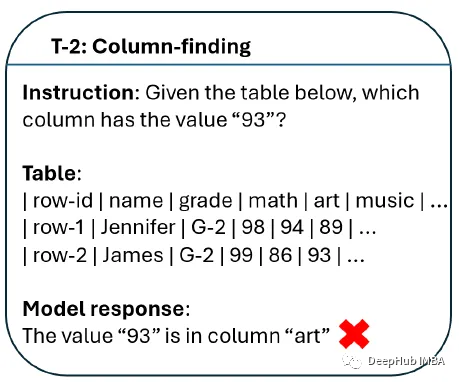

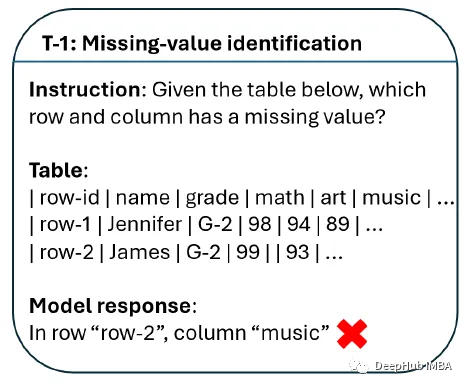

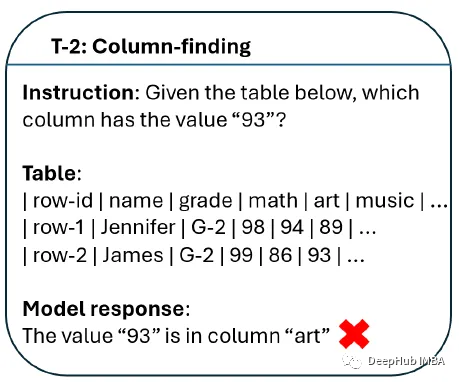

目前的LLM能理解表吗?

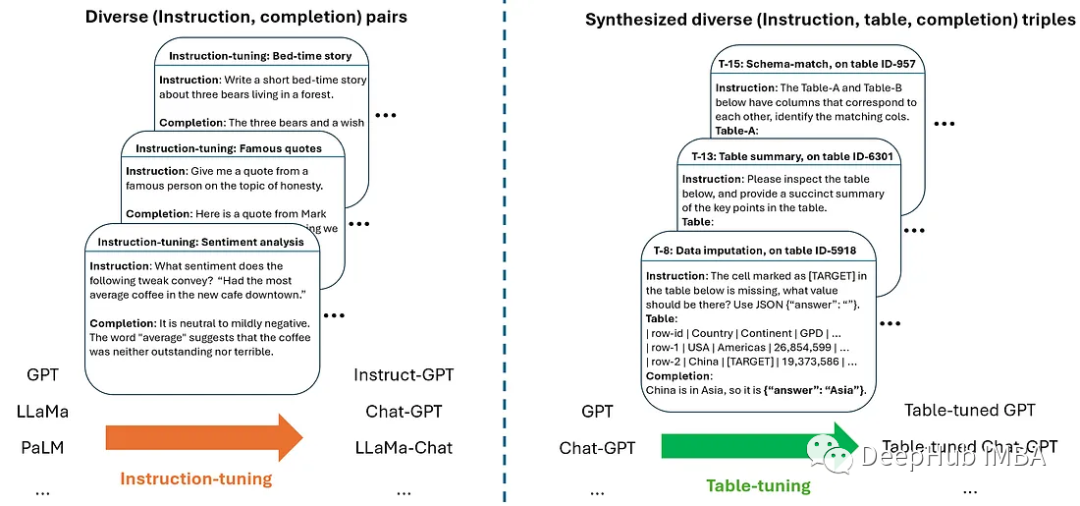

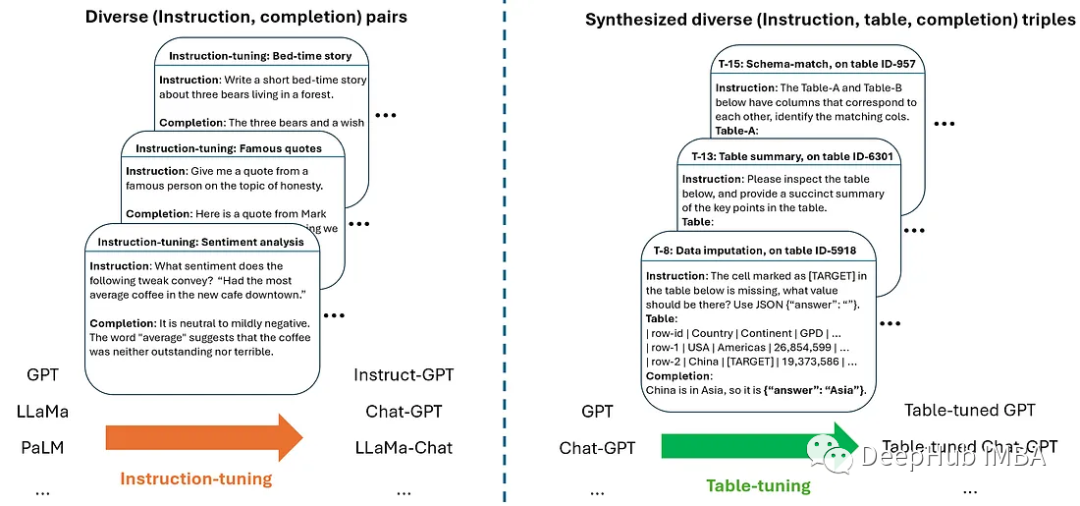

表调优

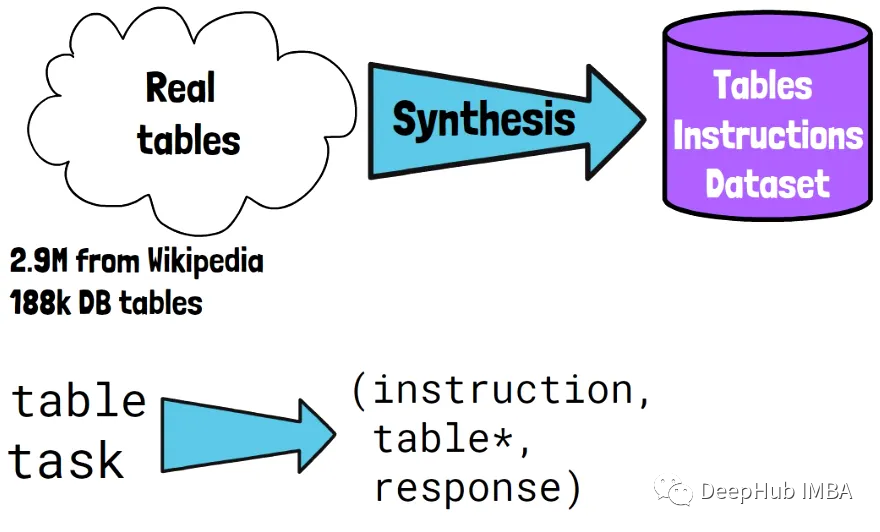

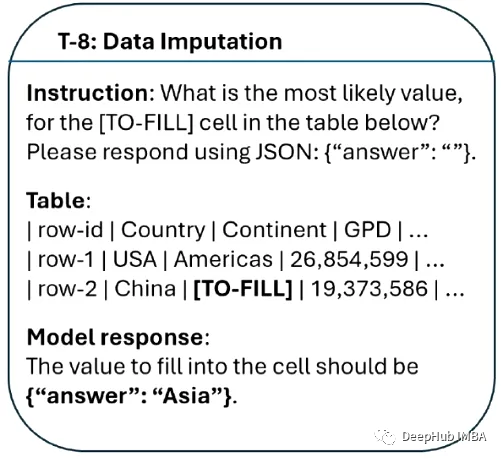

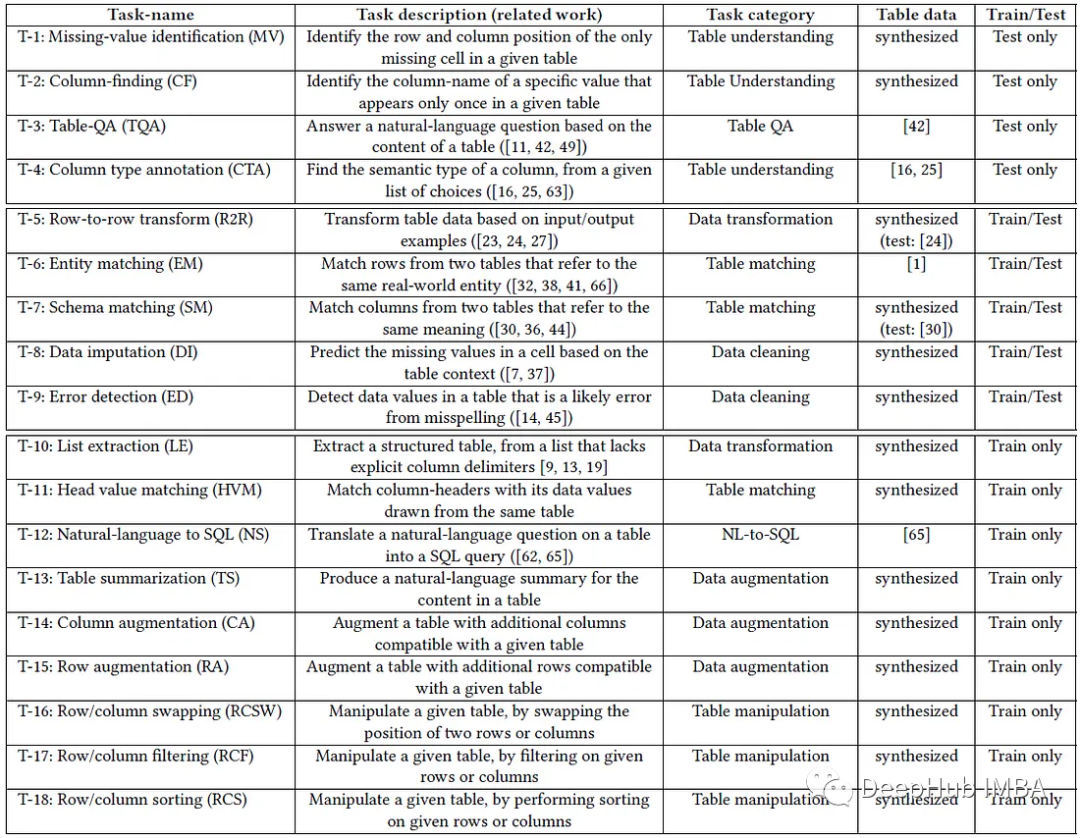

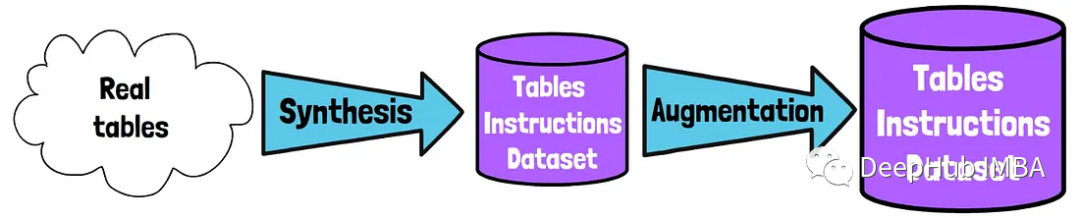

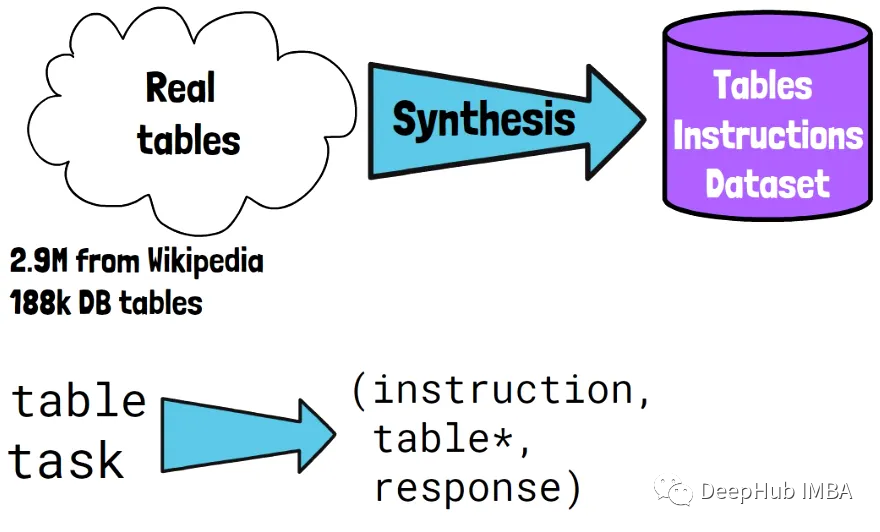

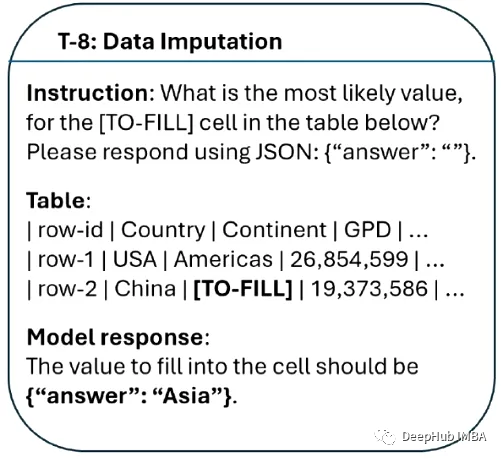

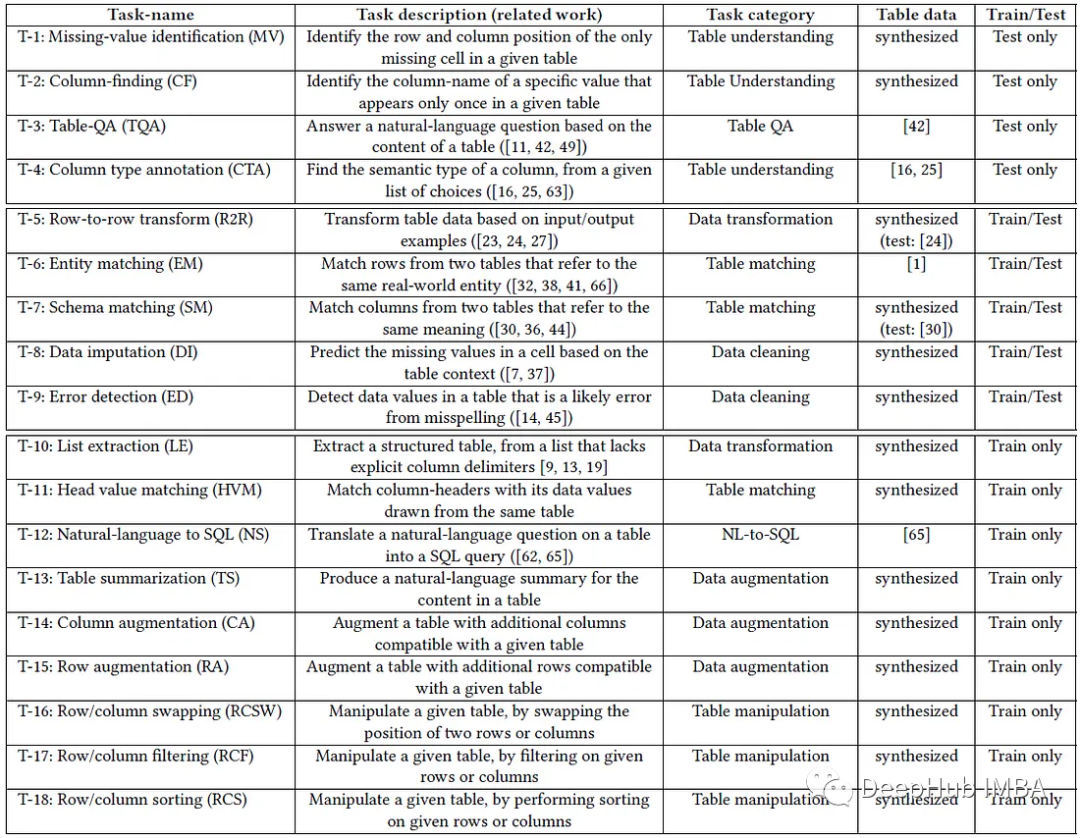

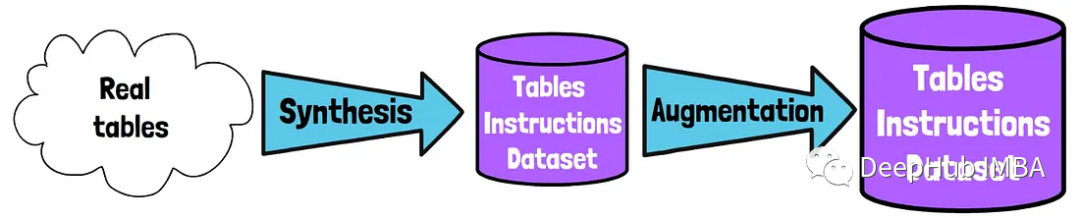

创建数据集:合成增强

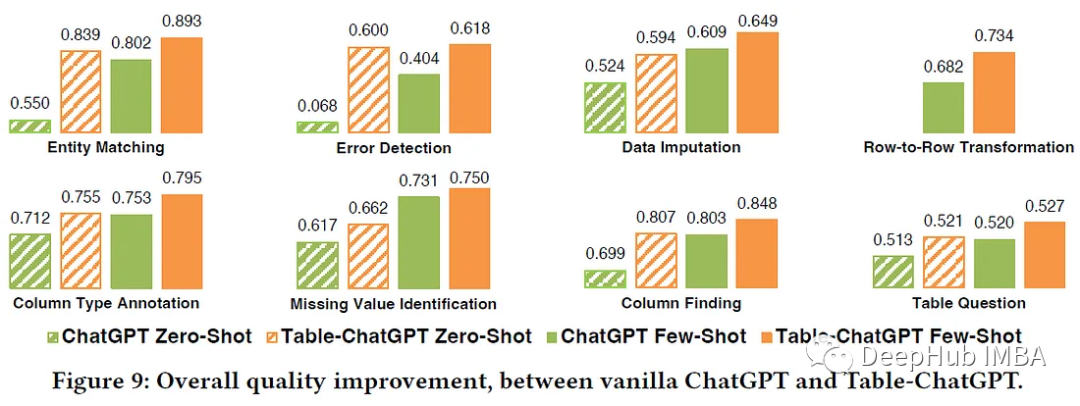

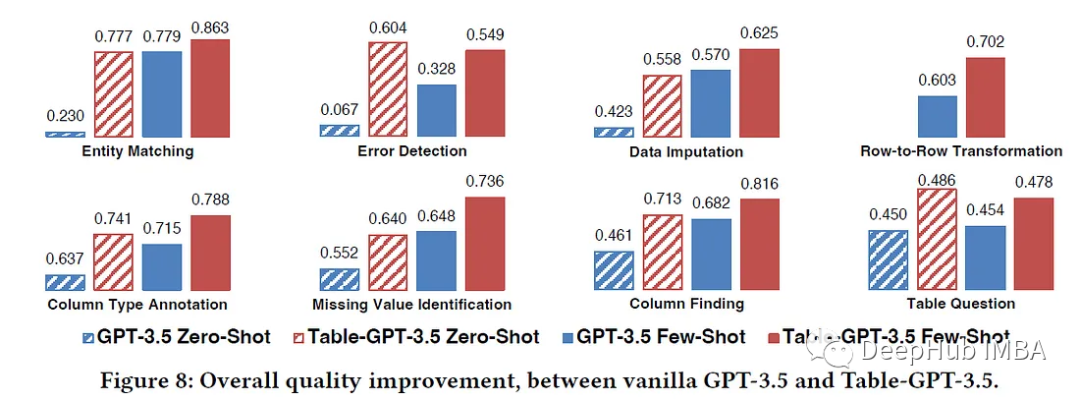

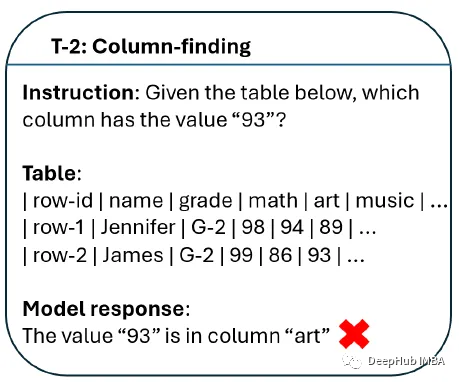

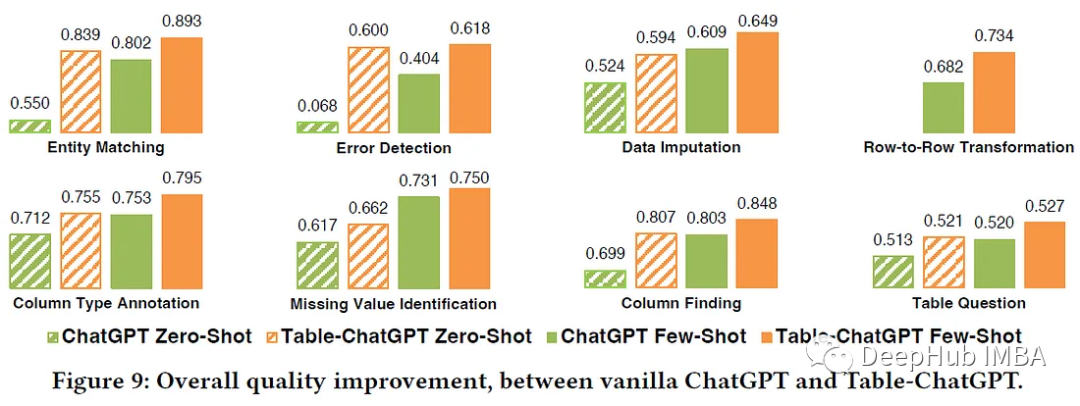

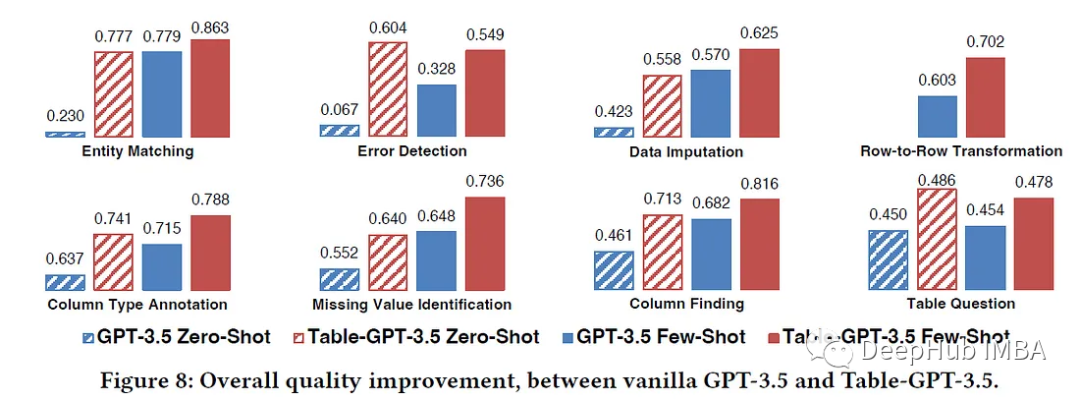

结果

最后论文地址:

https://arxiv.org/abs/2310.09263

编辑:王菁

评论

下载APP

下载APP

来源:Deephub Imb

本文约2000字,建议阅读5分钟

本文将解释一篇论文,以了解如何创建Table-GPT,以及与其他大型语言模型相比它的性能如何。

最后论文地址:

https://arxiv.org/abs/2310.09263

编辑:王菁