手把手教你用Pandas库对淘宝原始数据进行数据处理和分词处理

二、原始数据预处理

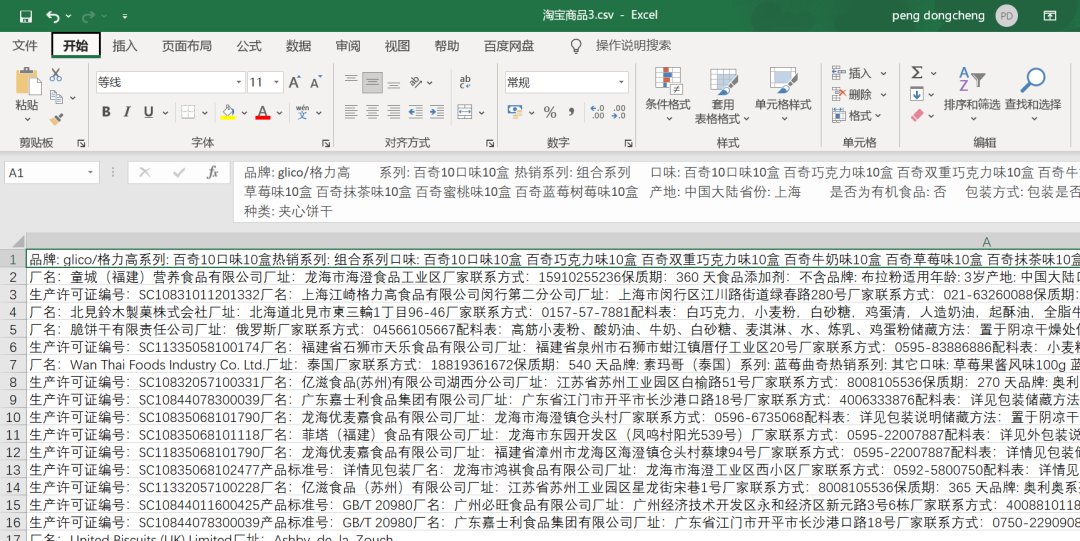

1、原始数据

在未经过处理之前的数据,长这样,大家可以看看,全部存储在一个单元格里边了,看得十分的让人难受。如下图所示。

按照常规来说,针对上面的数据,我们肯定会选择Excel里边的数据分列进行处理,然后依次的去根据空格、冒号去分割,这样可以得到一份较为清晰的数据表,诚然,这种方法确实可行,但是小小明大佬另辟蹊径,给大家用Python中的正则表达式来处理这个数据,处理方法如下。

2、原始数据预处理

小小明大佬直接使用正则表达式re模块和pandas模块进行处理,方法可谓巧妙,一击即中,数据处理代码如下。

import reimport pandas as pdresult = []with open(r"淘宝数据.csv") as f:for line in f:row = dict(re.findall("([^:\t]+):([^:\t]+)", line))if row:result.append(row)df = pd.DataFrame(result)df.to_excel('new_data.xlsx', encoding='utf-8')print(df)

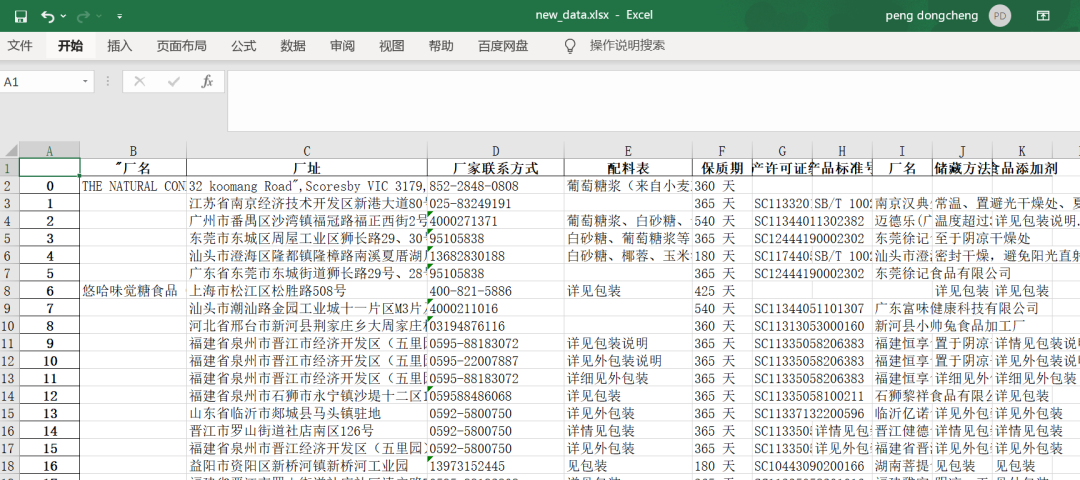

之后我们可以看到效果图,如下图所示,这下是不是感觉到清爽了很多呢?

至此,我们对原始的数据进行了预处理,但是这还不够,我们今天主要的目标是对上面数据中的两列:配料表和保质期进行数据分析,接下来继续我们的数据处理和分析。

三、对配料表和保质期列进行处理

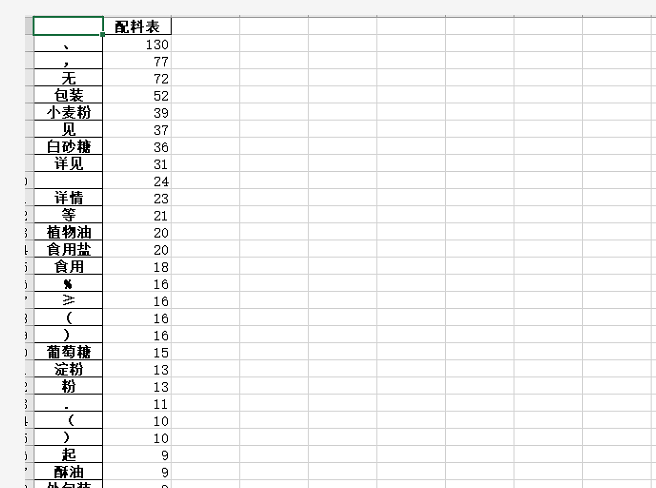

一开始的时候,程序大佬对配料表和保质期这两列的数据进行处理,但是来回得到的分词中总有一些特殊字符,如下图所示,我们可以看到这些字符里边有%、顿号、空格等内容。

我们都知道,这些是我们不需要的字符,当时我们在群里讨论的时候,我们就想到使用停用词去针对这些扰人的字符进行处理,代码如下。

# 创建停用词listdef stopwordslist(filepath):stopwords = [line.strip() for line in open(filepath, 'r', encoding='gbk').readlines()]return stopwords# 对句子进行分词def seg_sentence(sentence):sentence_seged = jieba.cut(sentence.strip())stopwords = stopwordslist('stop_word.txt') # 这里加载停用词的路径outstr = ''for word in sentence_seged:if word not in stopwords:if word != '\t':outstr += wordoutstr += " "return outstr

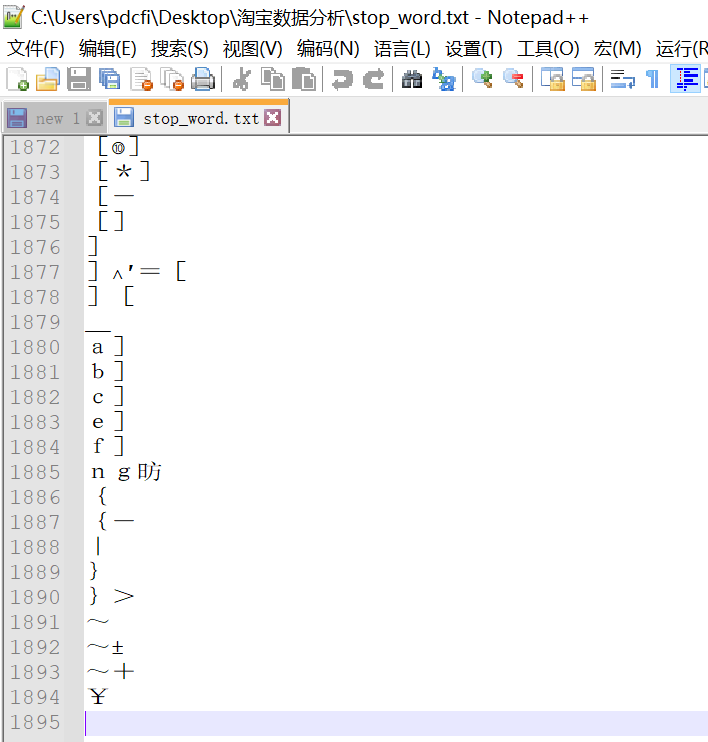

其中stop_word.txt是小编之前在网上找到的一个存放一些常用特殊字符的txt文件,这个文件内容可以看看下图。

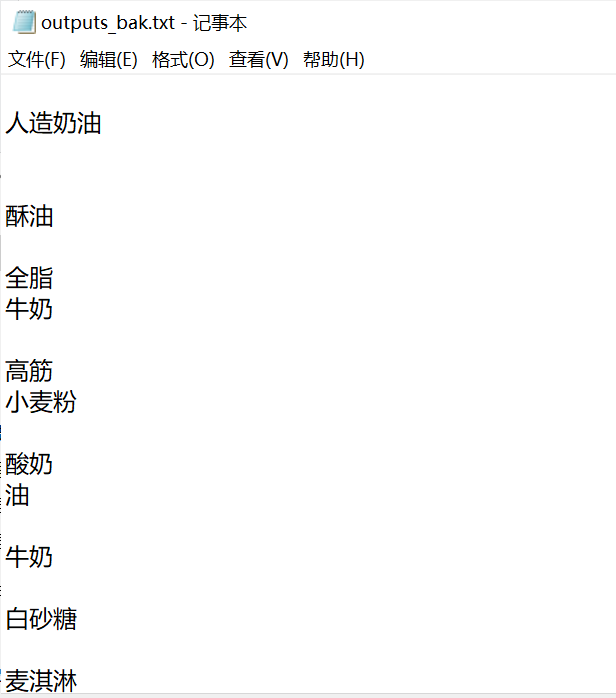

如上图所示,大概有1894个词左右,其实在做词频分析的时候,使用停用词去除特殊字符是经常会用到的,感兴趣的小伙伴可以收藏下,也许后面你会用到呢?代码和数据我统一放到文末了,记得去取就行。经过这一轮的数据处理之后,我们得到的数据就基本上没有太多杂乱的字符了,如下图所示。

得到这些数据之后,接下来我们需要对这些词语做一些词频统计,并且对其进行可视化。如果还有想法的话,也可以直接套用词云模板,生成漂亮的词云图,也未尝不可。

四、词频统计

关于词频统计这块,小编这里介绍两种方法,两个代码都是可以用的,条条大路通罗马,一起来看看吧!

方法一:常规处理

这里使用的是常规处理的方法,代码亲测可用,只需要将代码中的1.txt进行替换成你自己的那个需要分词统计的文档即可,然后系统会自动给你生成一个Excel表格和一个TXT文件,内容都是一样的,只不过一个是表格,一个是文本。

#!/usr/bin/env python3# -*- coding:utf-8 -*-import sysimport jiebaimport jieba.analyseimport xlwt # 写入Excel表的库# reload(sys)# sys.setdefaultencoding('utf-8')if __name__ == "__main__":wbk = xlwt.Workbook(encoding='ascii')sheet = wbk.add_sheet("wordCount") # Excel单元格名字word_lst = []key_list = []for line in open('1.txt', encoding='utf-8'): # 1.txt是需要分词统计的文档item = line.strip('\n\r').split('\t') # 制表格切分# print itemtags = jieba.analyse.extract_tags(item[0]) # jieba分词for t in tags:word_lst.append(t)word_dict = {}with open("wordCount_all_lyrics.txt", 'w') as wf2: # 打开文件for item in word_lst:if item not in word_dict: # 统计数量word_dict[item] = 1else:word_dict[item] += 1orderList = list(word_dict.values())orderList.sort(reverse=True)# print orderListfor i in range(len(orderList)):for key in word_dict:if word_dict[key] == orderList[i]:wf2.write(key + ' ' + str(word_dict[key]) + '\n') # 写入txt文档key_list.append(key)word_dict[key] = 0for i in range(len(key_list)):sheet.write(i, 1, label=orderList[i])sheet.write(i, 0, label=key_list[i])wbk.save('wordCount_all_lyrics.xls') # 保存为 wordCount.xls文件

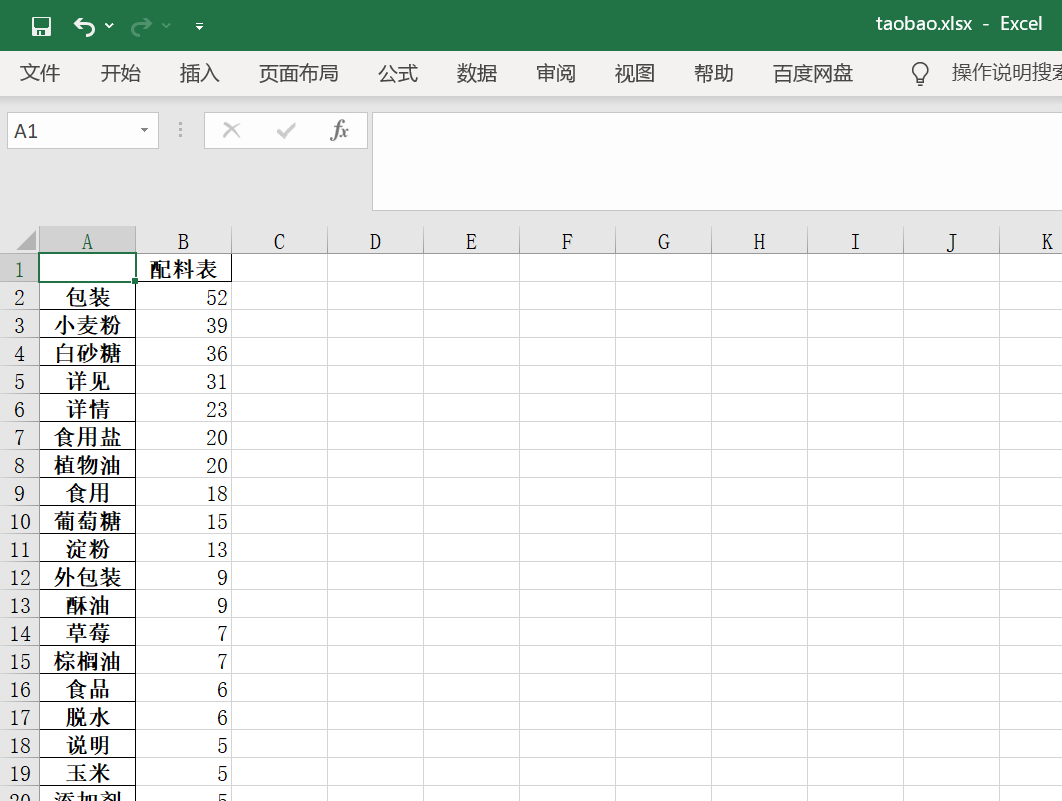

方法二:使用Pandas优化处理

这里使用Pandas方法进行处理,代码如下,小编也是亲测有效,小伙伴们也可以去尝试下。

def get_data(df):# 将食品添加剂这一列空的数据设置为无# print(df)df.loc[:,'食品添加剂'] = df['食品添加剂'].fillna('无')df.loc[:,'保质期'] = df['保质期'].fillna('无')df.loc[:, '配料表'] = df['配料表'].fillna('无')# 分词并扩展提取names = df.配料表.apply(jieba.lcut).explode()# 过滤长度小于等于1的词并去重df1 = names[names.apply(len) > 1].value_counts()with pd.ExcelWriter("taobao.xlsx") as writer:df1.to_excel(writer, sheet_name='配料')df2 = pd.read_excel('taobao.xlsx', header=None, skiprows=1, names=['column1', 'column2'])print(df2)

五、总结

推荐阅读:

入门: 最全的零基础学Python的问题 | 零基础学了8个月的Python | 实战项目 |学Python就是这条捷径

干货:爬取豆瓣短评,电影《后来的我们》 | 38年NBA最佳球员分析 | 从万众期待到口碑扑街!唐探3令人失望 | 笑看新倚天屠龙记 | 灯谜答题王 |用Python做个海量小姐姐素描图 |碟中谍这么火,我用机器学习做个迷你推荐系统电影

趣味:弹球游戏 | 九宫格 | 漂亮的花 | 两百行Python《天天酷跑》游戏!

AI: 会做诗的机器人 | 给图片上色 | 预测收入 | 碟中谍这么火,我用机器学习做个迷你推荐系统电影

小工具: Pdf转Word,轻松搞定表格和水印! | 一键把html网页保存为pdf!| 再见PDF提取收费! | 用90行代码打造最强PDF转换器,word、PPT、excel、markdown、html一键转换 | 制作一款钉钉低价机票提示器! |60行代码做了一个语音壁纸切换器天天看小姐姐!|