Pandas数据清理,看这一篇就够了

作者介绍

吐血整理数据人常用Pandas数据清理(附代码)

全文干货,阅读请自备奶茶解渴(wink)。

数据行业的从业者都知道数据清理是整个数据分析周期(见下图)最重要也是最耗时的步骤。没有“干净”的、符合特定规范的数据输入,就没有有效的结果引导决策,更糟糕的是,数据清理不完整或者错误甚至会误导决策,GIGO (garbage in, garbage out)就是我们数据人最想避免的情况。

Source: Quora

备注:The step of data preparation is also known as Data Cleaning or Data Wrangling。

这篇文章是我通过工作中处理大几十个公司的数据遇到的问题而做的总结,问题都源于工业界实际应用案例,大家可以当作备考、面试、工作的cheat sheet,还不快点赞收藏~

本文所有相关代码已上传至GitHub,请自行下载。

点击下方卡片,回复 “数据处理”

即可获取本文所有相关代码

本文的方法都尽量致力于用最短的代码、最快的运行速度来解决问题,当然,如果有更好的方法欢迎大家留言。

建议:阅读code前,大家可以先想想当你们遇到这些问题会怎么写,先思考再“抄作业”看解析,印象会更加深刻哦。

Note:数据清理好习惯 - 代码run完,记得要double check清理结果。

问题一:合并多个excel文件的多个工作表

完整代码:

df = pd.DataFrame()# the glob module is used to retrieve files/pathnames matching a specified patterndir_filenames = sorted(glob('./*.xlsx')) # all excel files from current directoryfor dir_file in dir_filenames:dict_xlsx = pd.read_excel(dir_file, sheet_name=None)workbook = pd.concat([v_df.assign(Sheet = k) for k,v_df in dict_xlsx.items()], ignore_index=True)df = pd.concat([df,workbook],ignore_index=True)print(f'shape of merged files:{df.shape}')解析:总体思路是读取每个工作簿,再读取每个工作簿的工作表,list comprehension内循环合并表,外循环合并工作簿glob用于返回符合某个pattern的路径和文件名glob('./*.xlsx') 返回当前目录下的所有Excel文件名python的built-in function sorted()不改变原list,要赋值给新的variable才实现排序pd.read_excel(dir_file, sheet_name=None) 返回dictionary,key是sheet name, value是工作表的数据[v_df.assign(Sheet = k) for k,v_df in dict_xlsx.items()]是list comprehension,通常能简化代码的同时加快代码的运行速度df.assign()是新加一列,记录工作表名称pd.concat([])是纵向合并数据的好方法

问题二:查看空值和处理空值

完整代码:

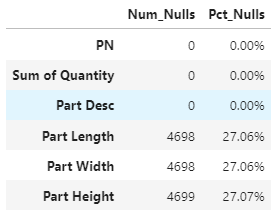

count_null_series = df.isnull().sum() # returns seriescount_null_df = pd.DataFrame(data=count_null_series, columns=['Num_Nulls'])# what % of the null values take for that columnpct_null_df = pd.DataFrame(data=count_null_series/len(df), columns=['Pct_Nulls'])null_stats = pd.concat([count_null_df, pct_null_df],axis=1)null_stats

结果:

解析:df.isnull().sum()会算出每列缺失值的数量,再算一个缺失值占本列的百分比可以让自己更清楚数据的情况和下一步如何清理缺失值。

处理缺失值:

- 时间序列的数据常用df[col_name].fillna(method="ffill",inplace=True),ffill表示按上一个值填充- 不同列补不同的值df.fillna(value={col1:50, col2:67, col3:100}, inplace=True)- 以当列的平均值弥补空值df.where(pd.notna(df), df.mean(), axis="columns", inplace=True)- 任意选定的列为空就删除该行df.dropna(subset=subset_list, inplace=True)- 当一半的行为空,删除该列df.dropna(thresh=len(df)*N, axis=1, inplace=True)

问题三:删除多列

有没有小伙伴像我一样,当数据有很多无关不重要的列,而不愿意copy paste列名去drop的童鞋,这里提供用column index一行搞定删除多列的问题。

完整代码:

df.info()df.drop(df.columns[start_ind:stop_ind],axis=1,inplace=True)df.info()

当列很多的时候,每个column对应的index一个个数可太麻烦了,df.info()是一个非常简洁又高效的方法。他会返回dataframe的行数,列数,列名对应的index,数据类型,非空值和memory usage。

所以第一个df.info()就是为了找出你要删的列明的起始index和终止index,注意,如果你要删2-4列,stop_index应该是5才会把第4列删掉。第二个df.info()是为了double check最后的数据列都是你想要的,如果还有要删列还可以循环进行这样的步骤。

问题四:批量改列名

完整代码:

df.rename(columns= {'Order_No_1':'OrderID','ItemNo':'ItemID'}, inplace=True)# remove special characters from column namedf.columns = df.columns.str.replace('[&,#,@,(,)]', '')# remove leading/trailing space and add _ to in-between spacesdf.columns = df.columns.str.strip().str.replace(' ','_')

df.rename()是常见的改列名的方法,在这里想格外强调后两行代码,是批量格式化列名的“黑科技”。

note:数据工作中,文件命名的convention(约定习俗)是不留空格,要么加’_’,要么加’-‘,要么CamelCase,这同样适用于数据的列名命名,因为计算机不擅于处理/解析空格。

问题五:批量更改数据格式

for c in ['OrderID','ItemID','Class']:df[c] = df[c].astype('str')

问题六:处理重复值

完整代码:

len_df = len(df)len_drop = len(df.drop_duplicates(subset = subset_list))len_diff = len_df-len_dropprint(f'difference of length:{len_diff}')if len_diff>0:dups = df[df.duplicated(keep=False)].sort_values(by=sort_list)df_drop = df.drop_duplicates(subset=subset_list, keep='last')

解析:df.drop_duplicates(subset = subset_list)会返回基于指定列subset_list去重后的dataframe。如果发现有重复值,

df.duplicated(keep=False).sort_values(by=sort_list)这段代码可以让你有方向的进行比较,keep=False是保证重复值都展示出来的必备参数,sort_values()是保证重复值挨着出现,方便你接下来决策如何处理他们。以上代码列举了保留重复值最后一项的例子(keep='last')。

问题七:处理日期和时间

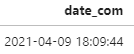

当我们收到了这样的数据,dtype是object,要如何把他转化成date format并且分离出time和hour呢?

代码:

# split by comma, retrieve the first columndf['date_com'] = df['date_com'].str.split(',', expand=True)[0]# format要和原日期的格式一致,最后总会返回YYYY-MM-DD HH:MM:SS格式的datetimedf['date_com'] = pd.to_datetime(df['date_com'], format='%Y-%m-%d %H:%M:%S')

返回结果:

如果要进一步分离date和time:

df['Date'] = df['date_com'].dt.datedt_lst = df['date_com'].str.split(' ', n=1, expand = True)df['Time'] = dt_lst[1]# extract hour from Timetime_lst = df['date_com'].str.split(':', n=1, expand = True)df['Hour'] = time_lst[0] #str

今天的分享先到这里,感觉有学到新知识记得点赞转发加关注哦。下期见。

点击下方卡片,回复 “数据处理”

即可获取本文所有相关代码

--END--

老表推荐

图书介绍:《Python网络编程从入门到精通》编写秉承让更多的 Python 爱好者能看懂的原则,以让读者以较少的时间、较低的成本,快速掌握 Python 网络编程为目标。每个步骤都很详尽,读者可按步骤操作,还配有相应代码,方便读者实现网络编程的开发。

扫码即可加我微信

老表朋友圈经常有赠书/红包福利活动

学习更多: 整理了我开始分享学习笔记到现在超过250篇优质文章,涵盖数据分析、爬虫、机器学习等方面,别再说不知道该从哪开始,实战哪里找了 优秀的读者都知道,“点赞”传统美德不能丢