用Python下载煎蛋网全站好看的小姐姐!

转载来自:Python技术

春天到了,春光明媚,鸟语花香,各地都回温了!公园里面的花都开了,这几天都没有心情工作,准备周末出去游山玩水,踏踏青!先用Python爬取一波妹子图,摸摸鱼吧。

导入模块

首先把用到的模块贴进来。

import requests

from bs4 import BeautifulSoup

import time

import random

抓取

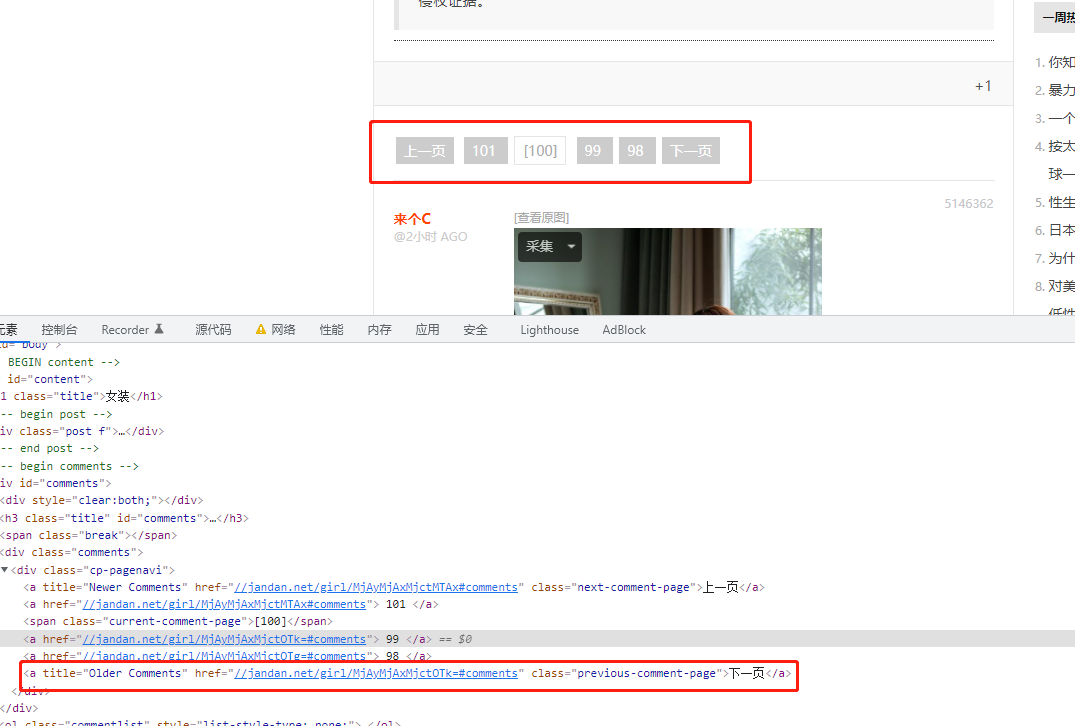

煎蛋网的抓取流程:从第 101 页开始抓取,提取页面上的女装图片 url,请求 url 后保存图片,点击下一页,重复循环...。

当访问煎蛋网的 http://jandan.net/girl 页面的时候,它是显示的最后一页。通过上面的分页控件获取下一页的 url。

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/97.0.4692.99 Safari/537.36'

}

def get_html(url):

resp = requests.get(url = url, headers = headers)

soup = BeautifulSoup(resp.text)

return soup

def get_next_page(soup):

next_page = soup.find(class_='previous-comment-page')

next_page_href = next_page.get('href')

return f'http:{next_page_href}'

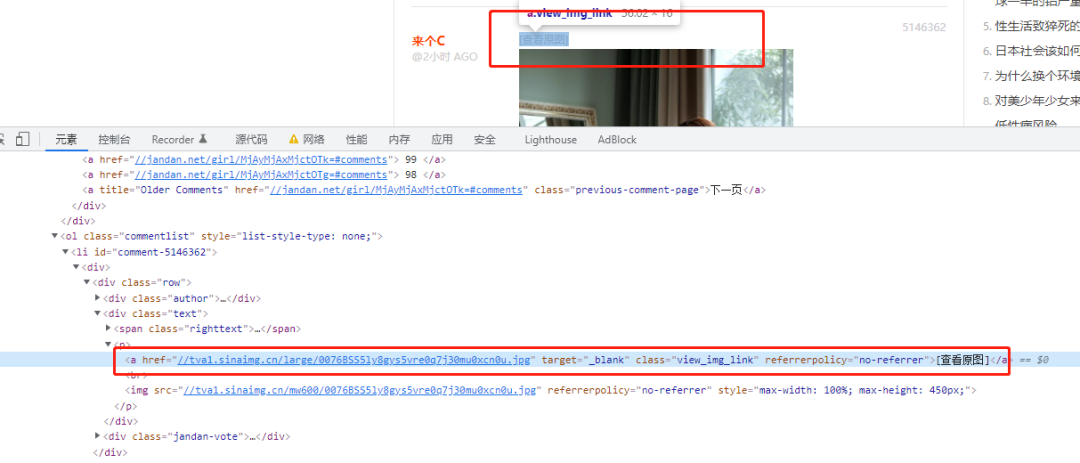

可以看到每个图片上都有[查看原图] 的超链接,提取这个 href 就是可以下载图片了。

def get_img_url(soup):

a_list = soup.find_all(class_ = 'view_img_link')

urls = []

for a in a_list:

href = 'http:' + a.get('href')

urls.append(href)

return urls

保存图片就更简单了,request 请求后直接写入文件。

def save_image(urls):

for item in urls:

name = item.split('/')[-1]

resp = requests.get(url=item, headers = headers)

with open('D:/xxoo/' + name, 'wb') as f:

f.write(resp.content)

time.sleep(random.randint(2,5))

最后来看一下抓取结果吧。

总结

这篇 request 爬虫适合刚入 python 和没学过 soup 模块的小伙伴。有兴趣的小伙伴,可以动手敲一下代码。看百遍,读千边,不如动手敲一边。学习Python一定要动手操作,实战才行。

扫码加入,3周零基础入门

推荐阅读:

入门: 最全的零基础学Python的问题 | 零基础学了8个月的Python | 实战项目 |学Python就是这条捷径

干货:爬取豆瓣短评,电影《后来的我们》 | 38年NBA最佳球员分析 | 从万众期待到口碑扑街!唐探3令人失望 | 笑看新倚天屠龙记 | 灯谜答题王 |用Python做个海量小姐姐素描图 |碟中谍这么火,我用机器学习做个迷你推荐系统电影

趣味:弹球游戏 | 九宫格 | 漂亮的花 | 两百行Python《天天酷跑》游戏!

AI: 会做诗的机器人 | 给图片上色 | 预测收入 | 碟中谍这么火,我用机器学习做个迷你推荐系统电影

小工具: Pdf转Word,轻松搞定表格和水印! | 一键把html网页保存为pdf!| 再见PDF提取收费! | 用90行代码打造最强PDF转换器,word、PPT、excel、markdown、html一键转换 | 制作一款钉钉低价机票提示器! |60行代码做了一个语音壁纸切换器天天看小姐姐!|

年度爆款文案

点阅读原文,看200个Python案例!