IJCV论文与arXiv论文神似,arXiv,是占坑神器还是剽窃利器?

新智元报道

新智元报道

来源:Reddit

编辑:Priscilla LQ

【新智元导读】论文被scoop(抢先发表)了!相信有过这种「中奖」经历的人不在少数。自己的idea被「抢发」着实是一件让人100%沮丧的事情。

咦,顶刊IJCV的一篇论文怎么跟2年前arXiv的一篇论文这么相似?

今天,Reddit一位好奇宝宝网友在「网上冲浪」的时候,发现了这一不可思议的事情。

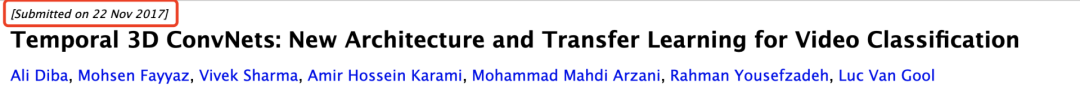

原来事情是这样的,Reddit网友发现:一篇2017年发表的arXiv的论文和另一篇2019年发表在IJCA的论文「高度相似」,存在「大段粘贴」、「数据一样」那种。

△ 上图为arXiv论文发表时间为2017年,下面是IJCV上的论文,接收时间是2018年,发表时间是2019年

比如,两篇论文的所用的数据相同,有图为证:

再比如,摘要部分高度相似:

更仔细地看,这篇IJCV论文的主要思想,arXiv论文早就已经解释了,而且很充分。但这篇顶会论文并没有在参考文献中引用这篇arXiv论文。

竟然有这样的事?!网友拿不定主意了,所以向广大网友发起了求助:要不要「多管闲事」,联系一下相关方来解决这个事情呢?

实习生偷偷拿了我的数据抢发论文

实习生偷偷拿了我的数据抢发论文

网友纷纷留言,有网友建议:联系arxiv论文作者,让他们自己解决。

也有网友分享了自己的经历:我被几个学生scoop(抢先发表)了,后来通过几封邮件解决了。

这个不幸被「scoop」的经历立即引起了网友围观:后来发生了什么?

于是,这位Reddit网友就现身说法:

某天冲浪读到一篇arxiv论文,和自己所做的研究非常相似,而且已经发出来了,COOL!

一看作者——实验室之前的实习生......

而且这几个实习生有实验室private repositories的权限。

想到这里,心里升起一种似曾相识的被「scoop」的感觉......

联系了当时这几个实习生的导师后证实,确实是他们擅自用了实验室的数据。

几个实习生提出解决办法:可以添加为合著者,但不会撤稿。

用了我的数据,现在只是提供「合著权」?!

这遭到了这位网友和实验室其他人的强烈反对。

最后,由于这几个实习生表示以后也不会待在学术界了,所以接受了「教育」后,这件事就这么不了了之。

几个月后,被抢发的这位网友向期刊提交了自己的论文,并且顺利发表,现在引用量也赶上了之前那篇arXiv论文。

当然,当看到他们仍然在领英上宣传自己这篇论文,被偷数据的当事人感受可想而知......

publish or perish?

publish or perish?

不过,上面那位「建议联系arxiv论文作者,让他们自己解决」,也提到了科研圈「publish or perish」的事实,发表或灭亡,自己选一个吧。

被抢发,这并不罕见。

科研工作也讲求时效性。

随时掌握研究领域的最新进展,有助于研究人员及时获取最新消息,或者是调整自己的研究方向。

在arXiv出现之前,要了解同行的研究成果,就只能期刊上获得。

但这对于一些像量子学这样的热门科研领域来说,等待论文发表在期刊上,就成为了一场「漫长的煎熬」。

因此,当初arXiv的出现就是为了预收录物理学领域的论文,后来收录领域逐渐扩大到数学、计算机、非线性科学、定量生物学等领域。

而现在,arXiv除了有以上提到的功能之外,还有另一个主要的功能,那就是:

「占坑」。

不少研究人员为了证明自己论文的原创性,会在论文录用前,将论文挂到arXiv上,给自己的论文打上「时间戳」。

这样做,也是为了竞争:

因为,谁将论文挂在了arXiv上,谁就拥有了这篇论文的权力。

对于一些领域大神而言,arXiv这一大好处会让他们尽快挂论文,他们在乎的是「impact」。

然而,鲁迅说过,「凡事都有好有坏」。

对于一些不太有名的研究小组来说,将论文挂在arXiv就有很大风险了。

辛辛苦苦一年半载,哼哧哼哧做研究,开开心心挂arXiv。

回过头来,哦豁,idea被人家抢了。

等想要刊登到期刊的时候,被评委说跟哪篇论文的相似度高,引起了争议。

你说冤不冤啊!

「天下武功,唯快不破」,这句话科研圈也适用。

究竟要不要将论文提前挂到arXiv上?各位读者也会有这样的纠结吗?

同是天涯沦落人,或许你也有过类似论文被「抢发」的经历?最后又是怎么处理的呢?

不妨在评论区留(tu)言(cao)哦!

参考资料:

https://www.reddit.com/r/MachineLearning/comments/ojdmza/d_similarity_of_a_high_ranking_journal/

-往期精彩-