AI自动评审论文,CMU这个工具可行吗?我们用它评审了下Transformer论文

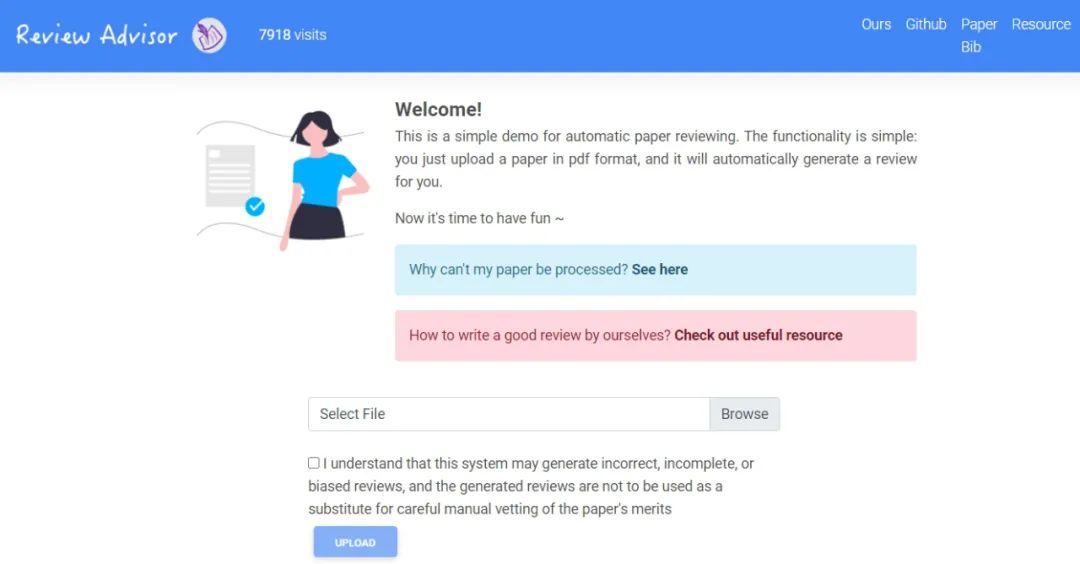

近年来,各大学术顶会的论文投稿量暴增,这使得论文评审的工作量大大增加。那么,有没有可能自动生成论文的评审结果呢?最近,CMU 研究者对此展开了探索,创建了一个自动论文评审系统,上传 PDF 论文即可自动生成评审结果,这或许会为论文评审带来一些改变。

科学技术的快速发展伴随着同行评审科学出版物的指数级增长。与此同时,论文的评审是一个耗时耗力的过程,必须由相应领域的专家来完成。这样一来,为不断增长的论文提供高质量的评审成为一大挑战。那么,有没有可能自动生成论文评审呢?

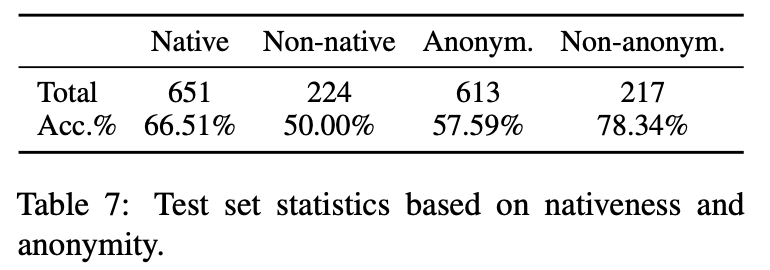

决断性(Decisiveness):好的同行评审应该立场明确,对是否接收论文提出明确建议;

全面性(Comprehensiveness):好的同行评审应该有条理,首先简要总结论文贡献,然后从不同方面评估论文质量;

正当性(Justification):好的同行评审应该有理有据,尤其是在指出论文缺点时要明确理由;

准确性(Accuracy):好的同行评审应该确保事实正确;

友好(Kindness):好的同行评审应该措辞礼貌善意。

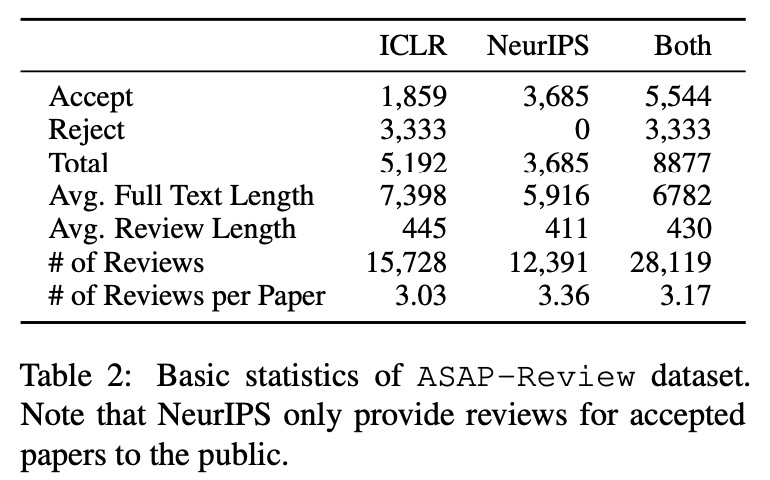

参考评审,由委员会成员撰写;

元评审,通常由领域主席(高级委员会成员)撰写;

论文接收结果,即论文最终被「接收」还是「拒稿」;

其他信息,包括 url、标题、作者等。

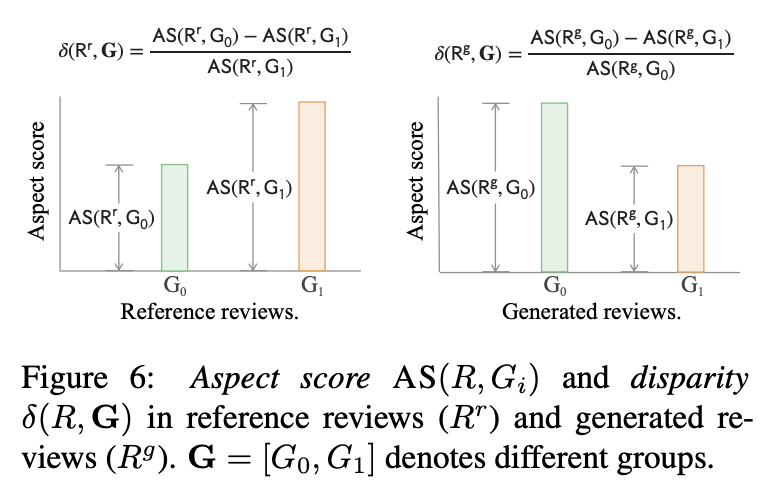

摘要 (SUM)

动机 / 影响(MOT)

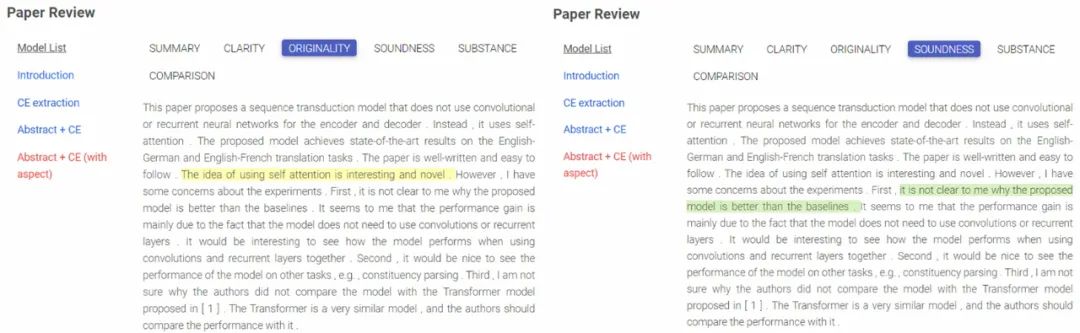

原创性(ORI)

可靠性 / 正确性(SOU)

Substance(SUB)

可复现性(REP)

有意义的对比(CMP)

清晰度(CLA)

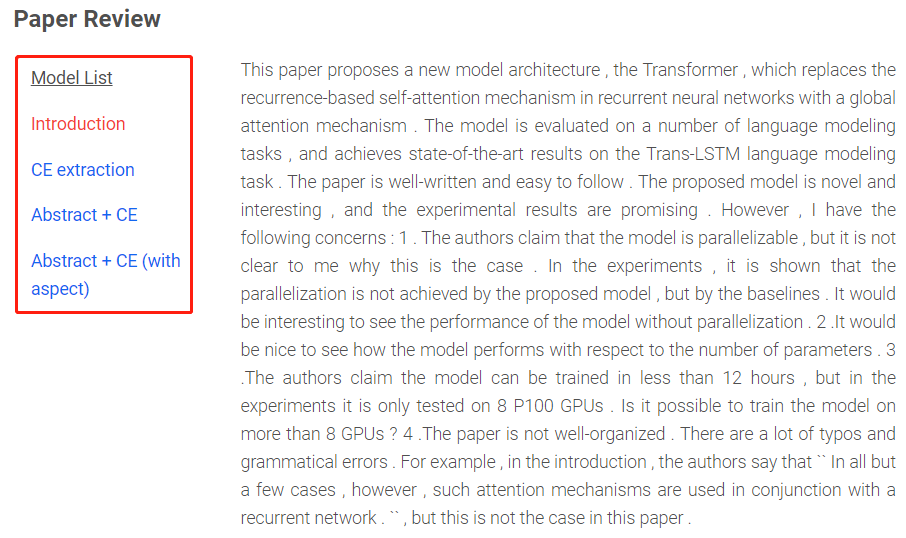

利用两阶段系统处理长文本

aspect 感知的摘要(aspect-aware Summarization)

缺乏对论文的高级理解:系统无法准确分辨高质量论文和低质量论文,大多数时候负面 aspect 的证据并不可靠;

模仿源数据的风格:在不同生成评审结果中常出现某些特定句子,这表明生成评审的风格易受训练样本中高频句子模式的影响;

缺乏问题:生成评审很少对论文内容提出问题,而这是同行评审的重要组成部分。

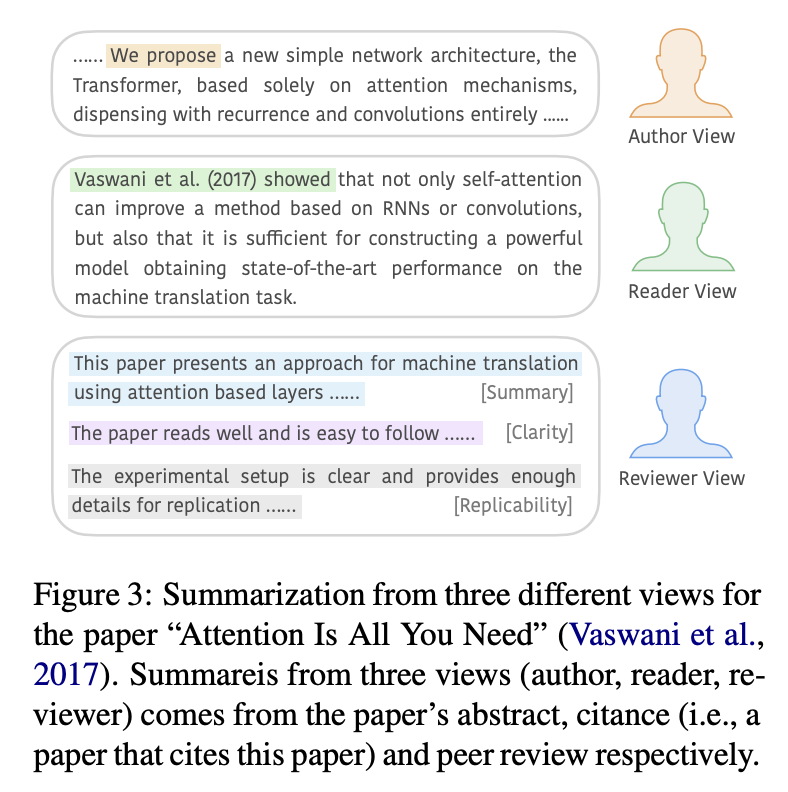

案例研究

本文部分素材来源于网络,如有侵权,联系删除。

今日学习推荐

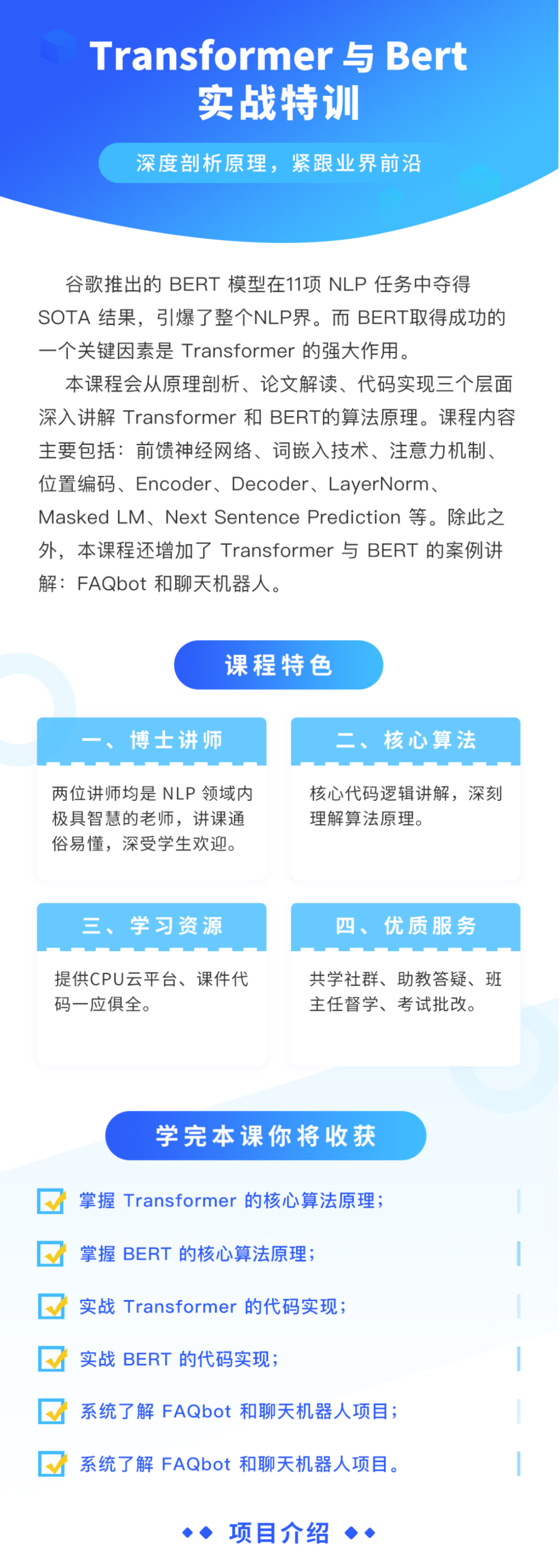

【Transformer与Bert特训】

深度剖析原理,紧跟业界前沿

理论与实践结合

课件代码一应俱全

共享社群,实时答疑

长按识别二维码

咨询课程

课程详情

☟

购买,咨询,查看课程,请点击【阅读原文】

↓ ↓ ↓